2025最新RAG+Agent开源工具RAGFlow,10分钟快速部署大模型应用

RAGFlow是一款开源的企业级RAG引擎,深度融合RAG与Agent能力,解决LLM理解私有数据和避免幻觉的痛点。它提供深度文档理解、智能分块、可追溯引用和自动化工作流等核心功能,支持多种数据源和模型。基于Docker部署,新手可在10分钟内启动,同时提供进阶配置选项。RAGFlow开源免费、功能全面、易上手、高适配性,持续迭代支持最新技术,适合从个人知识库到企业级AI系统的各种场景。

RAGFlow是一款开源的企业级RAG引擎,深度融合RAG与Agent能力,解决LLM理解私有数据和避免幻觉的痛点。它提供深度文档理解、智能分块、可追溯引用和自动化工作流等核心功能,支持多种数据源和模型。基于Docker部署,新手可在10分钟内启动,同时提供进阶配置选项。RAGFlow开源免费、功能全面、易上手、高适配性,持续迭代支持最新技术,适合从个人知识库到企业级AI系统的各种场景。

随着大模型在企业落地加速,“如何让LLM精准理解私有数据、避免幻觉”成为核心痛点。Retrieval-Augmented Generation(RAG)技术因能连接外部知识库、提升回答可信度,成为解决该问题的关键方案。而今天要介绍的RAGFlow,正是一款将前沿RAG与Agent能力深度融合的开源引擎——无论是个人搭建知识库,还是企业级部署,它都能帮你快速将复杂数据转化为生产级AI系统。

先直观体验下官方Demo:https://demo.ragflow.io,感受它的文件管理、AI对话与Agent协作能力~

一、什么是RAGFlow?

RAGFlow是由infiniflow开源的企业级RAG引擎,核心定位是“为LLM构建更优的上下文层”。它并非简单的“检索+生成”工具,而是整合了三大核心能力:

-

RAG+Agent双驱动

既支持精准的外部知识检索,又能通过Agent模板实现自动化任务执行(如技术支持、产品咨询);

-

统一上下文引擎

能处理海量非结构化数据,从扫描件到网页内容,都能精准提取知识;

-

灵活适配性

提供从个人到大型企业的全场景工作流,无需从零搭建RAG链路。

简言之,RAGFlow要解决的是“从数据到AI应用”的全链路问题——接入数据、配置模型,就能快速生成高保真的AI问答系统。

二、RAGFlow核心功能:直击RAG落地4大痛点

RAGFlow的功能设计精准匹配开发者在实践中的难题,每个特性都对应明确的业务价值:

. 1. 深度文档理解:从“混乱数据”中抽取出精准知识

传统RAG工具常栽在“非结构化数据解析”上——比如PDF扫描件的文字提取不全、Excel表格结构丢失。而RAGFlow通过自研的DeepDoc引擎,能做到:

-

全格式兼容

支持Word、PPT、Excel、TXT、图片、扫描件、网页等异构数据源;

-

精细信息提取

不仅识别文本,还能解析表格结构、图片中的文字(结合OCR),甚至理解PDF中的复杂排版;

-

无限token检索

无需担心文件过大导致信息丢失,能在海量数据中精准找到“关键信息针”。

. 2. 模板化分块:让“数据切割”更智能、可解释

文本分块是RAG的基础,分块质量直接影响检索效果。RAGFlow提供:

-

多场景模板

针对报告、合同、技术文档等不同类型,预置专属分块逻辑,无需手动调试;

-

透明可干预

分块过程可视化,开发者能清晰知道数据如何拆分,便于优化检索策略。

. 3. 接地引用:彻底告别大模型“幻觉”

“回答没依据”是LLM落地的重大风险,RAGFlow通过两大机制解决:

-

分块可视化干预

支持查看文本分块过程,避免关键信息被拆分或遗漏;

-

可追溯引用来源

生成回答时附带原始文档片段,每个结论都能对应到具体出处,既方便验证,也符合企业合规需求。

. 4. 自动化RAG工作流:从“配置到上线”零代码/低代码

无需手动拼接“解析-分块-召回-重排序-生成”等模块,RAGFlow已做好全链路封装:

-

多模型适配

支持OpenAI、Kimi、Grok、DeepSeek等主流LLM与嵌入模型,灵活切换;

-

智能检索策略

多轮召回(关键词+向量)结合融合重排序,提升检索精度;

-

便捷集成

提供直观API,轻松与现有业务系统对接(如客服、技术支持平台)。

三、2025最新更新:紧跟大模型技术前沿

RAGFlow的开发团队迭代非常活跃,2025年以来的关键升级值得关注,确保工具始终适配最新技术:

- 2025-08-08:支持OpenAI最新GPT-5系列模型,进一步提升生成质量;

- 2025-08-04:新增对Kimi K2、Grok 4的支持,模型选择更灵活;

- 2025-08-01:正式支持Agentic工作流与MCP(多组件协调平台),可搭建多Agent协作系统(如“技术支持Agent+检索Subagent”);

- 2025-05-23:为Agent新增Python/JavaScript代码执行器,支持自动运行代码处理数据(如计算、分析);

- 2025-03-19:接入多模态模型,可解析PDF/DOCX中的图片内容(如识别图表、截图文字);

- 2024年底:升级DeepDoc的文档布局分析模型,提升复杂格式文件解析成功率。

四、快速上手:3步启动RAGFlow服务

RAGFlow基于Docker部署,无需复杂环境配置,新手也能在10分钟内启动。

. 1. 确认环境要求

首先确保本地满足基础配置:

- CPU ≥ 4核,RAM ≥ 16GB,磁盘 ≥ 50GB;

- Docker ≥ 24.0.0 + Docker Compose ≥ v2.26.1;

- (可选)若需使用代码执行器,需额外安装gVisor。

. 2. 关键前置配置:调整内存映射限制

RAGFlow依赖的服务需要足够的内存映射,执行以下命令检查并设置:

# 1. 检查当前vm.max_map_count值sysctl vm.max_map_count# 2. 若小于262144,临时设置(重启后失效)sudo sysctl -w vm.max_map_count=262144# 3. 永久设置(推荐):编辑/etc/sysctl.confecho "vm.max_map_count=262144" | sudo tee -a /etc/sysctl.conf# 生效永久配置sudo sysctl -p

. 3. 克隆仓库并启动服务

# 1. 克隆RAGFlow源码git clone https://github.com/infiniflow/ragflow.git# 2. 进入Docker配置目录cd ragflow/docker# 3. 启动CPU版本(适合快速测试)docker compose -f docker-compose.yml up -d# 若有GPU(需NVIDIA Docker),启动GPU加速版(提升嵌入/解析速度)# docker compose -f docker-compose-gpu.yml up -d

. 4. 验证启动与访问

# 查看服务日志,确认启动成功docker logs -f ragflow-server# 成功标志:出现以下输出____ ___ ______ ______ __ / __ \ / | / ____// ____// /____ _ __ / /_/ // /| | / / __ / /_ / // __ \| | /| / / / _, _// ___ |/ /_/ // __/ / // /_/ /| |/ |/ / /_/ |_|/_/ |_|\____//_/ /_/ \____/ |__/|__/ * Running on all addresses (0.0.0.0)

启动成功后,浏览器输入 http://你的服务器IP(默认端口80,可省略),再在 service_conf.yaml.template中配置LLM API Key(如OpenAI、Kimi的Key),就能开始使用AI对话功能。

五、进阶配置:满足个性化需求

对于有定制化需求的开发者,RAGFlow提供多种进阶方案:

. 1. 选择合适的Docker镜像

RAGFlow提供4类镜像,可根据场景灵活选择:

| RAGFlow镜像标签 | 镜像大小 | 包含嵌入模型 | 稳定性 | 适用场景 |

|---|---|---|---|---|

| v0.20.5 | ≈9GB | ✔️ | 稳定版 | 生产环境,无需依赖外部嵌入服务 |

| v0.20.5-slim | ≈2GB | ❌ | 稳定版 | 测试/开发,依赖外部嵌入服务(如OpenAI Embeddings) |

| nightly | ≈9GB | ✔️ | 开发版 | 体验最新功能,不建议生产用 |

| nightly-slim | ≈2GB | ❌ | 开发版 | 轻量测试最新功能 |

切换镜像只需修改 docker/.env中的 RAGFLOW_IMAGE变量,例如:

RAGFLOW_IMAGE=infiniflow/ragflow:v0.20.5

. 2. 切换文档引擎:从Elasticsearch到Infinity

RAGFlow默认用Elasticsearch存储文本和向量,若需切换到高效向量数据库Infinity,步骤如下:

# 1. 停止并删除现有容器(注意:-v会清除数据,需提前备份)docker compose -f docker/docker-compose.yml down -v# 2. 修改docker/.env,设置文档引擎为infinityecho "DOC_ENGINE=infinity" | sudo tee -a docker/.env# 3. 重启服务docker compose -f docker-compose.yml up -d

⚠️ 注意:Linux/ARM64平台暂不支持Infinity引擎。

. 3. 从源码启动:适合二次开发

若需定制功能,可从源码启动服务:

# 1. 安装依赖工具pipx install uv pre-commit# 2. 克隆源码并安装Python依赖git clone https://github.com/infiniflow/ragflow.gitcd ragflow/uv sync --python 3.10 --all-extras # 安装Python依赖uv run download_deps.py # 下载额外依赖pre-commit install # 安装pre-commit钩子# 3. 启动依赖服务(MinIO、ES、Redis、MySQL)docker compose -f docker/docker-compose-base.yml up -d# 4. 配置hosts(将服务域名解析到本地)echo "127.0.0.1 es01 infinity mysql minio redis sandbox-executor-manager" | sudo tee -a /etc/hosts# 5. (可选)设置HF镜像(无法访问HuggingFace时)export HF_ENDPOINT=https://hf-mirror.com# 6. 安装jemalloc(提升内存效率)# Ubuntu: sudo apt-get install libjemalloc-dev# CentOS: sudo yum install jemalloc# macOS: sudo brew install jemalloc# 7. 启动后端服务source .venv/bin/activateexport PYTHONPATH=$(pwd)bash docker/launch_backend_service.sh# 8. 启动前端服务cd webnpm installnpm run dev

前端启动后,可通过 http://127.0.0.1:9222访问。

六、文档与社区:获取全方位支持

RAGFlow提供完善的文档和活跃的社区,助力开发者快速上手:

. 官方文档

涵盖从入门到进阶的全流程指南:

- 快速开始:新手入门步骤;

- 配置指南:环境变量、服务配置详解;

- 用户指南:文件上传、AI对话、Agent使用教程;

- 开发者指南:源码结构、二次开发教程;

- FAQs:常见问题解决方案。

. 社区渠道

有问题或想参与贡献,可通过以下渠道交流:

- Discord:实时沟通,获取官方支持;

- Twitter:关注最新动态;

- GitHub Discussions:分享使用经验、讨论技术问题;

- GitHub Issues:提交bug反馈或功能需求。

七、总结:为什么选择RAGFlow?

在众多RAG工具中,RAGFlow的核心优势很突出:

-

开源免费

无商业许可成本,可自由定制;

-

功能全面

RAG+Agent双核心,覆盖数据解析、检索、生成、协作全链路;

-

易上手

Docker一键部署,无需复杂配置;

-

高适配性

支持多模型、多数据源、多部署方式;

-

持续迭代

活跃的开发团队,频繁更新以支持最新技术(如GPT-5、Kimi K2)。

大模型未来如何发展?普通人如何抓住AI大模型的风口?

※领取方式在文末

为什么要学习大模型?——时代浪潮已至

随着AI技术飞速发展,大模型的应用已从理论走向大规模落地,渗透到社会经济的方方面面。

- 技术能力上:其强大的数据处理与模式识别能力,正在重塑自然语言处理、计算机视觉等领域。

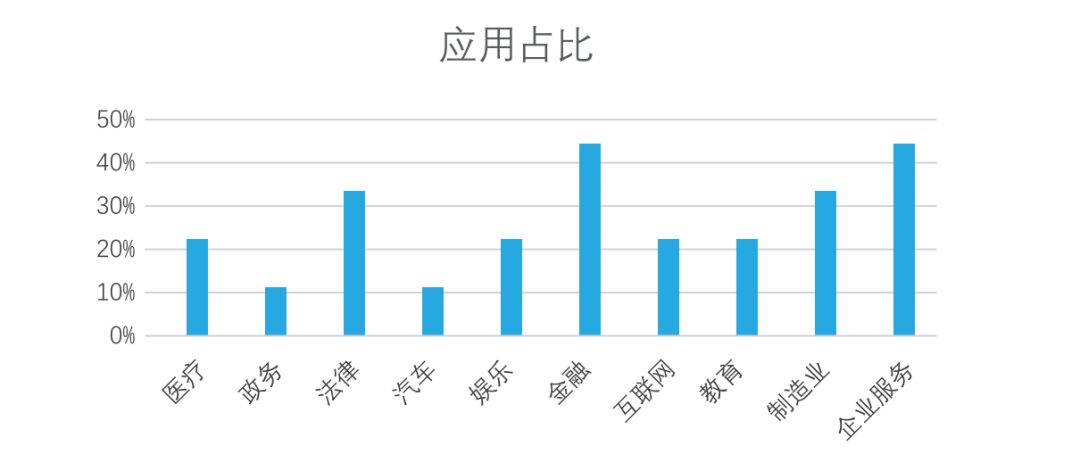

- 行业应用上:开源人工智能大模型已走出实验室,广泛落地于医疗、金融、制造等众多行业。尤其在金融、企业服务、制造和法律领域,应用占比已超过30%,正在创造实实在在的价值。

未来大模型行业竞争格局以及市场规模分析预测:

同时,AI大模型技术的爆发,直接催生了产业链上一批高薪新职业,相关岗位需求井喷:

AI浪潮已至,对技术人而言,学习大模型不再是选择,而是避免被淘汰的必然。这关乎你的未来,刻不容缓!

那么,我们如何学习AI大模型呢?

这份精心整理的AI大模型学习资料,我整理好了,免费分享!只希望它能用在正道上,帮助真正想提升自己的朋友。让我们一起用技术做点酷事!

ps:微信扫描即可获取

加上后我将逐一发送资料

与志同道合者共勉

真诚无偿分享!!!

适学人群

我们的课程体系专为以下三类人群精心设计:

-

AI领域起航的应届毕业生:提供系统化的学习路径与丰富的实战项目,助你从零开始,牢牢掌握大模型核心技术,为职业生涯奠定坚实基础。

-

跨界转型的零基础人群:聚焦于AI应用场景,通过低代码工具让你轻松实现“AI+行业”的融合创新,无需深奥的编程基础也能拥抱AI时代。

-

寻求突破瓶颈的传统开发者(如Java/前端等):将带你深入Transformer架构与LangChain框架,助你成功转型为备受市场青睐的AI全栈工程师,实现职业价值的跃升。

※大模型全套学习资料展示

通过与MoPaaS魔泊云的强强联合,我们的课程实现了质的飞跃。我们持续优化课程架构,并新增了多项贴合产业需求的前沿技术实践,确保你能获得更系统、更实战、更落地的大模型工程化能力,从容应对真实业务挑战。 资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

01 大模型系统化学习路线

作为学习AI大模型技术的新手,方向至关重要。 正确的学习路线可以为你节省时间,少走弯路;方向不对,努力白费。希望这份最科学最系统的学习成长路线图和学习规划,带你从零基础入门到精通!

👇微信扫描下方二维码即可~

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

02 大模型学习书籍&文档

新手必备的权威大模型学习PDF书单来了!全是一系列由领域内的顶尖专家撰写的大模型技术的书籍和学习文档(电子版),从基础理论到实战应用,硬核到不行!

※(真免费,真有用,错过这次拍大腿!)

03 AI大模型最新行业报告

2025最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

04 大模型项目实战&配套源码

学以致用,在项目实战中检验和巩固你所学到的知识,同时为你找工作就业和职业发展打下坚实的基础。

05 大模型大厂面试真题

面试不仅是技术的较量,更需要充分的准备。在你已经掌握了大模型技术之后,就需要开始准备面试,我精心整理了一份大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

06 全套AI大模型应用开发视频教程

(包含提示工程、RAG、LangChain、Agent、模型微调与部署、DeepSeek等技术点)

由于篇幅有限

只展示部分资料

并且还在持续更新中…

ps:微信扫描即可获取

加上后我将逐一发送资料

与志同道合者共勉

真诚无偿分享!!!

最后,祝大家学习顺利,抓住机遇,共创美好未来!

更多推荐

已为社区贡献78条内容

已为社区贡献78条内容

所有评论(0)