简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

如果你正在为"海量文件存储选型"头疼,或者你的团队正在经历从 FastDFS 的"年久失修"到 Ceph 的"部署文档看了一周还没装好"的痛苦,那么这篇文章就是为你准备的。MinIO——这个 GitHub 星标突破 58.9K、Docker 下载量超 10 亿次的开源明星项目,正在 2026 年经历从"分布式存储工具"到"AI 数据底座"的战略升级。但与此同时,MinIO 社区版于 2025 年

AI Agent 90% 的工作量都在"AI"之外。512,000 行代码的分布:├── 模型调用 & API 通信 ~5%├── 工具系统 & 权限管理 ~25%├── 上下文工程 & 压缩 ~15%├── UI/UX & 终端渲染 ~20%├── 生态集成 & 扩展 ~15%├── 会话管理 & 持久化 ~10%└── 遥测 & 监控 & 安全 ~10%信任工程:如何让 AI 在真实环境中安全

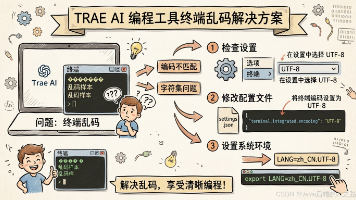

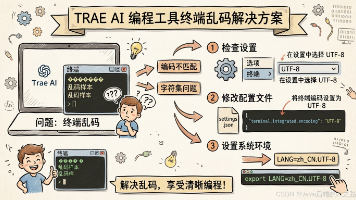

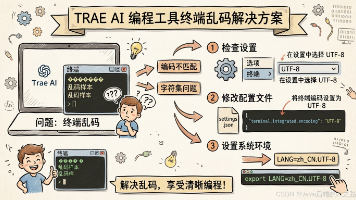

TRAE终端乱码通常与系统本地化环境变量的字符编码设置有关。根据文档内容,TRAE CLI 会根据系统的本地化环境变量自动选择答复语言,若这些变量配置不当(如未使用 UTF-8 编码),可能导致终端显示乱码。

TRAE终端乱码通常与系统本地化环境变量的字符编码设置有关。根据文档内容,TRAE CLI 会根据系统的本地化环境变量自动选择答复语言,若这些变量配置不当(如未使用 UTF-8 编码),可能导致终端显示乱码。

TRAE终端乱码通常与系统本地化环境变量的字符编码设置有关。根据文档内容,TRAE CLI 会根据系统的本地化环境变量自动选择答复语言,若这些变量配置不当(如未使用 UTF-8 编码),可能导致终端显示乱码。

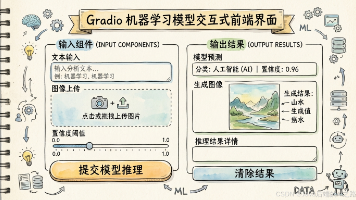

Gradio 是一个开源 Python 库,允许开发者无需掌握 JavaScript、CSS 或 Web 部署知识,即可将任何机器学习模型、API 或 Python 函数直接转化为一个拥有现代界面的、可公开访问的 Web 应用。它基于 FastAPI 和 Svelte 构建,兼具高性能后端与现代前端渲染能力。通俗理解:Gradio 就像给 Python 函数穿上一件“自动生成的漂亮衣服”。你的模型

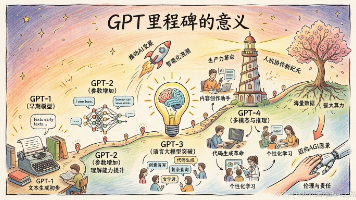

大白话:模型不只是输出文字,还能输出结构化的 JSON 告诉我“我要调用的 API 是哪一个,参数是什么”,从而让你连接外部工具执行实际操作。GPT-2 拿了 15 亿参数(当时巨大),发现“什么都不改,只是把模型和数据怼上去”,就能 zero-shot 完成很多任务。大白话:不给模型更新权重,而是直接在输入里塞几个“问题-答案”的例子,模型看过例子后,瞬间就能模仿着给出新答案。输入可以是图+文,

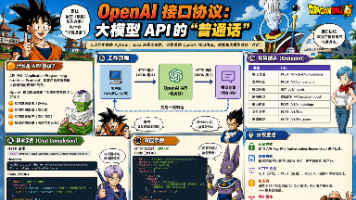

流式调用基于一个叫 SSE(Server-Sent Events,服务端推送事件)的协议。不需要深入了解 SSE 的所有细节,只要理解它的核心思想就行。普通的 HTTP 请求是一问一答的模式:客户端发一个请求,服务端返回一个完整的响应,然后连接就关闭了。SSE 不一样:客户端发出请求后,服务端不会一次性返回所有内容然后关闭连接,而是保持连接打开,持续地往客户端推送数据块。每个数据块是一行文本,以开

摘要(149字): Prompt工程通过结构化指令优化大模型输出质量。核心框架包含五要素:角色(定义边界)、任务(明确目标)、约束(限制行为)、输入(规范数据源)、输出(定义格式)。示例显示,优质Prompt能精准控制模型仅依据参考资料作答,避免预训练知识干扰,并规范引用标注(如"[1]")。在RAG场景中,需分隔输入块、排序关键信息、控制Token数,输出时要求先结论后依据、

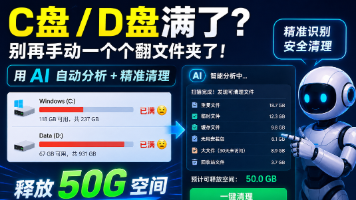

✅重复文件:同一个文件存在多份,删掉重复的✅下载的安装包:确认软件已安装,压缩包可以删✅临时/缓存文件:.tmp、.cache、.bak 等✅超过3个月未访问的日志文件:一般用不上了清理磁盘这事,工具不是重点,思路才是先扫描,再分类—— 不要盲目删除先备份,再清理—— 重要数据多留一份先评估风险,再动手—— 系统文件和程序文件要谨慎让 AI 做分析,自己做决策—— AI 告诉你能删什么,你决定要不