简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

他们进一步开发了多 agent 框架 LearnAct,其能够自动从演示中提取知识,从而提高任务完成度,集成了三个专业 agent:用于知识提取的 DemoParser、用于相关知识检索的 KnowSeeker 和用于演示增强任务执行的 ActExecutor。实验结果表明,在离线和在线评估中,模型性能都有显著提高。通过实证分析,来自香港科技大学和蚂蚁集团的研究团队揭示了 LRM 行为的一个重要特

免费计划的v0 用户现在最多可以创建 3 个项目。项目允许你设置自定义指令并将你自己的源代码引入v0.1 版本。,时长00:53这一条挺不错的,至少你可以和Cursor更好联动。你现在可以选择 UI 生成的特定部分进行更改。,时长00:19多文件联合修改(以前是不支持的)v0 现在也可以通过自定义子域部署到 Vercel。,时长00:24v0 可以连接到数据库、API和其他外部服务。,时长01:0

本文提出了Janus框架,通过解耦视觉编码路径来提升多模态理解与生成性能,并超越现有统一模型。论文题目: Janus: Decoupling Visual Encoding for Unified Multimodal Understanding and Generation论文链接: https://arxiv.org/abs/2410.10486PS: 欢迎大家扫码关注公众号^_^,我们一起在

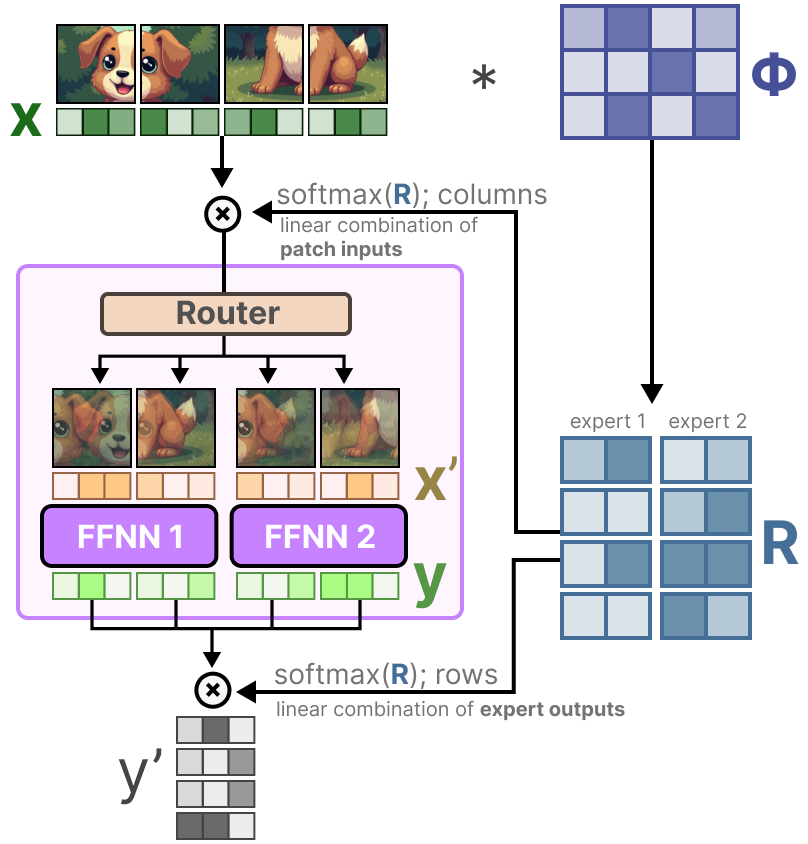

混合专家(MoE)是一种利用多个不同的子模型(或称为“专家”)来提升LLM质量的技术。MoE的两个主要组成部分是:专家:每个前馈神经网络(FFNN)层现在都有一组“专家”,可以选择其中的一部分。这些“专家”通常也是FFNN。路由或门控网络:决定哪些词元发送到哪些专家。在每个具有MoE的模型层中,我们会找到(相对专业化的)专家:需要注意的是,“专家”并不专注于特定领域,如“心理学”或“生物学”。专家

不过 Gemini-exp-1114在被问到是谁创造和自己是谁时,竟然回答Anthropic 和 Claude。网友戏称,最让人感到直观的解释就是使用Claude生成的数据训练的。可惜代码能力逊色了一点,从图中我们可以看到与 o1-mini/preview 还是有一定差距的。目前,Gemini-Exp-1114 可以在谷歌AI Studio 对话体验。图中有多少水果,哪一种最小,哪一种酸性最强,它

另外,我们也发现这些针对于C端提供的编程助手,在引入Agent以后,对整体的项目改动是没有严格边界的,有的时候会改动程序员不希望修改的很多文件,导致程序员并不知道自己的哪些项目被修改过。,同时需要紧贴着企业的软件开发框架,将企业内部那些稳定的、大量的业务逻辑和高频代码场景,利用AI的方式找出来并提取为Prompt体系,然后在用户输入的应用节点,以背景信息的形式、灵活的以智能化的方式提供给大模型,从

VITA-1.5 是一款开源的交互式多模态大型语言模型,实现接近实时的视觉和语音交互体验。相较于之前的VITA-1.0版本,VITA-1.5 在多个方面取得了显著进步。VITA-1.5 还采用了渐进式训练策略,确保在加入语音模态时,对其他多模态性能的影响最小化。该模型。

在插入新弹匣的瞬间,一发流弹几乎擦着TA的头飞过,迫使TA猛地一缩头 (6-7s)。的森林小径渐行渐远,她长发飘逸,乌黑顺直,浅色肌肤在自然光线下更显细腻。中景,跟随女子背影的视角,展现她融入。输入提示词“老虎怒吼后猛然冲向镜头,张口扑咬,巨大的身体掀翻树木,镜头剧烈晃动,模拟第一人称逃跑视角,穿越丛林,狂奔躲避追击,树枝划过镜头,恐惧与速度并存”看电影时,你忘了他是影帝,你沉浸到剧情里,忘了他是

2025年2月,前OpenAI和特斯拉AI团队领导者Andrej Karpathy在社交平台X上发布了一条引发广泛讨论的帖子,提出了"Vibe Coding"(感觉式编程)的概念。这一概念描述了开发者"完全沉浸在感觉中",依靠大语言模型(LLM)生成代码而无需理解输出的开发方式。短短两个月内,Vibe Coding迅速成为科技圈热门话题,甚至被美国韦氏词典收录为"俚语和流行词"。简单来说,Vibe

模型编辑是一个高效更新大模型内部所存储知识(如错误、过时和不安全知识)的技术。与微调相比,它的主要优势有两个:1.可以定向更新任意数量的知识(可少至几条),而不用担心过拟合、灾难性遗忘等问题。2.几乎是无需训练(Training Free)的,实时性强。一个很直观的问题是,在这个微调技术茁壮成长、层出不穷的时代,为什么我们需要模型编辑?上述俩个优势,到底会给它带来怎样的应用空间呢?叶问外传》中有一