简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

2026 年 5 月 28 日,Anthropic 在发布 Claude Opus 4.8 的同一天,把 Claude Code 的新功能作为研究预览版(research preview)放了出来。老版本的 Claude Code 是从一次对话轮次出发,一步一步顺着往下处理。而 Dynamic Workflows 的玩法完全不同——它会。像整个代码库的迁移、安全审计、多来源调研这类大活儿,现在可以

2026 年 5 月 28 日,Anthropic 在发布 Claude Opus 4.8 的同一天,把 Claude Code 的新功能作为研究预览版(research preview)放了出来。老版本的 Claude Code 是从一次对话轮次出发,一步一步顺着往下处理。而 Dynamic Workflows 的玩法完全不同——它会。像整个代码库的迁移、安全审计、多来源调研这类大活儿,现在可以

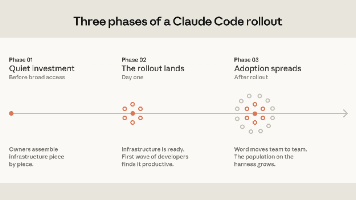

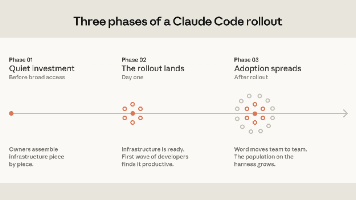

这篇文章是系列的第一篇,聚焦于工程团队在企业级场景下使用 Claude Code 的最佳实践。

用过 Claude Code 的人应该都有这个体验——让它分析一个稍微大点的项目,它就开始疯狂调用 grep、glob、Read,一个架构问题下去,几十个工具调用跑完,token 哗哗地流走了,钱包也跟着疼。这个项目叫,专门针对这个问题设计的。,MIT 协议,感兴趣直接去试。

本文对大语言模型幻觉检测领域的关键数据集进行了系统性的梳理、分析与分类。我们首先从海量文献中萃取了涵盖不同任务、领域和模态的代表性数据集,并在此基础上构建了一个四维分类体系,即事实核查、问答、多模态幻觉检测和专业化基准。该体系为理解当前幻觉评估的全景提供了结构化的视角。通过对各类数据集的横向对比,我们揭示了其在评估目标、优势和局限性上的差异。

SDD做的事情,是把规范从被动文档转化成可执行的构建关卡,让架构契约在每一轮代码生成里都得到强制执行。大语言模型只在功能正确性这个窄维度上做了优化,但企业系统要的是架构一致性和监管合规,SDD正好把这中间的缺口补上。笔者的建议是:从规范优先模式开始,挑一个已经有OpenAPI契约的服务作为起点,把GitHub Spec Kit集成进CI/CD,等多团队协作扩大了再升级到规范锚定治理。这条路走通了,

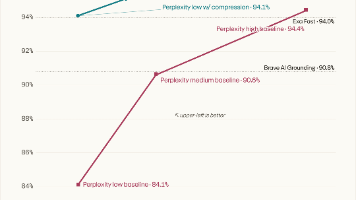

AI 系统要聪明高效地服务用户,依赖的是高信噪比的信息。这些信息必须尽可能精准,才能最大化对每个请求的相关性。Perplexity 新的查询感知压缩模型做的正是这件事——最大化每个 snippet 中的有效证据,同时大力删减无关干扰项。把这些新模型部署进搜索栈之后,无论是产品用户还是 API 客户,都能获得更快、更好的回答。而且这套方案还提供了一个简单的调节旋钮,可以根据需求在召回率、延迟和成本之

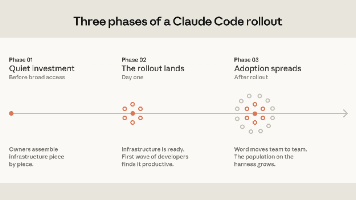

这篇文章是系列的第一篇,聚焦于工程团队在企业级场景下使用 Claude Code 的最佳实践。

这篇文章是系列的第一篇,聚焦于工程团队在企业级场景下使用 Claude Code 的最佳实践。

Anthropic 最近出了一份实用性很强的创业指南——《The Founder’s Playbook: Building an AI-Native Startup》,专门写给那些想从第一天就把 AI 当作公司基础设施来搭建的创始人。这份手册把创业生命周期拆成四个阶段:创意期、MVP 期、发布期和规模化期,逐一梳理了每个阶段该做什么、怎么用 AI 工具提速,以及有哪些坑要提前绕开。下载地址:htt