简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

*sys:**内核态CPU时间(程序在内核空间执行系统调用所消耗的CPU时间)程序申请内核服务(如文件读写、内存分配、网络通信)时,内核为你工作的时间。**user:**用户态CPU时间(程序在用户空间执行代码所消耗的CPU时间)程序自己的逻辑代码(如循环、计算、函数调用)占用CPU的时间总和。**real:**实际流逝的时间(从命令开始到结束的墙上时间)就像用秒表计时的总时间,包括了程序运行、等

*sys:**内核态CPU时间(程序在内核空间执行系统调用所消耗的CPU时间)程序申请内核服务(如文件读写、内存分配、网络通信)时,内核为你工作的时间。**user:**用户态CPU时间(程序在用户空间执行代码所消耗的CPU时间)程序自己的逻辑代码(如循环、计算、函数调用)占用CPU的时间总和。**real:**实际流逝的时间(从命令开始到结束的墙上时间)就像用秒表计时的总时间,包括了程序运行、等

对比了下,Addcmul这个名字单词并没拼错,只是名字大小写不一致,莫非是因为这个导致的?PS:研发的同学是不是应该在-n的help解释上多写上几句话的说明。中的指导进行操作的,反复检查了下,并没有发现问题。汗,最终原因就是编译算子的大小写拼音问题。到这里,猜测是算子名字写错了吗?下找proto.cpp文件。还是通过报错进行分析,打开。-n是执行单独的算子编译。果然,顺利的执行下去了。记录一下吧,

Ascend C和cudnn相似,都是一种多核心编程的范式。想要了解Ascend C,必须得先掌握这种“多核”是怎么实现得。

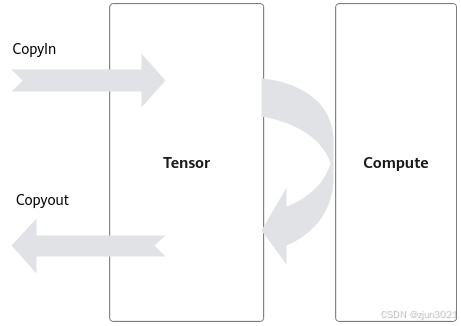

在此过程中,数据搬运与Vector计算串行执行,Vector计算单元无可避免存在资源闲置问题。举例而言,若CopyIn、Compute、CopyOut三阶段分别耗时t,则Vector的时间利用率仅为1/3,等待时间过长,Vector利用率严重不足。如图1所示,考虑一个完整的数据搬运和计算过程,CopyIn过程将数据从Global Memory搬运到Local Memory,Vector计算单元完成

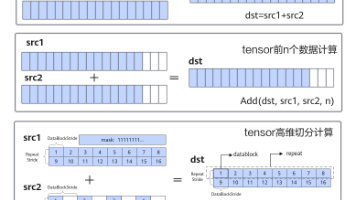

标量计算API,实现调用Scalar计算单元执行计算的功能。矢量计算API,实现调用Vector计算单元执行计算的功能。矩阵计算API,实现调用Cube计算单元执行计算的功能。数据搬运API,计算API基于Local Memory数据进行计算,所以数据需要先从Global Memory搬运至Local Memory,再使用计算API完成计算,最后从Local Memory搬出至Global Mem

MindIE Service是面向通用模型场景的推理服务化框架,通过开放、可扩展的推理服务化平台架构提供推理服务化能力,支持对接业界主流推理框架接口,满足大语言模型的高性能推理需求。