简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

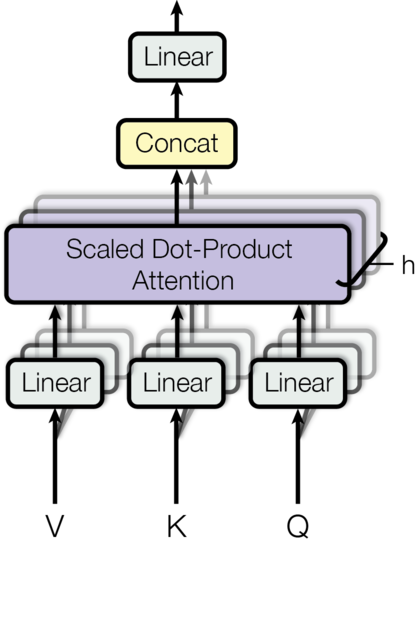

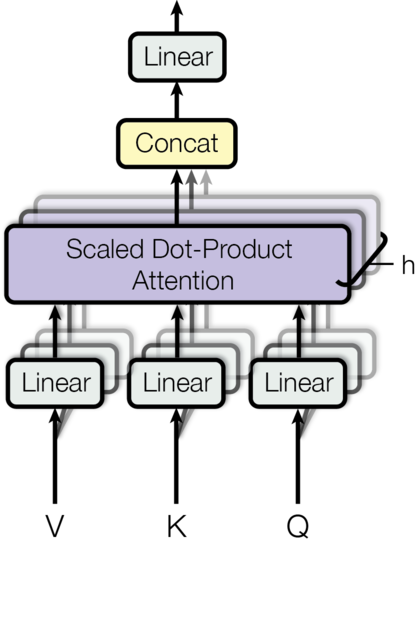

自从Transformer[3]模型在NLP领域问世后,基于Transformer的深度学习模型性能逐渐在NLP和CV领域(Vision Transformer)取得了令人惊叹的提升。本文的主要目的是介绍经典Transformer模型和Vision Transformer的技术细节及基本原理,以方便读者在CV领域了解和使用Vision Transformer。......

使用opencv实现matlab中的imfill填充孔洞功能,整体思路如下:1.首先给原始图像四周加一圈全0,并保存为另一幅图像2.使用floodFill函数给新图像进行填充,种子点设置为Point(0, 0),填充颜色为全白。因为原始图像四周加了一圈0,因此使用floodFill填充之后,整个图像除了原始图像中内部的点是黑色之外其他地方全是白色。3....

阈值分割方法虽然简单,但是如果场景简单,还是可以尝试使用的,因为其消耗的时间较少。同时,阈值分割也可以作为一个baseline来验证提出的新算法是否有效。本文主要介绍了OpenCV中介绍的两种自适应阈值分割算法,在实际工程中较常使用。

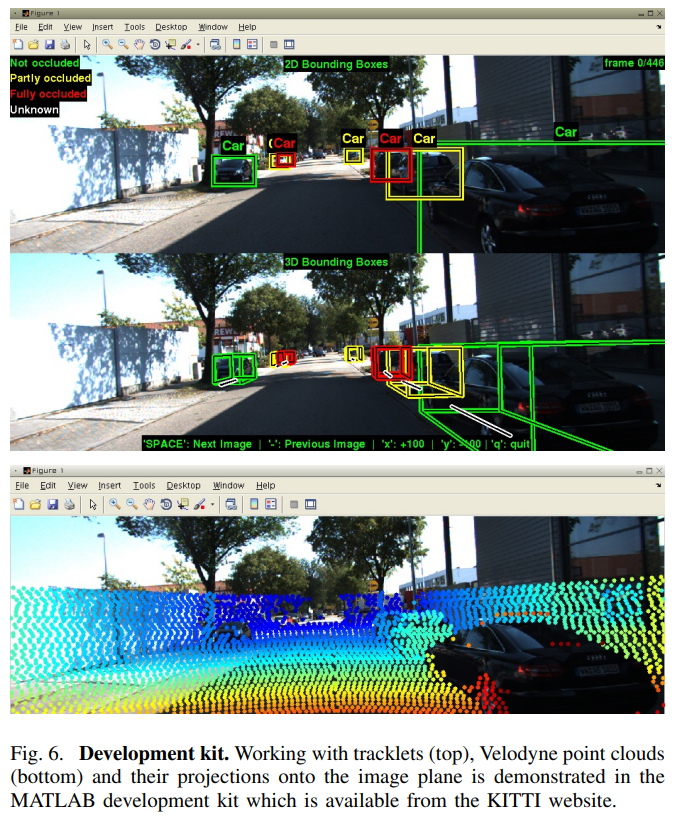

KITTI数据集是由德国卡尔斯鲁厄理工学院和丰田美国技术研究院联合创办,利用组装的设备齐全的采集车辆对实际交通场景进行数据采集获得的公开数据集。该数据集包含丰富多样的传感器数据(有双目相机、64线激光雷达、GPS/IMU组合导航定位系统,基本满足对图像、点云和定位数据的需求)、大量的标定真值(包括检测2D和3D包围框、跟踪轨迹tracklet)和官方提供的一些开发工具等。...

自从Transformer[3]模型在NLP领域问世后,基于Transformer的深度学习模型性能逐渐在NLP和CV领域(Vision Transformer)取得了令人惊叹的提升。本文的主要目的是介绍经典Transformer模型和Vision Transformer的技术细节及基本原理,以方便读者在CV领域了解和使用Vision Transformer。......

一、特征提取概念:特征是某一类对象区别于其他类对象的特点,通过测量或者处理取得的数据通常将多个特征组合到一起,形成一个向量。一个N维的特征就是N维空间中的一个点常用的特征:1、区域描述子周长、面积、紧致性(C = 1-4*pi*a/p^2)、灰度均值、灰度方差2、形状特征傅里叶描述子 :基本思想是将形状曲线建模为一维序列,然后进行傅里叶变换,从而得到傅里叶描述子