简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

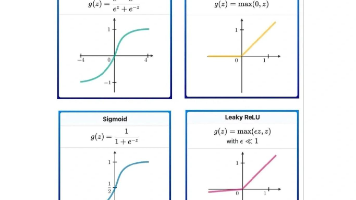

本文解析了神经网络激活函数的核心作用与选型建议。激活函数通过引入非线性特性使网络能学习复杂模式,其作用包括控制输出范围(如Sigmoid输出概率、ReLU过滤负值)和优化训练动态(缓解梯度消失)。常见激活函数分为饱和类(Sigmoid/Tanh)和非饱和类(ReLU/LeakyReLU),分别适用于不同场景:二分类输出推荐Sigmoid,CNN隐藏层优选ReLU,RNN适合Tanh。深层网络建议使

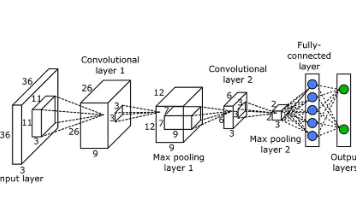

感受野是CNN中特征图神经元对应输入图像的区域范围,决定网络捕捉局部细节和全局语义的能力。浅层感受野小,提取边缘特征;深层感受野大,整合物体级信息。计算时需反向递推,受卷积核、步长和空洞率影响。目标检测、分割等任务需平衡感受野与分辨率,常用空洞卷积或多尺度融合优化。动态感受野和注意力机制是未来趋势,使网络更自适应地利用空间上下文。理解感受野对CNN结构设计和性能提升至关重要。

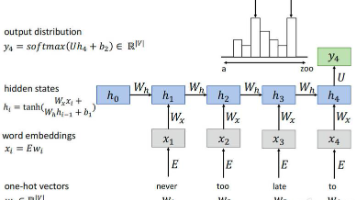

传统RNN通过单一隐藏状态ht传递序列信息,其计算过程为ht=tanh(Wxhxt + Whh ht-1+bn),但长序列中易因梯度连乘导致信息丢失;而LSTM引入细胞状态Ct作为长期记忆载体,通过遗忘门ft、输入门it和输出门ot构成的门控机制选择性调控信息流,使隐藏状态ht = ot ⊙tanh(Ct)仅输出与当前相关的短期信息,从而有效解决梯度消失问题并捕捉长期依赖;因此,RNN适用于短

Python中的asyncdef用于定义异步函数,是异步编程的核心。异步函数通过await调用其他异步操作,适用于IO密集型任务(如网络请求、数据库查询)和高并发场景,能提升效率但不适合CPU密集型计算。调用异步函数需通过事件循环(如asyncio.run())或await,常见于FastAPI等框架。注意避免同步阻塞操作,正确使用await。异步编程可提升IO应用性能,但会增大代码复杂度,需根据

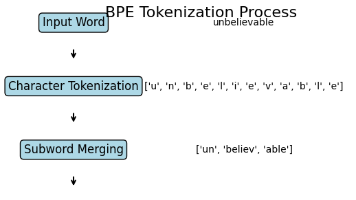

BPE(字节对编码)是一种基于统计的子词分词算法,通过合并高频字符对构建紧凑词汇表,广泛应用于NLP任务。其核心优势在于处理未登录词和减小词汇量,适用于机器翻译、语言建模等场景。BPE先将文本拆分为字符,迭代合并高频字符对形成子词单元,直到达到预设词汇量。相比传统分词,它能更好处理稀有词,但可能产生过度碎片化问题。Python的subword-nmt库提供了便捷实现方式。尽管BPE在语义捕捉方面存

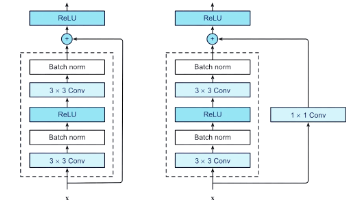

ResNet(残差网络)是深度学习里程碑式架构,由何恺明团队2015年提出,首次成功训练超100层的神经网络。其核心创新是残差连接(Shortcut Connection),通过让网络学习输入与输出的差值而非直接映射,解决了深度网络的梯度消失/爆炸和退化问题。典型结构包含BasicBlock(浅层网络)和BottleneckBlock(深层网络)两种残差模块,衍生出ResNet18/34/50/1

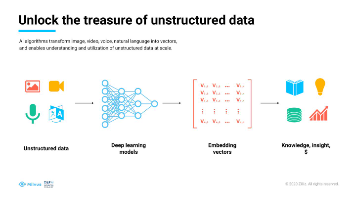

Chroma、Faiss与Milvus:三大向量数据库对比 Chroma、Faiss和Milvus均为高维向量数据处理工具,但设计目标和适用场景不同: Chroma:轻量级开源向量数据库,提供简单API,适合中小规模应用及快速原型开发,支持本地存储和基本分布式部署。 Faiss:由Facebook开发,专注高效相似性搜索,支持GPU加速,适合单机大规模数据检索,但缺乏原生分布式支持。 Milvus

Milvus是一款开源的向量数据库,专注于高效存储和检索大规模高维向量数据。它采用先进的索引算法(如IVF、HNSW、ANNOY)和多种距离度量方式(欧式距离、余弦相似度等),适用于推荐系统、计算机视觉、自然语言处理等场景。其分布式架构支持横向扩展,具备高并发查询能力,并实现存储与计算分离。Milvus提供多语言API和工具集,支持Docker/Kubernetes部署,但对集群配置要求较高。作为

机器学习是人工智能的核心分支,通过算法让计算机从数据中自动学习规律并做出预测或决策,无需显式编程。其核心在于数据驱动,利用统计学、优化理论等跨学科方法构建数学模型,实现分类、回归、聚类等任务。根据学习范式,机器学习分为:监督学习(如线性回归、决策树),依赖标注数据训练模型;无监督学习(如K-means、PCA),挖掘无标签数据的内在结构;强化学习(如Q-learni

Milvus是一个高性能开源向量数据库,支持多种安装方式。Docker安装最为便捷,通过拉取官方镜像并使用docker-compose启动服务;源码安装适合开发者,需预先安装Go、CMake等工具;二进制文件安装则直接下载预编译版本运行。所有方法启动后均可通过19530端口或Web界面验证服务状态。安装过程中需注意端口配置和依赖服务检查,常见问题包括端口冲突和依赖服务未启动等。