简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Higress希望通过内置Waf模块,使得用户的请求链接只经过Higress就可以同时完成Waf防护、流量分发、微服务治理,既可以降低链路RT,也可以降低网关的运维复杂度。命令来搜索并删除这些文件:这条命令会在整个系统中搜索文件或文件夹名包含“higress”的所有项,并将其删除。Standalone 模式没有大规模生产使用过,目前主要用于本地部署测试的场景,如果生产部署更建议。这条命令会强制删除

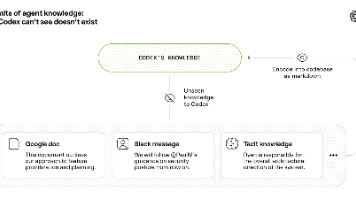

提示词工程, rag工程, agent 工程分别是什么什么样的工程才叫/ 才能叫harness 工程?与上面的三种有什么区别?“Harness"直译是"挽具”——套在马身上让马能拉车的装置。马有力量(agent 有能力),但没有挽具它无法有效做功。环境可读性——让 agent 能"看见"它需要的一切。OpenAI 团队将 AGENTS.md 做成目录而非百科全书,建立结构化的 docs/ 知识库,

TRL 是一个面向后训练(post-training)的前沿库,支持 SFT、GRPO、DPO 等技术,构建于 🤗 Transformers 生态之上,可跨多种硬件规模扩展。

在特定场景下很有用,但是编者建议在设计数据库和应用时仔细考虑数据的存储方式,力求达到既方便又高效的平衡。尽可能遵循数据库正规化原则,并在性能关键的应用中避免过度依赖如。是MySQL中的一个函数,用于查找一个字符串在一个逗号分隔的字符串列表中的位置。这个函数返回字符串在列表中的位置,位置计数从1开始。如果未找到该字符串,函数返回0。这样无法利用索引优化的函数。这个查询将返回2,因为。

Higress希望通过内置Waf模块,使得用户的请求链接只经过Higress就可以同时完成Waf防护、流量分发、微服务治理,既可以降低链路RT,也可以降低网关的运维复杂度。命令来搜索并删除这些文件:这条命令会在整个系统中搜索文件或文件夹名包含“higress”的所有项,并将其删除。Standalone 模式没有大规模生产使用过,目前主要用于本地部署测试的场景,如果生产部署更建议。这条命令会强制删除

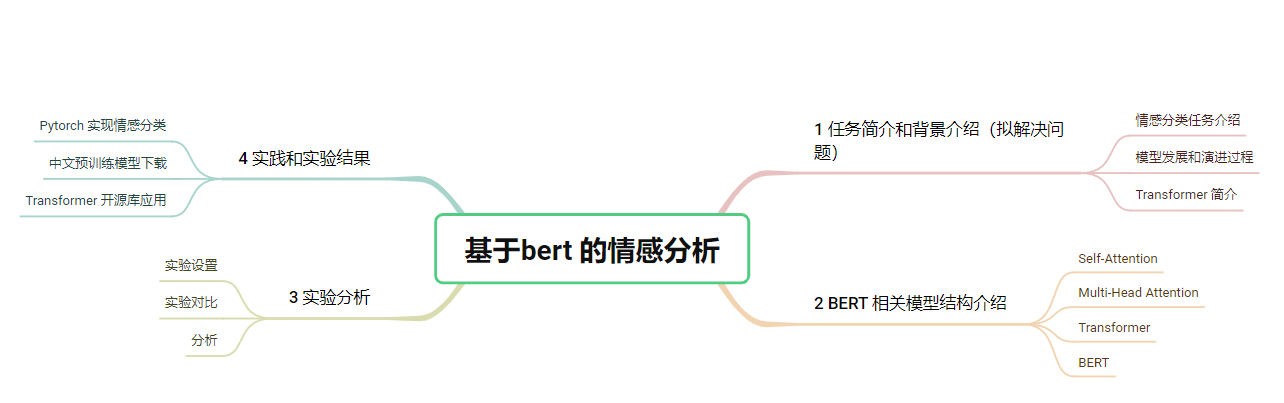

自注意力多头自注意力Transformer (双向)

由于self - attention一般都是在big model 的一部分,所以,一般不会对模型造成决定性的影响, 只有当model 的输入较长的时候, 例如图中: 图片处理 : 256 * 256 的输入,self-attention就会得到一个 256 *256 的平方的 矩阵;// todo 这是因为自注意力机制的目的是计算序列中每个元素对于序列中每个其他元素的注意力得分,所以我们需要一个

大于1 的点在我们这个模型里被认为是不应该存在的,超过了我的值域(ps:刚刚小憩了半个小时,真管用哇,本来想不通的东西困得不行还头疼,一下子想清楚啦哈哈)今天上了一整天的课, 本来实在是更新不动了,但是看到《剑来》更新了,想一想这本书里面一直强调的成功的feature – 心性,嗯心性坚毅就好!xdm 绷不住了,学到这里的时候图书馆的朗读亭里有小姐姐唱歌了 爱的回归线 哈哈哈哈哈哈哈哈哈哈哈(那个

随机初始数据fi1∑nyi−w0w1xi))2对loss 求w0 和w1 的偏微分,解方程组可得w1n∑xi2−∑xi2n∑xiyi−∑xi∑yiw0n∑xi2−∑xi2∑xi2∑yi−∑xi∑xiyi。