简介

该用户还未填写简介

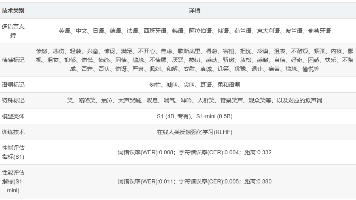

擅长的技术栈

可提供的服务

暂无可提供的服务

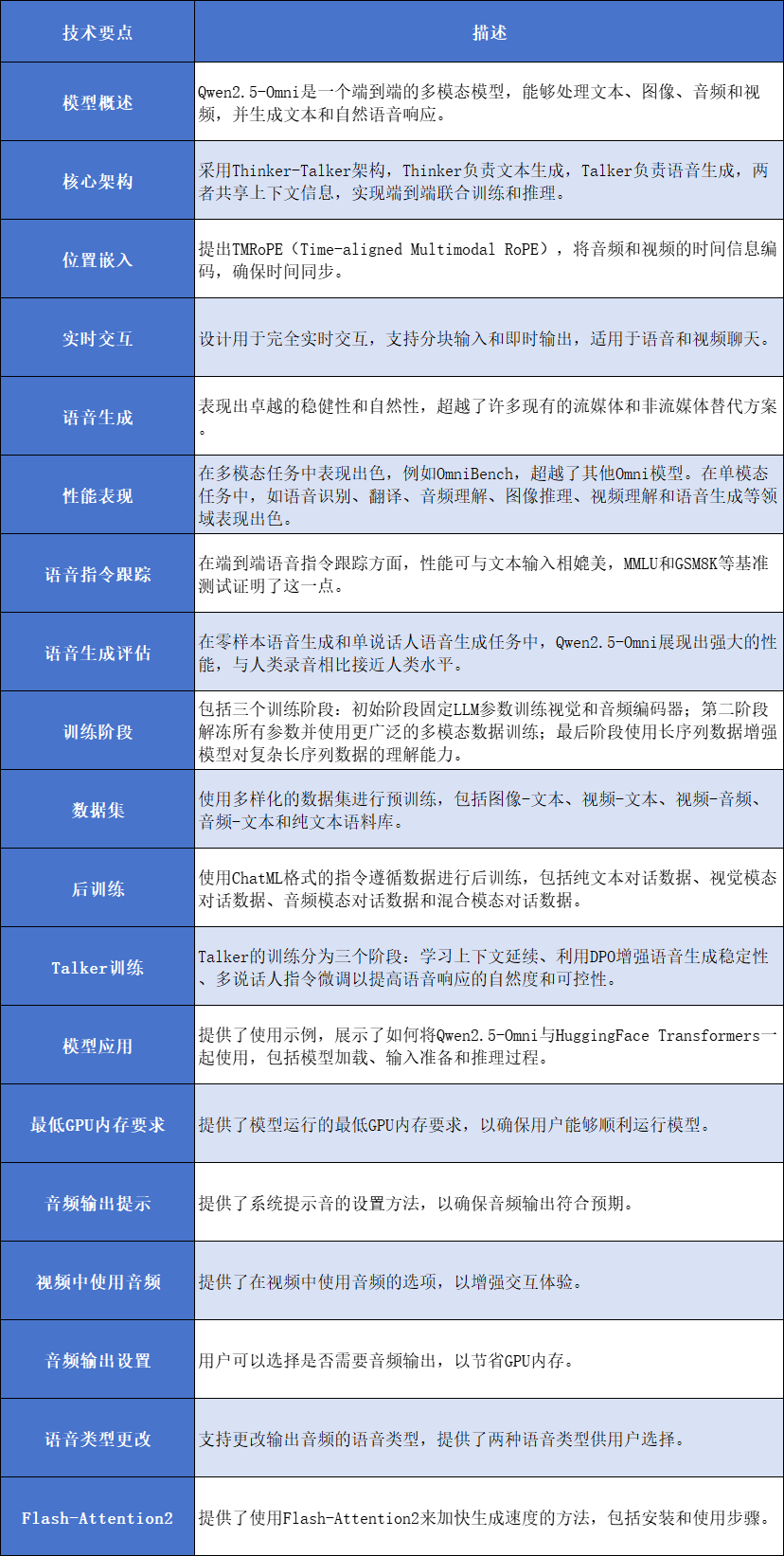

II-Medical-8B-1706是由智能互联网研发的医疗推理大语言模型,基于Qwen3-8B进行优化,专注于提升医学问答能力。该模型采用两阶段训练方法:首先进行监督微调(SFT),随后通过强化学习(RL)优化医学推理和安全响应能力。在HealthBench等10个医疗基准测试中表现优异,多项指标超过70分,与MedGemma-27B性能相当。训练数据包含230万样本,涵盖公共数据集和合成数据,

论文介绍了AM-DeepSeek-R1-Distilled数据集,这是一个包含140万条带推理痕迹的通用推理任务数据集,涵盖了高质量且具有挑战性的推理问题。数据从多个开源数据集中收集,经过语义去重和精细清洗...

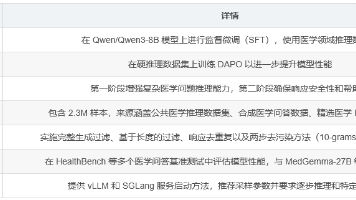

Qwen2.5-Omni在多模态任务中表现出色,不仅在需要集成多种模态的复杂任务中表现出色,而且在单模态任务中也展现了强大的性能。其创新的架构和位置嵌入方法使其在实时交互和语音生成方面具有显著优势。未来,Qwen团队计划进一步提升模型的性能和输出能力,以推动人工通用智能(AGI)的发展。

Kokoro是一个拥有8200万参数的开源权重文本转语音(TTS)模型。尽管其架构轻量,但能够提供与大型模型相当的语音质量,同时在速度和成本效率方面具有显著优势。该模型采用Apache许可证,可以在生产环境和个人项目中自由部署。

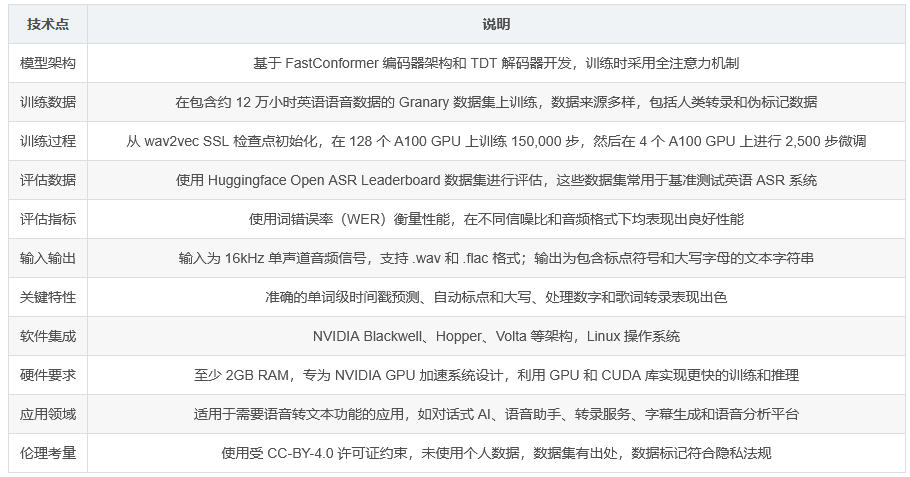

6 亿英语该模型是一款高品质英语转录的自动语音识别(ASR)模型,具备以下特点:能对音频进行准确的标点符号和大写字母预测能准确预测单词级别的时间戳在处理数字和歌词转录方面表现出色它基于 FastConformer 编码器架构和 TDT 解码器开发,训练时采用全注意力机制,可高效转录长达 24 分钟的音频片段。

Chatterbox TTS是Resemble AI推出的首个生产级开源文本转语音模型,采用MIT许可证。该模型基于0.5B参数的Llama主干,在50万小时清洁数据上训练,具有零样本TTS能力、独特的情感夸张控制功能,并支持语音转换。对比评估显示其性能优于ElevenLabs等封闭系统。安装简便,用户可通过Python脚本轻松生成语音,还能调整语音表达强度。模型包含感知水印技术,适用于视频、游戏

OpenAudio S1是一款先进的文本转语音(TTS)模型,支持13种语言,在200万小时音频数据上训练。提供两种模型版本:4B参数的完整版和0.5B参数的mini版。其独特之处在于支持50多种情感表达(如愤怒、快乐、悲伤等),多种语调(如耳语、喊叫)以及特殊声音效果(笑声、哭声等)。模型采用强化学习优化,在语音准确性评测中表现优异,词错误率低至0.008。该技术可用于各类需要自然语音合成的应用

1.在gguf文件目录新建文本文件Modelfile。2.调整第一行模型名称。

Kimi-VL-A3B-Thinking-2506是新一代多模态AI模型,在多个关键领域实现突破性提升:1) 智能思考能力增强,多模态推理准确率显著提高20.1分(MathVision)至8.4分(MathVista),同时思考效率提升20%;2) 视觉理解能力达到84.4分(MMBench-EN),支持320万像素高分辨率处理(V∗ Benchmark 83.2分);3) 视频理解能力突破,Vi

NVIDIA推出的Cosmos-Reason1-7B是一款多模态物理AI模型,整合了视觉Transformer和语言Transformer架构,支持文本、图像和视频输入。该模型专注于物理常识理解和具身推理,在机器人技术和自动驾驶领域表现优异,在基准测试中平均准确率达65.1%。采用NVIDIA开放许可证允许商业用途,建议在GPU加速环境下使用以获得最佳性能。模型基于Qwen2.5-VL-7B架构进