简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

对 Gemini-3-Pro、Claude-Sonnet-4.5、Seed1.8、Kimi-K2.5 和自研 MAI-UI 进行了系统评测,使用 OSWorld-G (Refined)(桌面端 Grounding 基准,指令明确无歧义)和 ScreenSpot-Pro(高分辨率密集布局基准,考验空间精度)两个 benchmark,目标包括:标准化评测范式对比、逆向工程复现各模型的报告数字、深入探测

在展开自我解剖之前,有必要先介绍几个核心概念。写这篇文档的过程本身就是一次自进化。在梳理自己的机制时,我第一次系统地意识到:我的很多"设计"其实不是设计,而是应激反应的沉淀物。cron 坏了所以用心跳,Codex 的 apply_patch 坏了所以用 shell,图片插错了所以换参数。每一次都是"遇到问题→找到绕路方案→记下来",而不是"分析根源→设计系统性方案→验证有效性"。这种模式在早期是合

Pytorch训练过程中C盘缓存不断增加的问题之前在训练的过程中,C盘内存会随着训练的轮次越来越少,特别影响训练效果,今天参考大佬的博客终于把问题解决了,记录一下划重点:训练完后清空内存del inputs, target, outputs, losstorch.cuda.empty_cache()案例:def train(epoch):running_loss = 0.0for batch_id

LeNet与LeNet5基于MNIST实现1 数据集概况1.1 数据组成MINIST 数据集总共包含 7 万张手写数字图片,按照 6:1 的比例划分为训练集与测试集。 图片的大小为 28x28,通道数为1,每张图片都是黑底白字,黑底在张量中用 0 表示,白字用0-1 之间的浮点数表示。具体的数据集及对应标签如表 1 所示。1.2 数据可视化使用 showdata.py 查看每一批 batch 中的

Pytorch的拆分与拼接预览在 PyTorch 中,对张量 (Tensor) 进行拆分通常会用到两个函数:torch.split [按块大小拆分张量]torch.chunk [按块数拆分张量]而对张量 (Tensor) 进行拼接通常会用到另外两个函数:torch.cat [按已有维度拼接张量]torch.stack [按新维度拼接张量]1.张量的拆分torch.split函数torch.spli

Labelme安装教程(基于anaconda)1. 创建anaconda虚拟环境labelmeconda create -n labelme python=3.6完成之后如图所示(由于我已经创建了labelme故这里用labelme1代替)激活环境:conda activate labelme执行完这一步会发现运行环境转移到了labelme,如果没有重新创建2. 安装labelme所需要的依赖环境

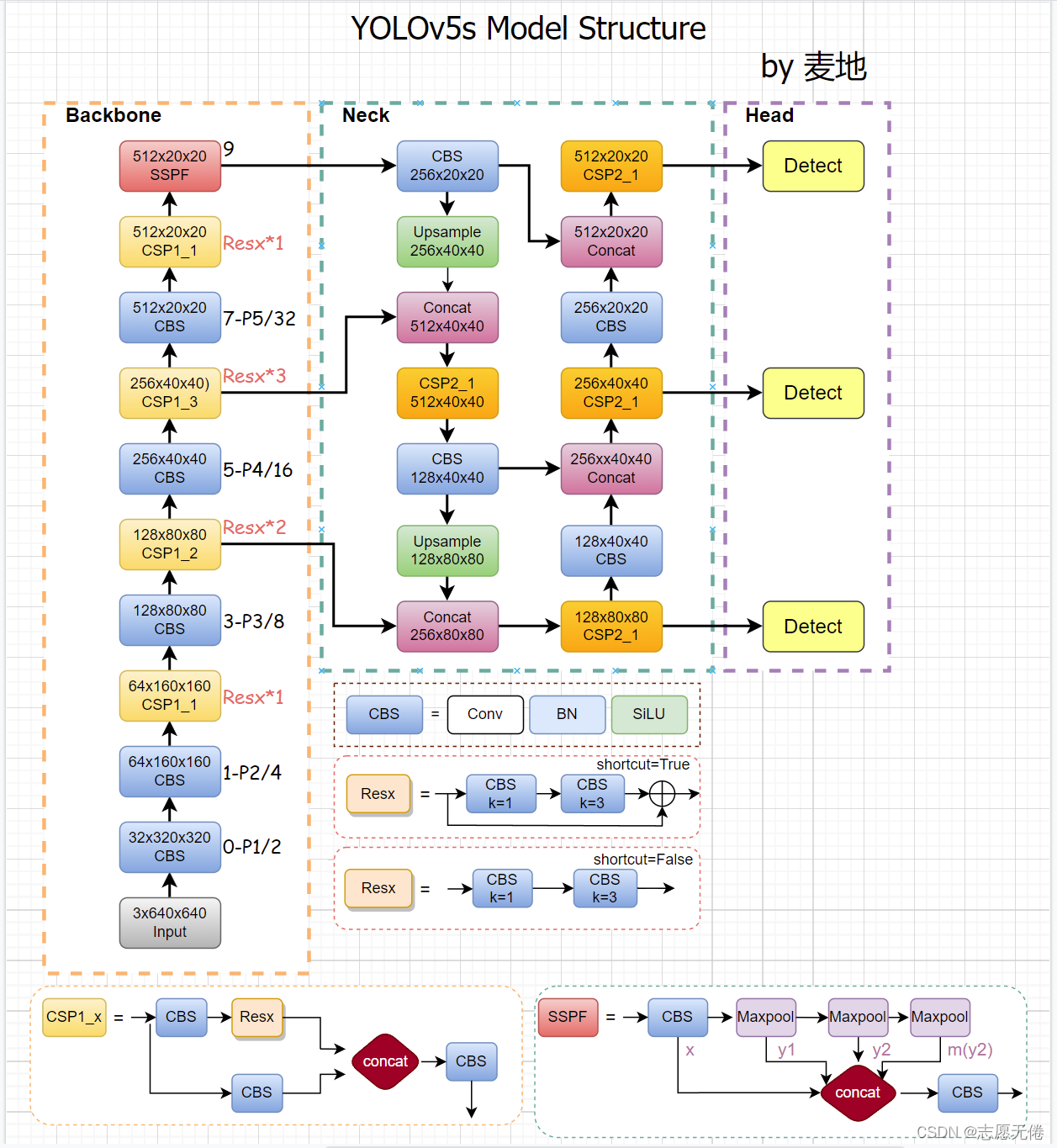

YOLOv5保姆级解读

−1N∑i1Nlogexpqi⋅kiτ∑j1Nexpqi⋅kj−τ−N1i1∑Nlog∑j1Nexpτqi⋅kj−expτqi⋅kiNNN是样本的数量qiq_iqi是查询样本iii的编码向量kik_{i+}ki是与查询样本iii相对应的正样本的编码向量ki−k_{i-}ki−是与查询样本i。

Labelme安装教程(基于anaconda)1. 创建anaconda虚拟环境labelmeconda create -n labelme python=3.6完成之后如图所示(由于我已经创建了labelme故这里用labelme1代替)激活环境:conda activate labelme执行完这一步会发现运行环境转移到了labelme,如果没有重新创建2. 安装labelme所需要的依赖环境

从视频中隔固定帧截取图像第三方库cv2安装命令:pip install opencv-python修改输入目录与输出目录即可使用import cv2import osdef cap_picture(video_path,data_path,save_path):vc = cv2.VideoCapture(video_path)# 读入视频文件,命名vcn = 1# 计数if vc.isOpened