简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

解决Ubunntu 20.04 登录百度网盘问题:-130_1__ERR_PROXY_CONNECTION_FAILED

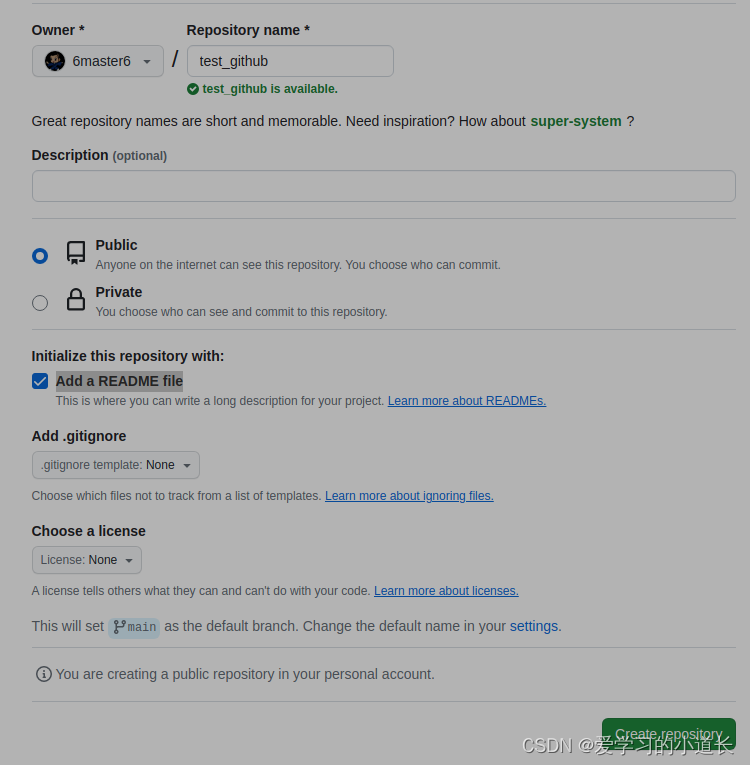

ubuntu 20.04git 上传本地文件给 github,并解决出现的问题

c++ CMakeLists.txt编写宏定义

NVIDIA AGX Orin 解决掉fatal: unable to access 'https://xxx: Failed to connect to github.com port 443: Connection timed out

本文介绍了在腾讯云轻量应用服务器上部署OpenClaw的完整流程。主要内容包括:1) 购买并配置2核4G的Linux云服务器;2) 通过nvm安装Node.js 24并配置npm镜像源;3) 使用pnpm全局安装OpenClaw最新版;4) 运行onboard向导配置MiniMax模型授权。整个过程详细展示了从服务器选购到OpenClaw安装配置的关键步骤,并提供了常见问题的解决方案。

参考:C++ 调用Python脚本C/C++调用python(新手必看)c调用python遇到的那些坑解决PyRun_SimpleFile/PyRun_SimpleString报错“探坑”——在C++中执行python脚本的艰辛尝试背景介绍:做 deepsort 跟踪部署 c++ 调用 python 时出现好多错误,记录下来,方便后续排查。用 IDE 的是clion,总所周知它生成的可执行文件在

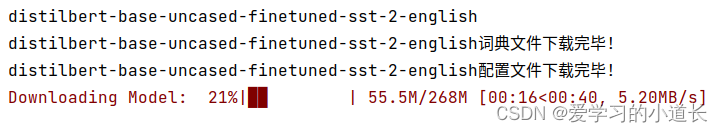

python 通过代理服务器 连接 huggingface下载模型,并运行 pipeline

本文介绍了一个基于MediaPipe的面部表情捕捉系统,能够实时检测和分析人脸关键点。系统可以跟踪眼睛状态(开/闭)、绘制面部轮廓(绿色)、嘴唇(粉色)和虹膜(蓝色)特征,并在额头显示标识。通过EyeStateTracker类实现眼睛状态平滑处理,避免检测抖动,同时提供背景虚化功能。该系统可作为2D卡通角色生成的基础模块,从文本描述创建生动的面部动画。

解决 pip ERROR: Could not install packages due to an OSError: Missing dependencies for SOCKS support.

OpenClaw图片读取问题分析与解决 摘要: 本文记录了OpenClaw工具无法读取图片的问题排查过程。问题表现为沙盒配置无法访问外部图片目录,错误提示路径不在允许范围内。分析发现OpenClaw的安全架构将媒体目录(~/.openclaw/media/inbound/)和工作区(~/.openclaw/workspace/)隔离,导致图片访问受限。解决方案是通过修改配置将外部目录映射到容器内部