简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

摘要: PromptOps 提出将提示词(Prompt)纳入软件开发生命周期(SDLC),解决生产环境中提示词管理的三大痛点:迭代混乱、部署风险和合规隐患。通过 Python 实现,利用其 LLM 生态、数据分析能力和类型安全特性,构建可协作、可审查、可回滚和可监控的提示词工程体系。核心实践包括语义版本管理、真实 LLM 测试(集成 OpenAI/Anthropic SDK)和 DSPy 风格的数

摘要:PromptOps——生产环境提示词工程管理实践 本文针对生产环境中提示词管理混乱的问题,提出PromptOps(提示词工程运营体系)解决方案。通过将提示词纳入软件开发生命周期,实现五大关键实践:1)Git式版本管理;2)自动化测试集成;3)灰度部署控制;4)团队协作评审机制;5)实时监控反馈。文章介绍了开源工具promptops-zhuyt,支持语义版本控制、测试套件和本地YAML存储,帮

这篇文章介绍了一个名为agent-guardrails-zhuyt的开源解决方案,它能显著提升本地小模型(如Ministral-8B)在Agent任务中的准确率。作者发现直接使用本地小模型时工具调用失败率高达47%,而通过四层护栏技术(JSON修复、智能重试、步骤强制和显存管理)将准确率从53%提升到99%。该方案特别适合需要在本地运行AI Agent同时兼顾成本和准确率的场景,相比直接使用GPT

MCP Gateway Lite:轻量级开源网关解决企业AI Agent部署痛点 随着MCP协议成为AI Agent连接标准(2026年500+公共服务器),企业面临三大核心挑战:1)认证授权复杂需重复开发;2)监控运维工具昂贵;3)审计合规功能缺失。MCP Gateway Lite提供开源解决方案,具备以下优势: 核心价值: 轻量架构(<10MB内存)与快速部署(pip安装) 完整企业功能:JW

MCP Gateway Lite:轻量级开源网关解决企业AI Agent部署痛点 随着MCP协议成为AI Agent连接标准(2026年500+公共服务器),企业面临三大核心挑战:1)认证授权复杂需重复开发;2)监控运维工具昂贵;3)审计合规功能缺失。MCP Gateway Lite提供开源解决方案,具备以下优势: 核心价值: 轻量架构(<10MB内存)与快速部署(pip安装) 完整企业功能:JW

TaskClaw是一个轻量级AI任务自动化框架,通过YAML配置文件实现工作流自动化,无需编写代码。核心特点包括:1)使用YAML配置降低使用门槛;2)内置多种实用工具(LLM调用、文件操作、HTTP请求等);3)开源免费且易于扩展。典型应用场景包括GitHub趋势监控、会议纪要生成和竞品价格追踪等,可显著提升工作效率。项目采用模块化设计,包含工作流解析器、执行器和工具注册表三个核心组件,支持快速

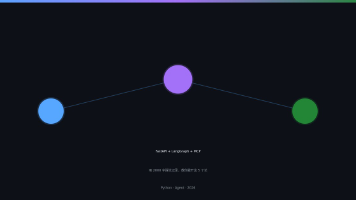

本文对比了MCP协议在Java和Python生态中的实现差异。实验环境采用Java 21+Spring Boot 3.4和Python 3.12+mcp 1.6.0,从基础实现、性能表现和项目集成三个维度进行测试。结果显示:Python版本仅需18行代码即可实现时间服务,而Java版本需要62行但类型更安全;性能测试中,Java的平均延迟为2.1ms(P99 3.5ms),优于Python的3.8

摘要 本文记录了作者整合 FastAPI、LangGraph 和 MCP 构建 AI Agent 过程中遇到的四个主要技术问题及解决方案: MCP Server 与 LangGraph 的事件循环冲突:因异步上下文管理机制冲突导致"Event loop is closed"错误,通过全局复用 MCP Client 解决。 全局变量在 FastAPI 多进程环境失效:发现 Fas

说实话,第一次听说 Cloudflare Agents SDK 的时候,我脑子里全是问号:这玩意儿和 LangChain 有啥区别?Durable Objects 又是啥?边缘部署 AI 真的能省 latency 吗?抱着试试的心态,我花了一晚上折腾了这个 Demo。结果挺意外的 —— 部署确实快,但坑也不少。这篇文章就是想记录一下真实的上手过程,不是 polished 的教程,而是带着 bug

分享自己在探索MCP协议过程中的三个关键踩坑经历:1)误以为进程启动就能立即通信,实际上需要等待服务端就绪;2)错误套用Function Calling参数格式,发现MCP使用不同的inputSchema结构;3)忽略JSON消息必须显式分隔的要求。文章揭示了MCP与Function Calling的本质差异,指出思维定势比技术本身更易造成障碍。作者最终实现了一个包含5个工具的实验项目,并探讨了M