简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

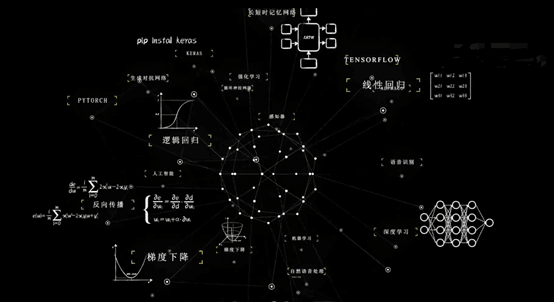

本节课介绍了神经网络该如何去识别和处理有关文字的时间依赖问题,编程实验为用神经网络对文本分进行类。下节课会用卷积操作把一个神经网络改造成为适合图像数据的卷积神经网络一样,我们把神经网络改造成为适合序列数据的结构。

随着输入数据的特征越来越多,如果一个个的去编写函数表达式未免有点麻烦和拖沓,所以我们需要一个数学工具让这件事情变得简单,矩阵和向量。本节课还介绍了Keras,Keras 的开发重点是支持快速的实验。能够以最小的时延把你的想法转换为实验结果,是做好研究的关键。

本节课是对人工智能原理课的复习,以及对后续机器学习的学习思路建议。

本节课介绍了循环神经网络RNN和长短时记忆网络-LSTM,让我们的神经网络具有处理这种关联的能力。在实验编程中,我们将用全连接层的神经网络代码和用LSTM网络代码进行了比较,我们发现用LSTM网络代码会比用全连接层的神经网络代码准确率高,如果用第三方预处理的库,LSTM准确率会更高。

坚持如无必要,不增新知的理念,围绕具体的问题,一步步给大家揭开机器学习神经网络的神秘面纱。

随着输入数据的特征越来越多,如果一个个的去编写函数表达式未免有点麻烦和拖沓,所以我们需要一个数学工具让这件事情变得简单,矩阵和向量。本节课还介绍了Keras,Keras 的开发重点是支持快速的实验。能够以最小的时延把你的想法转换为实验结果,是做好研究的关键。

本节课介绍了循环神经网络RNN和长短时记忆网络-LSTM,让我们的神经网络具有处理这种关联的能力。在实验编程中,我们将用全连接层的神经网络代码和用LSTM网络代码进行了比较,我们发现用LSTM网络代码会比用全连接层的神经网络代码准确率高,如果用第三方预处理的库,LSTM准确率会更高。