简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文使用CPU来做运算,未使用GPU。

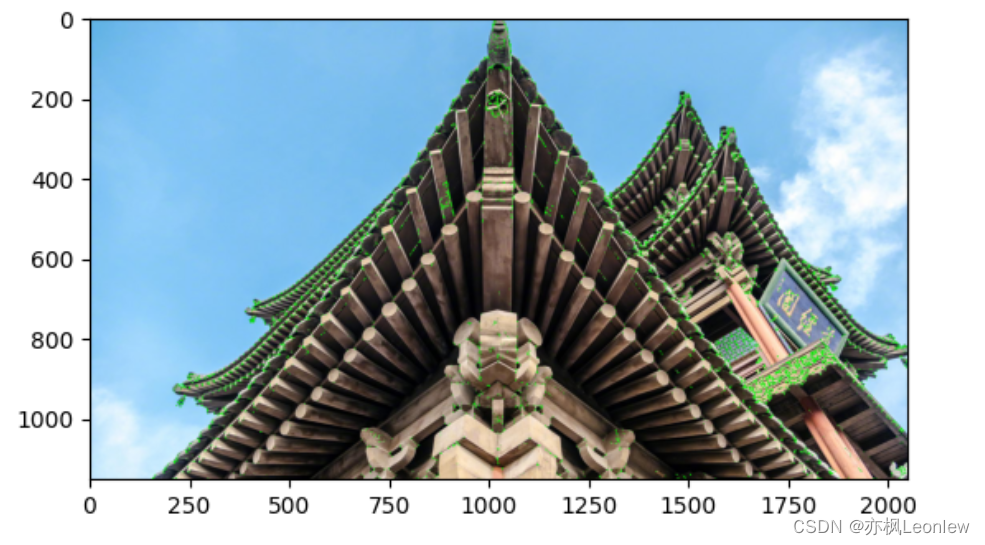

【代码】Python Opencv实践 - Harris角点检测。

面向用户的颜色模型HSV,有如下几个属性Hue(色度、色调、色相):描述具体颜色,比如红、蓝、黄、绿等,可以理解为color的专业说法。Saturation(饱和度):表示颜色接近光谱色的程度。饱和度高低会影响色彩的明艳程度。直白点理解,假设你有一种红色颜料和水,水加的越多,红色会越淡(饱和度低);水加的少,红色就会浓(饱和度高)。Value(明度):颜色的明亮程度。

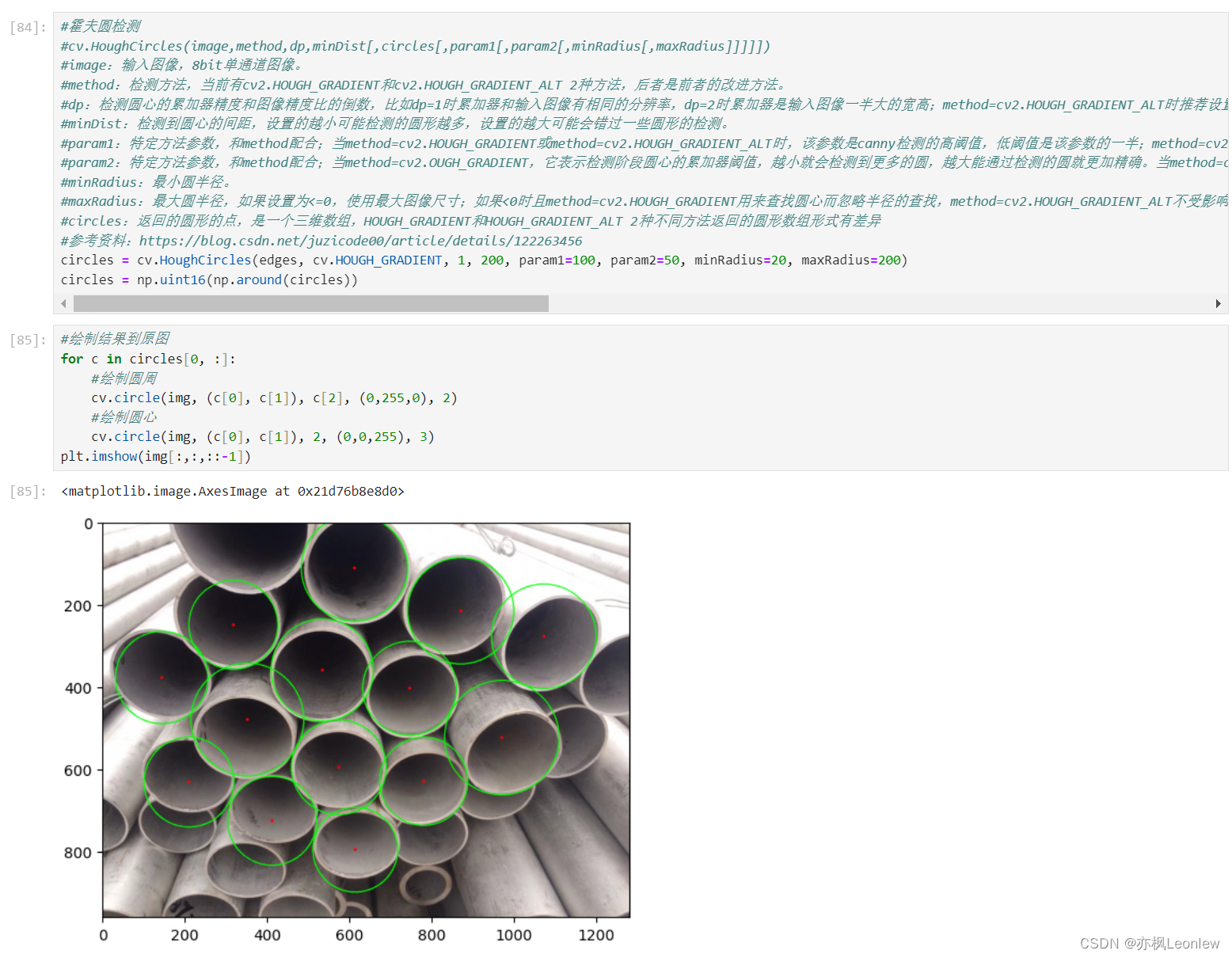

【代码】Python Opencv实践 - 霍夫圆检测(Hough Circles)

这个简单的AR项目效果是,通过给定一张静态图片作为要视频中要替换的目标物品,当在视频中检测到图片中的物体时,通过单应矩阵做投影,将视频中的物体替换成一段视频播放。这个项目的所有素材来自自己的手机拍的视频。关于opencv里的透视投影,单应矩阵等概念,请自行百度。当我在原视频中检测到这本书时,会将书替换成另一个视频里的内容。

本个专栏的前面的CMOS基础知识里,有提到过CMOS像素的结构和工作原理。Camera和Image sensor技术基础笔记(1) -- 光和CCD/CMOS sensor基础知识_亦枫Leonlew的博客-CSDN博客_cmos相机光首先来看看可见光在电磁波谱里的位置,光在电磁波谱里的范围是非常窄的一般人的眼睛能感知的电磁波的频率在380~750THz,波长在780~400nm之间,但有些人能够

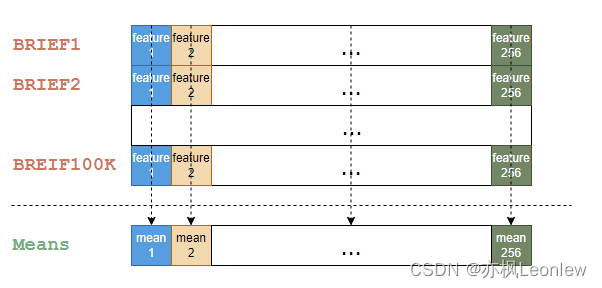

前面的Oriented FAST说明的是它的关键点的选取是一种改良过的FAST,在FAST的基础上加了方向信息;后面的Rotated BRIEF是指特征描述符使用BRIEF描述子(Binary Robust Independent Elementary Feature),是一种速度极快的二进制描述子。

使用传统的计算机视觉方法定位图像中的车牌,参考了部分网上的文章,实际定位效果对于我目前使用的网上的图片来说还可以。纯练手项目,仅供参考。后续可以尝试做一个如果imagePreProcess2识别无效后使用imagePreProcess再处理,或者加上阈值自适应打分的机制优化。目前对于我做的练手项目来说足够了。注意:以下代码是参考了网上的一些文章后,按照自己的思路写的,定位效果尚可。不太成功的例子(

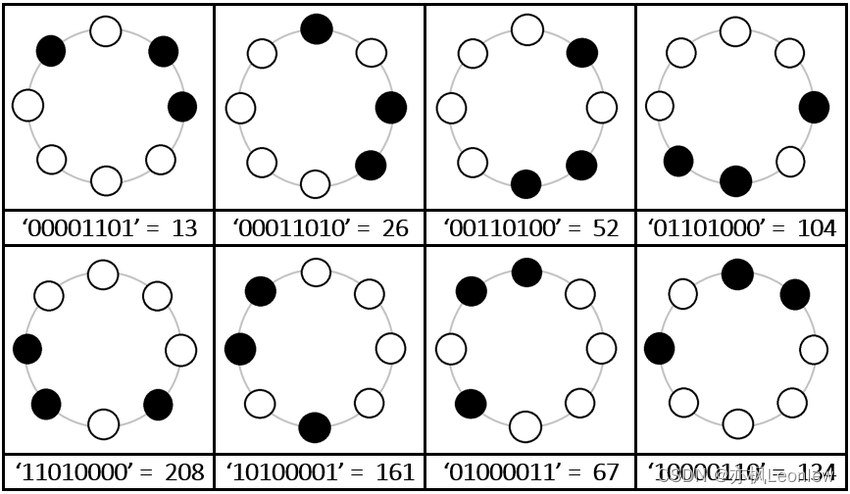

LBP,局部二值模式(Local Binary Pattern),是一种描述图像局部纹理特征的方式,具有旋转不变性和灰度不变性。首先由T. Ojala, M.Pietikäinen, 和 D. Harwood 在1994年提出。

纯练手项目,只简单做了左键点击功能,也没有做左右手的判断。hand0和hand1的顺序会受到哪只手先被检测出来影响,可以再优化。使用mediapipe的手势识别模块,封装一个HandDetector,然后基于这个类做一个手势虚拟鼠标。手势用法:一只手(hand0)的食指做鼠标移动,另一只手(hand1)的食指做点击操作。鼠标的操作使用了pynput,直接用pip install pynput安装即