简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

django之sqlite3常见错误

vgg和googlenet是2014年imagenet竞赛的双雄,这两类模型结构有一个共同特点是go deeper。跟googlenet不同的是,vgg继承了lenet以及alexnet的一些框架,尤其是跟alexnet框架非常像,vgg也是5个group的卷积、2层fc图像特征、一层fc分类特征,可以看做和alexnet一样总共8个part。根据前5个卷积group,每个group中的不同配置,

inception v2与inception v3两种模型配置。Inception v3单模型达到了21.2%的top1错误率,多模型达到了17.3%的top1错误率

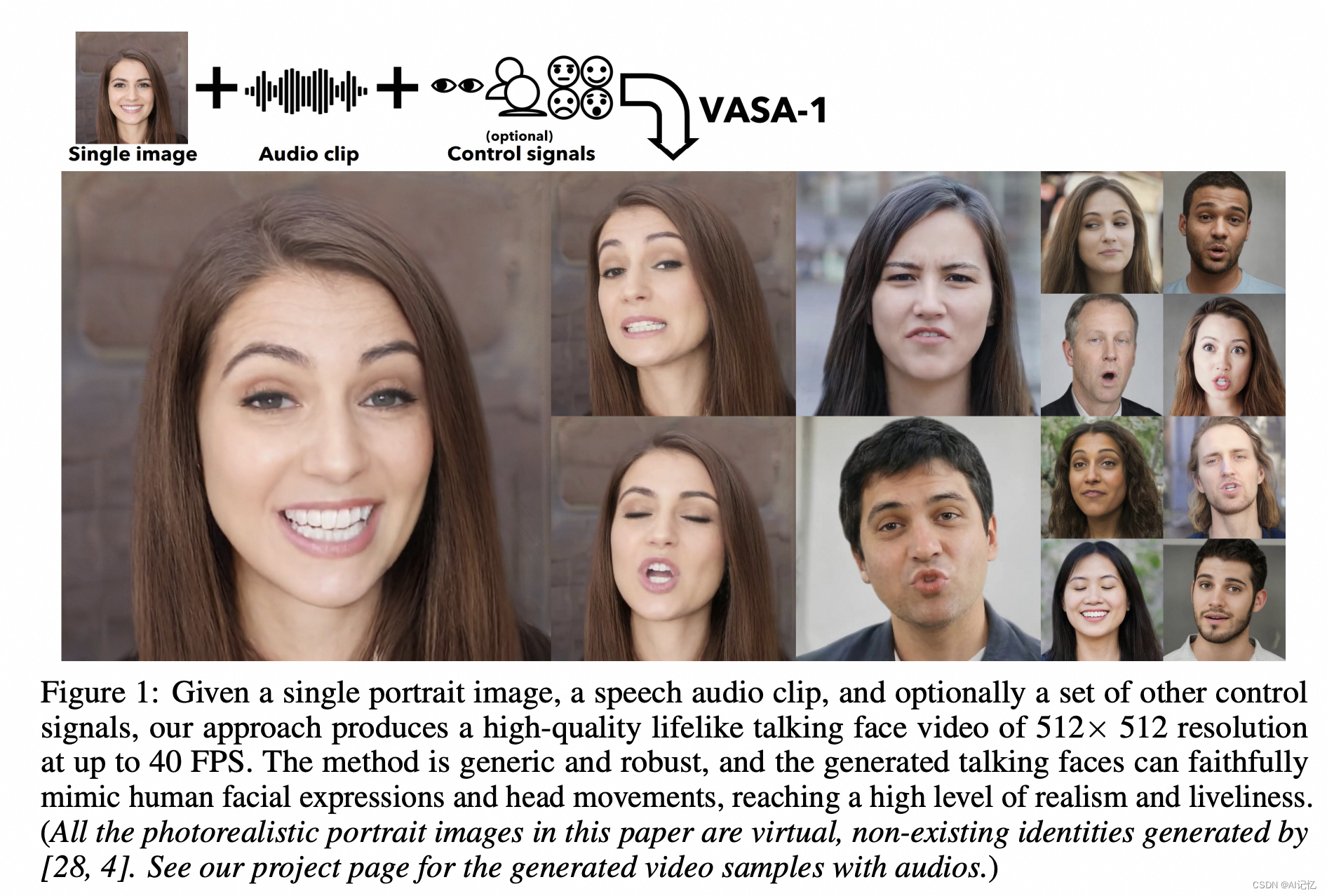

本文介绍了 VASA-1,这是一个由 Microsoft Research Asia 开发的框架,用于生成逼真的、音频驱动的说话(面部)视频。VASA-1 能够根据单一静态图像和语音音频片段生成具有视觉情感技能(Visual Affective Skills, VAS)的说话视频。该模型不仅能够产生与音频精确同步的唇部运动,还能捕捉到广泛的面部微妙表情和自然头部运动,从而增强真实感和生动感。从方法

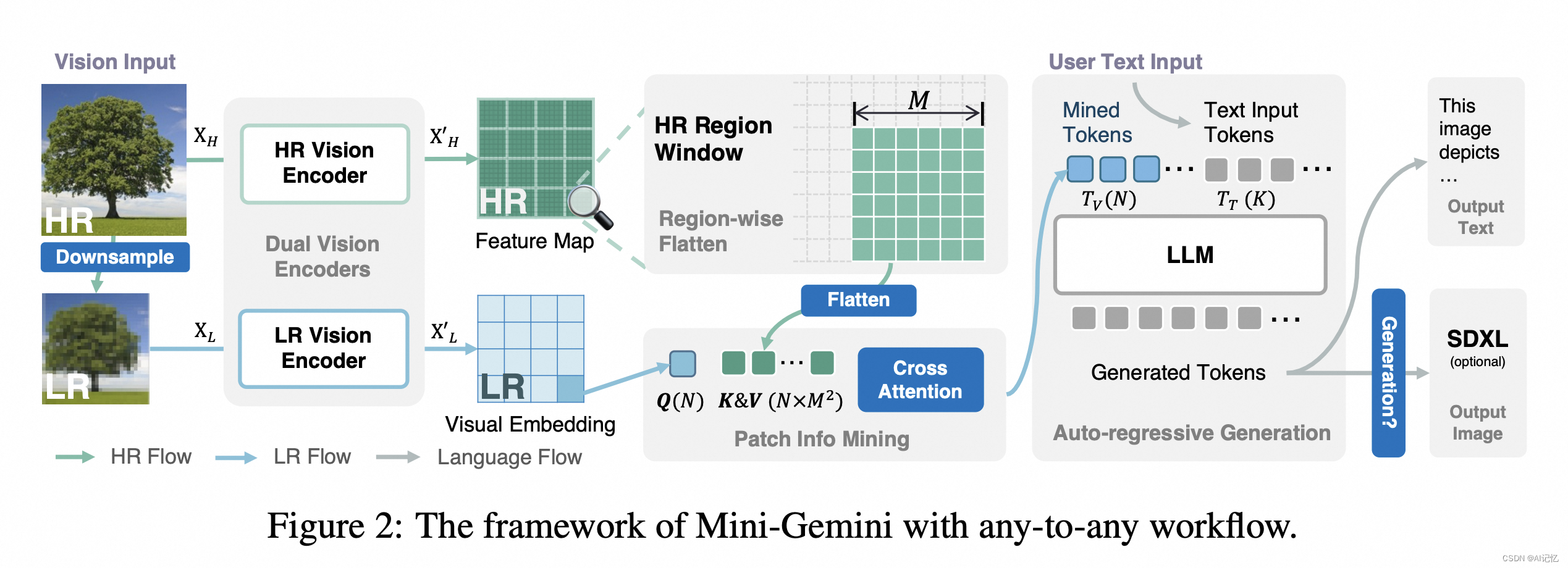

最近,一篇名为“Mini-Gemini: Mining the Potential of Multi-modality Vision Language Models”的文章在arXiv上发表,为我们展示了一个简单而有效的框架,旨在提升多模态视觉语言模型(VLMs)的性能。它即能直接提升图像感知能力,也能作为多模态环境下图像生成任务的前置prompt生成器。主要探索了如何增强图像全局感受野,以及探索

随着图像生成领域的研究飞速发展,基于diffusion的生成式模型取得效果上的大突破。在图像生成/编辑产品大爆发的今天,视频生成/编辑技术也引起了学术界和产业界的高度关注。该分享主要介绍视频生成/编辑的研究现状,包括不同技术路线的优劣势,以及该领域当下面临的核心问题与挑战。

为了进一步拓展写真风格的多样性和使用便捷性,在最新版本的FaceChain中,开源了人像写真风格LoRA模型的自定义训练和共享功能,通过将模型上传至风格广场的形式,使得海量写真风格实现共享社区一键式调用,走向风格化人像写真新纪元。

vgg和googlenet是2014年imagenet竞赛的双雄,这两类模型结构有一个共同特点是go deeper。跟googlenet不同的是,vgg继承了lenet以及alexnet的一些框架,尤其是跟alexnet框架非常像,vgg也是5个group的卷积、2层fc图像特征、一层fc分类特征,可以看做和alexnet一样总共8个part。根据前5个卷积group,每个group中的不同配置,

AIGC元年达到了学术-商业共振,本文介绍现有AI绘画、AI作画背后的相应基本原理、应用、以及论文参考文献。

在数字艺术与AI的交汇处,Stable Diffusion 3(SD3)Medium版本的开源标志着技术革新的新篇章。继3月份我在CSDN上发表的SD3技术博文后,这一新里程碑的实现,展示了AI在图像生成领域的显著进步。通过Hugging Face平台的开源,SD3 Medium不仅为艺术创作提供了新土壤,也推动了文生图社区的发展。尽管存在挑战,社区的协作和技术创新将不断解锁创造潜力,引领我们进入