简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

(本文使用 AI 辅助创作)注: 下面的内容被其所描述的方式处理过了: (狗头)

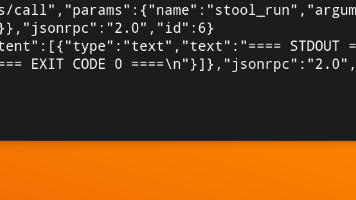

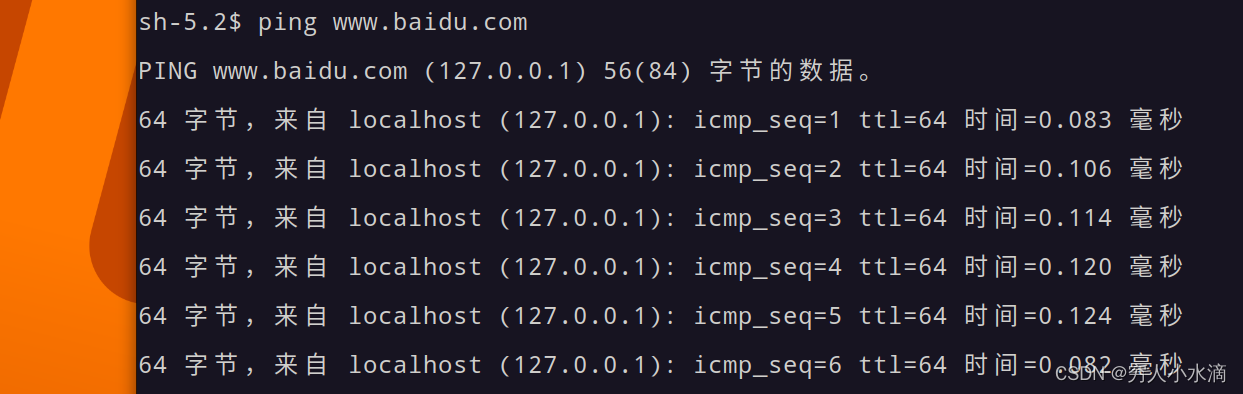

本文实现了一个很简陋的 AI agent, 可以调用 deepseek API 和上一篇文章中的 MCP 工具 (mcp-run) 来执行任务. agent 的工作原理并不复杂, 主要是一个调用大模型 API 以及 MCP 工具的循环.目前的 AI 本质上不可靠, 所以在虚拟机中运行 AI 可以获得较高的安全程度 (当然也不是绝对安全).让 AI 自举, 也就是用 AI 编写给 AI 调用的 MC

本文实现了一个很简陋的 AI agent, 可以调用 deepseek API 和上一篇文章中的 MCP 工具 (mcp-run) 来执行任务. agent 的工作原理并不复杂, 主要是一个调用大模型 API 以及 MCP 工具的循环.目前的 AI 本质上不可靠, 所以在虚拟机中运行 AI 可以获得较高的安全程度 (当然也不是绝对安全).让 AI 自举, 也就是用 AI 编写给 AI 调用的 MC

MCP 工具调用就是这么简单.以前的 AI 聊天, 就像 AI 只有嘴, 只能做 嘴强王者. 现在的 agent, 相当于给 AI 装上了手脚, 让 AI 可以调用工具, 执行操作, 所以能力边界一下就扩展了.展望未来, 当 AI +机器人成熟之后, AI 就可以从屏幕中走出来了 (狗头).本文中实现的 MCP 工具非常简陋, 只是一个粗糙的原型.如果要用于实际用途, 还需要大量的完善优化. 主要

本文主要内容: 在香橙派 zero3 (1GB) 上安装 adguardhome 的过程.adguardhome 作为一个 DNS 服务器, 安装简单, 配置方便, 界面美观 (web), 可以加速上网.adguardhome 虽然不需要太多计算存储资源, 但还是需要那么一点的. 常见的 OpenWrt 路由器的存储空间往往太小 (比如 256MB RAM,28MB flash), 运行 adgu

本文验证了在容器中运行 QEMU/KVM 虚拟机是可行的, 可以正常使用 Linux 内核的 KVM 硬件加速. podman 可以普通用户运行, 无需 root 权限, 所以普通用户也可以运行 QEMU/KVM 虚拟机.

由于本文太长, 分开发布, 方便阅读.

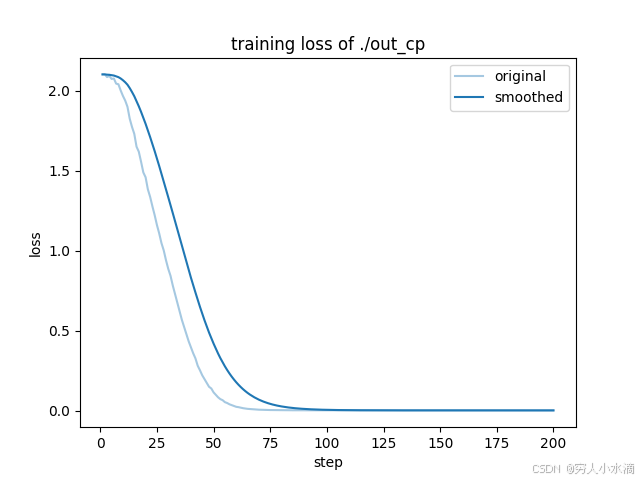

使用 llama-factory 工具可以对 AI 语言模型 (LLM) 进行微调 (LoRA SFT), 只需准备数据集即可.可以看到, AI 具有一定的泛化能力, 也就是训练数据集中没有的问题, 模型也可以给出比较合理的回答.此处使用的丹炉不好, 炼不了上品仙丹, 只能用个小模型意思意思. 但原理和操作步骤都是一样的, 只要换上更好的硬件, 准备更多数据, 就能炼制更好更大的仙丹啦 ~AI 并

通过自制 fish-speech 容器镜像, 并添加参考音频数据, 窝们成功获得了一只封装好的派蒙罐头 (真·应急食品). 随便放在哪里都可以直接运行, 无需网络, 很是方便好用.CPU 推理确实很慢, 后续计划寻找无需 N 卡条件下, 更快运行大模型的方法.本文使用 CC-BY-SA 4.0 许可发布.

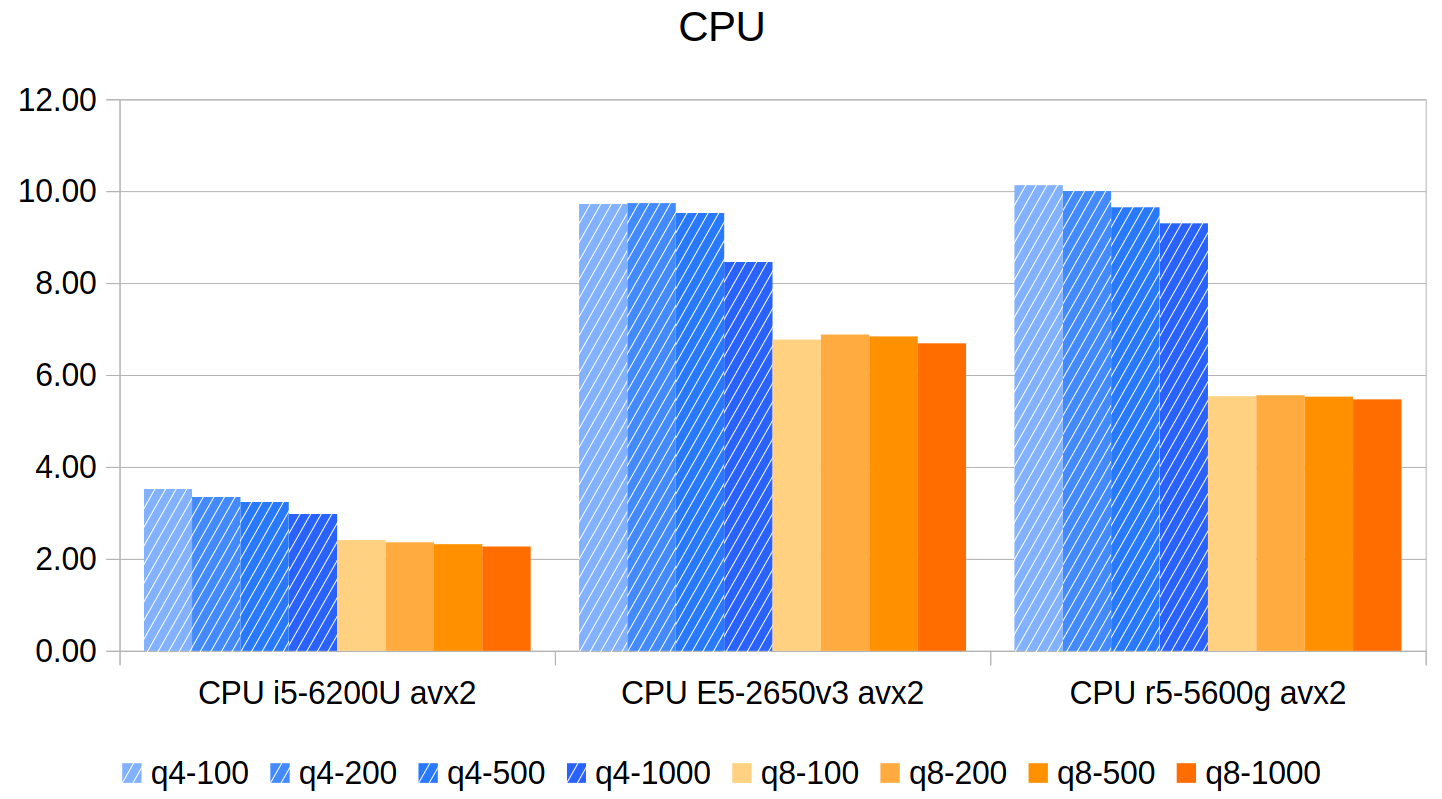

通过llama.cpp运行 7B.q4 (4bit 量化), 7B.q8 (8bit 量化) 模型, 测量了生成式 AI 语言模型在多种硬件上的运行 (推理) 速度.根据上述测量结果, 可以得到以下初步结论:(1)显存 (内存) 大就是正义!大, 就是正义!!限制能够运行的模型规模的最主要因素, 就是显存的大小.目前的大部分显卡 (除了高端的比如 4090), 显存都不超过 16GB.