简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

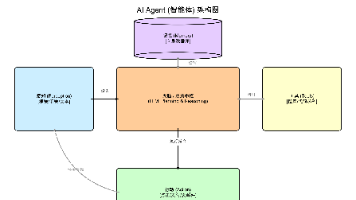

DeepAgents 是一个开箱即用的智能代理框架,提供预设的中间件、工具和上下文管理功能。通过 create_deep_agent 方法可快速创建代理,支持模型配置、系统提示词定制、子代理调用、技能加载等功能。框架内置了待办事项、文件操作、长文本摘要等中间件,并提供状态持久化、人工干预机制和调试模式。底层基于 LangChain 的 create_agent 实现,简化了智能代理的开发流程,适用

DeepAgents 是一个开箱即用的智能代理框架,提供预设的中间件、工具和上下文管理功能。通过 create_deep_agent 方法可快速创建代理,支持模型配置、系统提示词定制、子代理调用、技能加载等功能。框架内置了待办事项、文件操作、长文本摘要等中间件,并提供状态持久化、人工干预机制和调试模式。底层基于 LangChain 的 create_agent 实现,简化了智能代理的开发流程,适用

还记得以前我们怎么用ChatGPT吗?这时候的AI,更像一个**“军师”(只动嘴不动手)**。而,就是给"军师"装上了**“手脚”(工具)"眼睛"(感知)主动行动**——帮你打开APP、点击按钮、填写表单、完成支付。

想象你正在翻译一句复杂的中文:“尽管天下着大雨,小明还是坚持骑车去图书馆还书,因为那本《深度学习入门》明天就到期了。而Transformer模型却能轻松解决这个问题——它像,一眼就能看到"大雨"和"坚持骑车"的转折关系,"那本"和"书"的指代关系。这种"全局视野"正是Transformer超越RNN的关键。

2022年,一幅由AI生成的画作《太空歌剧院》在艺术比赛中击败人类选手夺冠,震惊了世界。这幅画细节丰富、意境悠远,很难想象它出自一个没有感情的机器之手。与此同时,ChatGPT能写出流畅的诗歌,Midjourney能生成"赛博朋克风格的猫",GitHub Copilot能帮程序员自动补全代码……这些AI不再只是"识别"或"分类"数据,而是能。这就是生成式AI(Generative AI)的革命——

摘要: 循环神经网络(RNN)通过引入记忆循环机制解决了序列数据的上下文依赖问题,使AI能理解语音、翻译句子等任务。标准RNN因"梯度消失"存在短期记忆缺陷,而LSTM通过遗忘门、输入门和输出门实现了长期记忆,广泛应用于语音识别、机器翻译等领域。尽管Transformer因并行计算优势逐渐取代RNN,但RNN在实时场景仍有价值。RNN与CNN各有所长,分别擅长处理序列数据和空间

当你听到"人工智能"这个词时,脑海里浮现的是什么?是电影《终结者》里的T-800机器人,还是《钢铁侠》里能说会道的Jarvis?其实这些都是被好莱坞夸张化的AI形象。今天我们就用最接地气的方式,聊聊AI到底是个什么东西,它和我们想象的机器人有什么不同。

如果你见过洋葱,就知道它一层包着一层。深度学习(Deep Learning)就像这颗洋葱——把"神经网络"一层叠一层,从表面到核心,层层深入地提取信息。这就是为什么深度学习能处理图像、语音、语言这些复杂数据——它不是"一眼看穿",而是。

摘要: 循环神经网络(RNN)通过引入记忆循环机制解决了序列数据的上下文依赖问题,使AI能理解语音、翻译句子等任务。标准RNN因"梯度消失"存在短期记忆缺陷,而LSTM通过遗忘门、输入门和输出门实现了长期记忆,广泛应用于语音识别、机器翻译等领域。尽管Transformer因并行计算优势逐渐取代RNN,但RNN在实时场景仍有价值。RNN与CNN各有所长,分别擅长处理序列数据和空间

Softmax回归:AI的多分类概率转换器 Softmax回归是一种将原始分数转换为概率分布的方法,使AI能够清晰判断最优选项。其核心原理分为三步:1)指数化处理分数,解决负值并放大差距;2)归一化计算各选项占比;3)选择最高概率项作为结果。该方法广泛应用于图像分类、语音识别和推荐系统等领域,通过将任意范围的输入分数转换为总和为1的概率分布,克服了直接比较分数带来的问题。相比线性回归预测具体数值,