简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

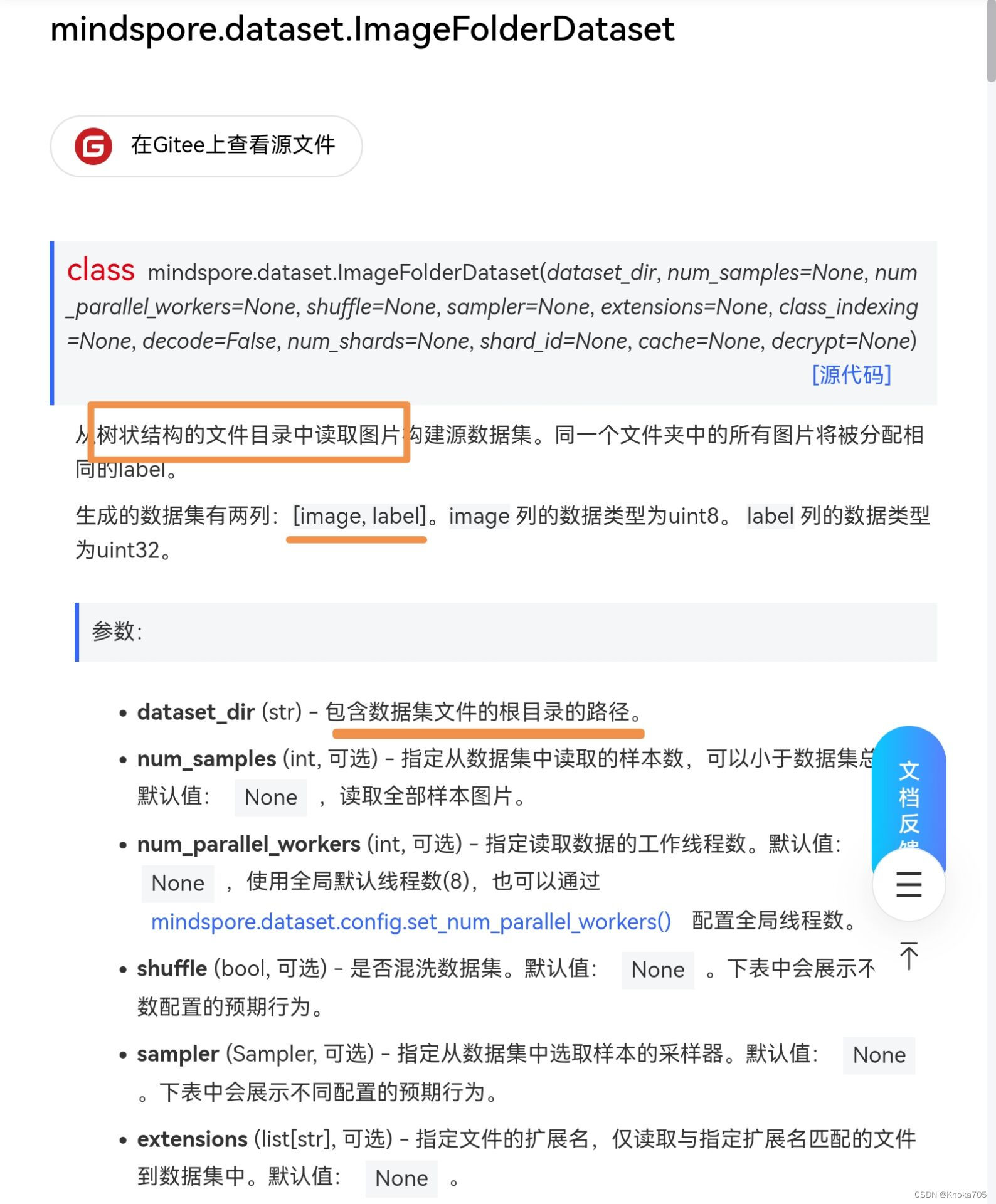

基于Mindspore,通过Resnet50迁移学习实现猫十二分类

基于Mindspore,通过Resnet50迁移学习实现猫十二分类

关于Pytorch转换为MindSpore的一点建议

整体来说,只要数据集构建没有问题,网络结构没有问题(需要计算测试)那么框架转换就很简单了,因为训练的流程都大致相同,虽然mindspore里面没有梯度清零什么的但是也有独特的自动微分梯度求导,这个多看几个案例,其实也是一套流程。

python数据分析-matplotlib、numpy、pandas

python数据分析-matplotlib、numpy、pandas笔记

为你的Ollama添加API-key,解决风险问题

为你的Ollama添加API-key,解决风险问题(bushi)

遇到CodeWithGPU,为什么我再也不手动配置环境了?

AutoDL社区镜像快速上手指南 AutoDL的社区镜像功能解决了AI开发者常遇到的环境配置难题,如CUDA报错、版本冲突等。通过CodeWithGPU平台,用户可直接搜索关键词(如“gpt-sovits”)获取现成镜像,无需繁琐配置。社区由开发者共同维护,提供丰富的前沿镜像,点击“创建实例”即可快速体验,并附有详细文档支持。选择适合的GPU型号后,即可开箱使用,大幅提升效率。 #AutoDL #

为你的Ollama添加API-key,解决风险问题

为你的Ollama添加API-key,解决风险问题(bushi)

ResNet网络结构,BN以及迁移学习详解

ResNet网络结构,BN以及迁移学习详解

Python3.8+PyCharm安装和简单配置

Python3.8+PyCharm安装和简单配置

为你的Ollama添加API-key,解决风险问题

为你的Ollama添加API-key,解决风险问题(bushi)

快来测试一下你的 GPU 性能吧!

近期老板发个任务,想要测试一下半精度下的GPU稀疏算力,探索了多个软件和脚本,包括DeepBench、GPU-Burn、Pytorch基准测试等,发现均不太好用;

到底了