简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

计算机视觉(CV)作为人工智能的重要分支,自20世纪50年代起经历了多个发展阶段。从早期的模式识别和三维场景理解,到70年代David Marr的视觉计算理论框架,再到2000年代深度学习的兴起,CV技术不断突破。2012年AlexNet在ImageNet竞赛中的成功标志着深度学习在CV中的主流化。如今,CV在工业、医疗、自动驾驶、零售和安防等多个领域广泛应用,市场规模持续扩大。尽管面临复杂场景适

《VLM-RL: A Unified Vision Language Models and Reinforcement Learning Framework for Safe Autonomous Driving》是由Wisconsin Madison分校和Purdue大学的研究团队于2024年12月发表的一篇论文。该论文提出了一种创新的框架VLM-RL,将预训练的视觉语言模型(VLM)与强化学习

深度学习在人工智能领域持续取得进展,主要研究方向包括持续学习、多目标优化、IoT与边缘计算融合、模型架构创新、生成模型与多模态学习、可解释性与通用人工智能、跨学科应用与科学智能。持续学习通过域增量学习等方法解决灾难性遗忘问题;多目标优化通过动态权重分配等技术平衡冲突目标;IoT与边缘计算结合推动智慧城市等应用;模型架构创新如Transformer和轻量化网络提升性能与效率;生成模型与多模态学习在文

12、 元素的访问: 可以[-1]选择最后一个元素,可以用[1:3]选择第二个和第三个元素。7、常见的标准算术运算符(+、-、*、/ 和 **)都可以被升级为 按元素运算。10、对张量中的所有元素进行求和sum(),会产生一个只有一个元素的张量。5、改变一个张量的形状而不改变元素数量和元素值,可以调用。6、使用全0、全1、其他常量或者从特定分布中随机采样的数字。15、 转换为numpy张量、转换为

本文系统介绍了C++开发工具链,涵盖IDE(VS、CLion、QtCreator等)、编译器(GCC、Clang、MSVC)、构建系统(CMake、Bazel)、调试测试工具(GDB、GoogleTest)和性能分析工具(Valgrind、VTune)。针对不同项目类型(跨平台应用、高性能计算、嵌入式开发)推荐了最佳工具组合,强调现代C++开发应优先采用CMake构建系统,并提供了云原生开发支持方

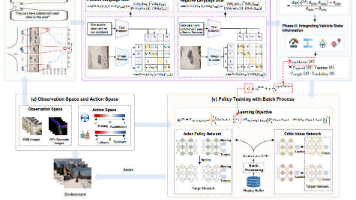

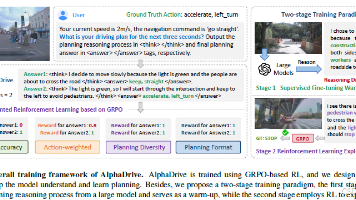

本文提出AlphaDrive框架,通过结合GRPO强化学习与规划推理技术解决当前端到端自动驾驶模型在长尾场景中的表现不足问题。该框架创新性地采用分组优化的GRPO算法和四大规划导向奖励函数,通过两阶段训练策略(知识蒸馏+RL优化)提升决策鲁棒性。实验表明,仅使用20%数据时,其2B小模型性能超越7B基线模型35.31%,且在多模态规划能力和数据效率上表现突出。研究证实通用大模型技术可有效迁移至垂直

linux安装常用工具

【代码】PyTorch常用命令(可快速上手PyTorch的核心功能,涵盖从数据预处理到模型训练的全流程)

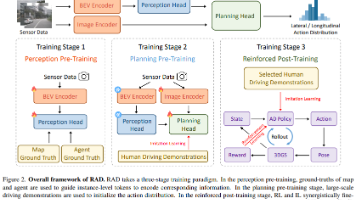

华中科大与地平线团队提出RAD框架,通过3D高斯泼溅(3DGS)构建高真实感数字孪生环境,结合强化学习(RL)与模仿学习(IL)混合训练范式,解决传统自动驾驶方法存在的因果混淆和开环差距问题。创新性地采用解耦动作空间设计(横向/纵向各61档离散动作)和四元奖励机制,在4305个高风险场景数据集上验证,碰撞率(CR)较基线降低3倍至0.089,轨迹偏离距离(ADD)达0.257米。该方法首次实现基于

深度学习在裂缝检测与分割领域取得显著进展,克服了传统方法在复杂环境中的局限性。主流技术包括改进的U-Net、Transformer架构及多尺度建模,重点关注小目标检测和数据不平衡问题。常用数据集如DeepCrack、CrackTree提供精细标注,而SDNET2018适用于分类任务。未来趋势涵盖合成数据生成、3D裂缝分析和跨域泛化研究。当前最优模型在部分测试集上已达94.2% IoU精度,成为智能