简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

行为规范Actor Critic算法(Behavior Regularized Actor Critic,BRAC) 是一种专门为离线强化学习设计的算法,其主要目标是通过行为正则化(Behavior Regularization)来解决由于数据分布偏差导致的策略退化问题。BRAC 算法是由Yifan Wuet al. 在 2019 年的论文“Behavior Regularized Offline

基于迁移学习的强化学习(Reinforcement Learning with Transfer Learning,简称 RL-TL)是将迁移学习(Transfer Learning)的概念应用于强化学习(Reinforcement Learning,简称 RL)中的一种方法。其核心思想是在强化学习的环境中,利用已有的经验或在其他任务中学到的知识来提升学习效率和表现。这样可以减少从零开始学习的时间

在多智能体强化学习(Multi-Agent Reinforcement Learning, MARL)的研究和应用中,构建合适的环境来测试和评估算法是非常重要的。以下是一些常用的多智能体强化学习环境,它们涵盖了多种任务类型,如协作、对抗、竞争等,帮助研究者验证算法的效果。SMAC(StarCraft Multi-Agent Challenge)、 MPE(Multi-Agent Particle

深度强化学习本文介绍:[Python] 深度Q网络(DQN)实现[Python] REINFORCE算法实现[Results] 运行结果随着深度学习的迅猛发展,深度强化学习(Deep Reinforcement Learning, DRL)将深度学习与强化学习相结合,使得处理高维状态空间成为可能。

半马尔可夫决策过程,Semi-Markov Decision Processes (SMDP) 是一种用于分层强化学习的模型,适用于那些包含不规则时间步或长期延迟决策的任务。相比于标准的马尔可夫决策过程(Markov Decision Process, MDP),SMDP 能够处理不同时间间隔之间的决策问题,因此在强化学习中广泛应用于分层结构,尤其是需要长时间跨度或多步策略的复杂任务中。

元强化学习是一种提升智能体适应新任务能力的技术,它让智能体不仅能学习完成当前的任务,还能在面对新的任务或环境时更快地学会新的策略。与传统的强化学习不同,元强化学习关注如何学习得更快、更高效,即学习如何学习。它让智能体在多种任务之间迁移经验,以应对任务变化或环境变化。核心思想元强化学习的核心思想是通过一个“元层”对多个任务进行学习和优化。该元层不是直接学习如何执行任务,而是学习如何在给定的任务下快速

分层强化学习(Hierarchical Reinforcement Learning,HRL)是一类旨在通过引入多层次结构来提高强化学习算法效率的方法。其核心思想是将复杂的任务分解为若干子任务,通过解决这些子任务来最终完成整体目标。

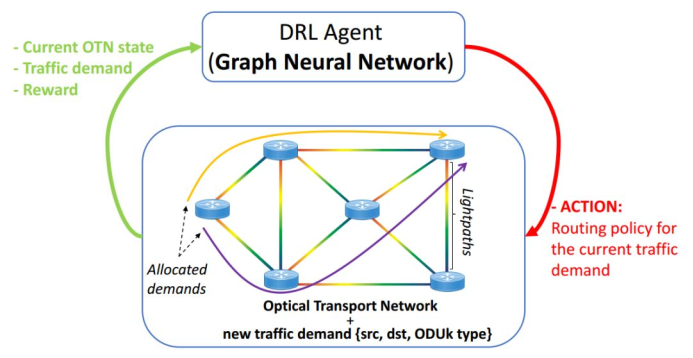

将图神经网络(GNN)与深度强化学习(DRL)相结合。新的DRL+GNN体系结构能够在任意网络拓扑图上学习、操作和生成。图神经网络(Graph Neural Networks,GNN)是一种新型的神经网络,用于对图结构信息进行操作。它们的基本形式是将一些初始状态与图中的不同元素相关联,然后结合这些元素在图中的相互关系。迭代算法更新状态元素并使用最终状态产生输出.

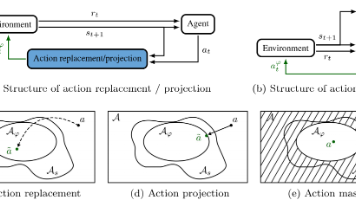

本文系统介绍了安全强化学习(SafeRL)的发展与应用,重点阐述了可证明安全强化学习(ProvablySafeRL)的三种核心技术:动作替换、动作投影和动作掩码。文章梳理了该领域从早期探索到深度安全强化学习的发展历程,并分析了各类方法的优缺点与适用场景。研究通过倒立摆、无人机悬停等实验验证了这些技术的安全性,其中动作替换表现最佳。当前挑战包括高维状态验证、Sim2Real安全差距和多智能体协同等问

本文对比分析了强化学习中三种核心价值估计方法:时序差分(TD)、蒙特卡洛(MC)和动态规划(DP)。TD方法结合即时奖励和下一状态估计进行在线更新,效率高但可能估计偏差;MC依赖完整回合回报,适合离线学习但方差大;DP需要环境模型,能精确求解但计算量大。三者各具特点:TD适用于在线/大规模任务,MC适合回合制问题,DP则适用于模型已知的小规模场景。理解这些方法的特性有助于根据实际问题选择合适的算法