简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

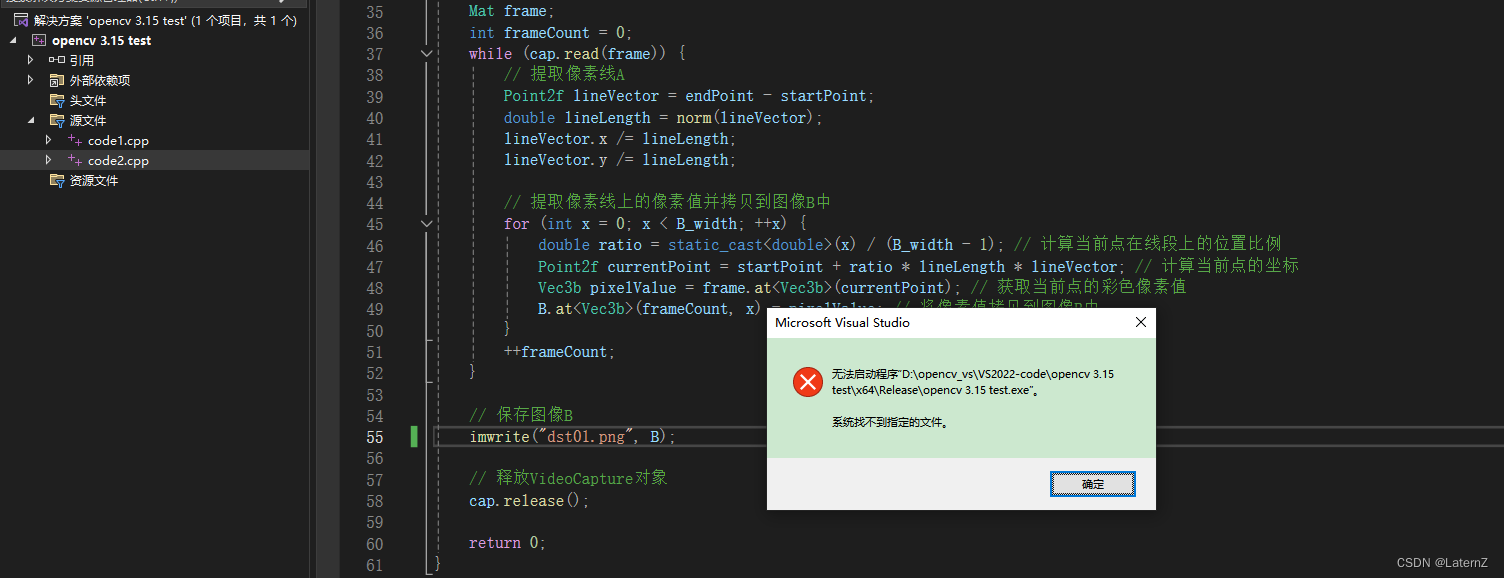

VS2022一个项目中运行多个c++程序

一般使用vs2022都需要配置好一些路径依赖,但一个项目中只能使用一个源文件,这也是为了避免找不到那些依赖,可是我们就是想为了可以快速编写,而不是浪费在那些配置环境的时间上,所以本文就介绍如何在一个项目中运行多个c++程序的快速设置方法。

本地pytorch环境下利用YOLOv5训练自己的数据(包括加速训练参数设置与tensorboard查看)

在本地环境利用YOLOv5训练自己的数据集(已完成)

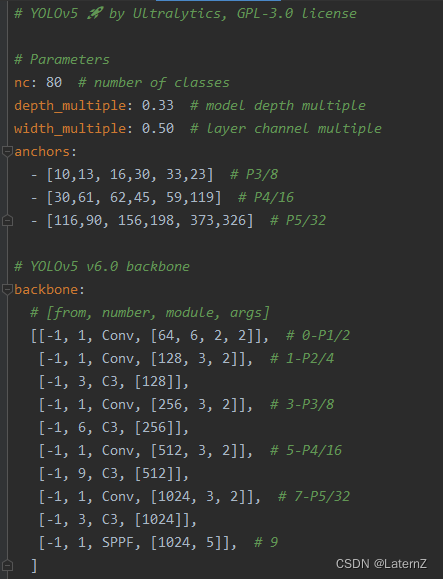

YOLOv5改进(一)改进的核心内容

本节介绍了改进YOLOv5中的较难部分:添加自己设计的模块的办法,需要设计自己的模块,并推导一些尺度和通道数,然后在yaml文件中配置模型参数,在yolo.py中配置输出通道数,如果自己推导了整个模型每层的尺寸和通道数,配置这些参数就相对容易。

到底了