简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

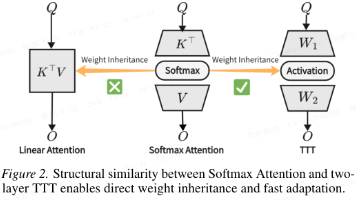

本文介绍了 ViT³ 和 T⁵ 两篇关于 ViT 测试时训练的研究成果。ViT³ 系统性地探索了视觉 TTT 的设计空间,提出了六条核心原则,基于此构建的ViT³模型在多项视觉任务中表现优异。T⁵ 则聚焦如何将预训练 Softmax Transformer 快速转化为线性TTT模型,提出结构对齐和表示对齐策略,通过权重继承和键实例归一化实现高效转换。

通过使隐藏状态成为一个机器学习模型,并将更新规则设为自监督学习的一步,本文将监督学习表述为学习如何学习,包含两个嵌套循环。外循环与常规训练相同。外循环的参数是内循环的超参数。由于隐藏状态在测试序列上也会进行训练更新,这些层被称为TTT层

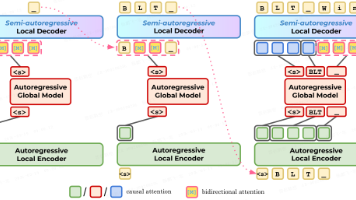

本文在原生 BLT 基础上,从训练目标和推理策略双重优化,提出三种改进变体,解决字节模型生成慢的痛点:BLT-D 引入块级扩散辅助损失,实现单步多字节并行生成,速度最快;BLT-S 基于模型自身解码器做自推测解码,速度换质量;BLT-DV 扩散生成+自回归校验,兼顾速度与生成质量;所有变体相比原生 BLT,内存带宽成本降低 50% 以上,彻底扫清字节级大模型落地障碍。

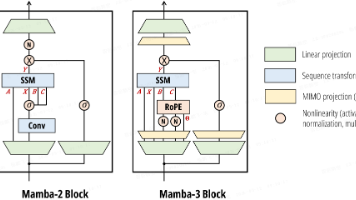

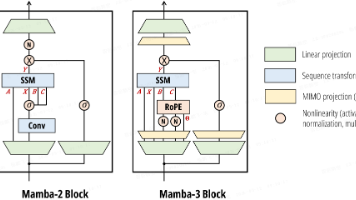

从初代粗糙的线性模型,到第三代兼顾速度、内存、精度的全能架构,Mamba-3 的问世,标志着状态空间模型正式走向成熟。在未来轻量化、低成本大模型的发展方向中,以 Mamba 为代表的线性模型必然成为主流。

从初代粗糙的线性模型,到第三代兼顾速度、内存、精度的全能架构,Mamba-3 的问世,标志着状态空间模型正式走向成熟。在未来轻量化、低成本大模型的发展方向中,以 Mamba 为代表的线性模型必然成为主流。

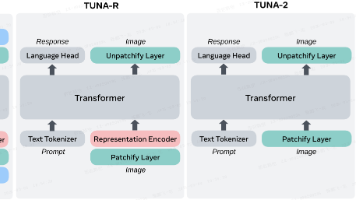

统一多模态模型 TUNA-2 直接在像素空间中执行多模态理解和视觉生成,无需依赖 VAE 编码器或潜在扩散。通过将统一的视觉语言主干与像素空间流匹配头相结合,TUNA-2 在单一框架内支持图像理解、文生图和图像编辑。

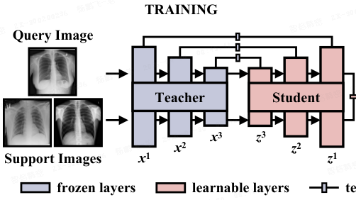

D^24FAD 是一种用于医学影像少样本异常检测的新型双蒸馏框架。通过利用预训练编码器作为教师网络,并采用一个在查询图像上蒸馏教师知识、同时在支持图像上进行自蒸馏的学生解码器,本文方法仅使用少量正常参考图像即可有效识别新任务中的异常。

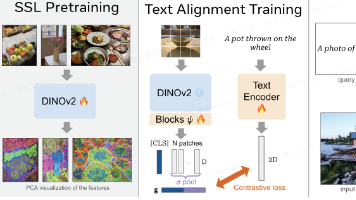

本文提出 dino.txt,它成功地将一个从零训练的文本编码器与冻结的自监督视觉模型 DINOv2 对齐,从而解锁了开放词汇能力。该方法结合了无需人工标注的自监督数据筛选技术,实现了快速训练,并在零样本分类和开放词汇分割上取得了顶尖性能。

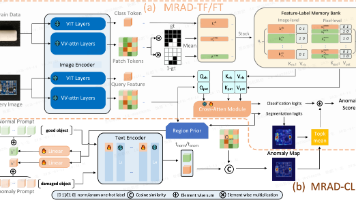

本文探索替代主流参数化拟合的异常检测方法,即直接利用辅助数据的经验分布。基于这一思想,本文提出了 MRAD,一个统一的记忆驱动的检索框架。基础模型 MRAD-TF 在冻结的视觉骨干网络上构建两级记忆库,并通过相似度检索解决分类和分割问题。

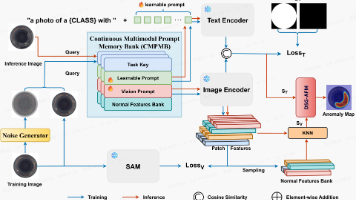

本文提出基于多模态提示的无监督连续异常检测框架。通过引入连续多模态提示记忆库,模型能够逐步提炼并保留跨视觉与文本领域的正常模式,有效缓解灾难性遗忘。缺陷语义引导的自适应融合机制通过自适应归一化与动态融合策略,提升了异常检测精度与定位能力。