简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

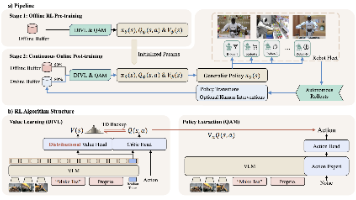

通过让机器人大军在实际干活时边干边学(Online RL),用分布式的强化学习算法,把预训练好的通用机器人模型(VLA)从“理论派”变成“实战派”,解决了离线数据无法覆盖真实世界复杂情况的痛点。

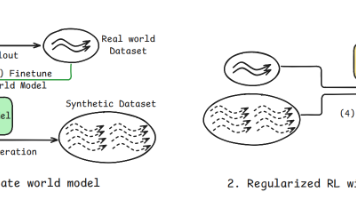

通过用真实机器人跑坏掉的数据“校准”世界模型(World Model),让这个模拟器不再“画饼”(过于乐观),然后用校准后的模拟器生成海量假数据来训练机器人策略,实现了在接触丰富、软体物体任务上的大幅提效。

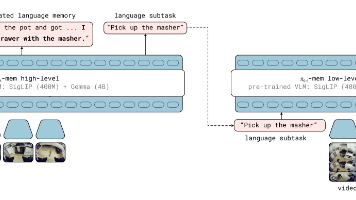

本文提出了一种名为MEM的多模态记忆架构,通过结合短时视觉记忆和长时语言记忆,解决了机器人模型在处理长达十几分钟的复杂任务时的记忆与效率平衡问题。

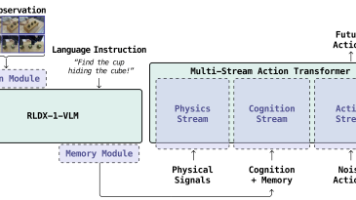

本文提出了一种名为RLDX-1的通用机器人策略模型,通过整合视觉、语言、动作以及触觉/扭矩等物理信号,并配合合成数据和推理优化,让机器人(尤其是人形机器人)能像人一样灵活地处理复杂的动态和接触丰富的操作任务。

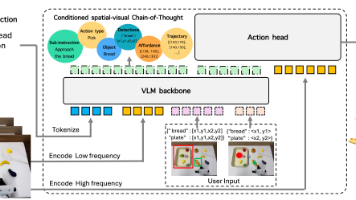

本文提出了一种名为GTA-VLA的框架,允许人类通过简单的点、框或轨迹等视觉提示来引导机器人的思考过程,从而解决机器人视觉理解错误或环境复杂导致的任务失败问题。

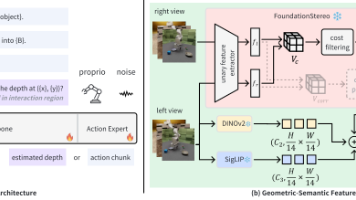

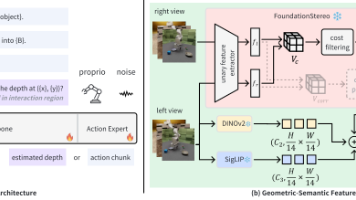

本文提出了一种名为StereoVLA的模型,通过引入双目立体视觉,显著增强了机器人视觉语言动作模型(VLA)的空间感知和操作精度。

本文提出了一种名为StereoVLA的模型,通过引入双目立体视觉,显著增强了机器人视觉语言动作模型(VLA)的空间感知和操作精度。

本文提出了一种名为LDA-1B的机器人基础模型,通过在统一的潜在空间中联合学习环境动力学、策略和视觉预测,实现了对海量异构数据(包括低质量数据和纯视频)的有效利用和扩展。

本文发布了新一代通用机器人模型GEN-1,通过大规模物理数据预训练和算法优化,首次让机器人在简单任务上达到了接近人类的“精通”水平(高成功率、高速度、能即兴应变)。

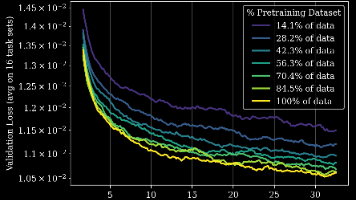

本文提出了GEN-0,一种通过海量真实物理交互数据进行预训练的具身基础模型,旨在建立机器人领域的“扩展定律”,实现机器人智能随数据和算力增加而可预测地提升。