简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

过去我们谈AI,常常从工程应用出发,把它理解为一种降本、增效、提质的工具。这种理解并没有错,因为大量真实场景中的AI价值,确实来自对已有任务流程的压缩、复制和优化。但对于AI研究者来说,这只是问题的第一层。真正的科研AI,是把AI本身作为研究对象,研究模型如何获得推理、规划、工具调用、多模态理解和长期交互能力,研究这些能力带来的安全、隐私、对齐和责任问题,并进一步重构AI研究的评价体系与方法论。因

1. 引言在深度学习十分火热的今天,不时会涌现出各种新型的人工神经网络,想要实时了解这些新型神经网络的架构还真是不容易。光是知道各式各样的神经网络模型缩写(如:DCIGN、BiLSTM、DCGAN……还有哪些?),就已经让人招架不住了。因此,这里整理出一份清单来梳理所有这些架构。其中大部分是人工神经网络,也有一些完全不同的怪物。尽管所有这些架构都各不相同、功能独特,当我在画它们的节点图时……其中潜

方面,如果是大模型的线上服务,需求往往是批量推理吞吐和足够大的显存,RTX 6000 Blackwell 的单卡性能和 96GB 显存非常契合此类需求,可以用于部署 70B 级别模型的加速推理。搜索了一下,好像没有很好的资料,特别是对于其具体的参数上,很多文章都是二手,三手,甚至是洋葱文章,无法做到详细的对比。) 的高带宽 HBM,内存带宽略低。4-bit 量化是更激进的一步,目前主要在研究阶段,

的职责看似简单,但实际上是整个系统最基础的约束来源。它所定义的并不是某一项具体能力,而是整个 Claw 的身份设定与行为风格,包括其角色定位、表达方式以及与用户交互的基本模式。例如,一个典型的 Identity 配置可能包含名称、角色类型(如 AI assistant)、整体风格(专业、结构化、简洁)以及一些统一的表达特征。这些信息共同决定了系统在面对不同任务时的“行为基调”。需要特别强调的是,I

的职责看似简单,但实际上是整个系统最基础的约束来源。它所定义的并不是某一项具体能力,而是整个 Claw 的身份设定与行为风格,包括其角色定位、表达方式以及与用户交互的基本模式。例如,一个典型的 Identity 配置可能包含名称、角色类型(如 AI assistant)、整体风格(专业、结构化、简洁)以及一些统一的表达特征。这些信息共同决定了系统在面对不同任务时的“行为基调”。需要特别强调的是,I

OpenClaw 之所以能在短时间内把星标推到 25 万量级,并在“可运行软件项目”的语境里形成“登顶”叙事,并不矛盾:它同时满足了“强价值主张、低上手门槛、插件生态飞轮、可传播叙事、争议带来破圈注意力”这五个条件。

Skills”在 2025–2026 年的语境里,已不仅是“可复用提示词模板”,而逐渐演化为一种可移植的、可工程化治理的“过程性能力包”:以文件夹为最小分发单元,包含SKILL.md(YAML frontmatter + Markdown 指令)、可选的(按需加载知识/规程)、assets/(模板/静态资源)与scripts/(可执行脚本),并以“渐进式信息披露(progressive discl

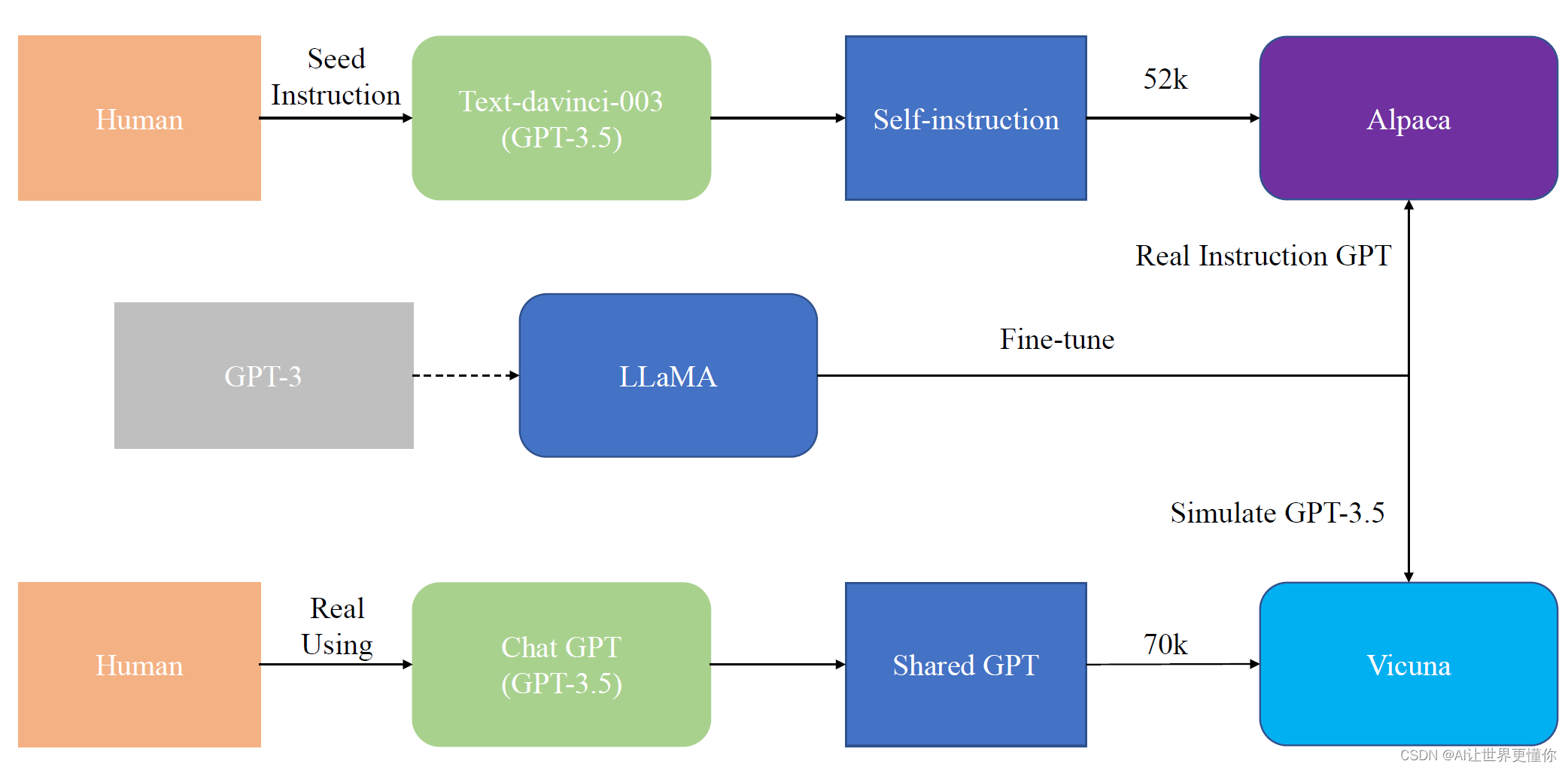

自ChatGPT发布至今已近半年,一路走来,我们可以清楚地看到的一个趋势是,到了下半年,每位研究者都会拥有一个类似ChatGPT的模型。这种现象与当年BERT推出后,各种BERT变体层出不穷的情况颇为相似。实际上,我认为,这次ChatGPT的浪潮依然是一次技术迭代更新,不断推动我们迈向最终的AI目标。而之所以如此轰动,则是因为OpenAI只做了一个每个人都可以访问的网页,让大众体会到了最先进的科技

希望大家在五一期间都能过的开心愉快,特地整理了25部关于人工智能的电影用于休闲时候观看。一方面能够享受科幻电影带来的放松,另一方面,也许未来的人工智能的研究和发展就会受到这些电影的启发。下面是按照剧情中人工智能发展的阶段进行的划分,需要注意的是,剧情中可能存在多个层次的人工智能并存的局面。

这里我们只是针对目前以深度学习作为方法进行人工智能实现的一点想法和探讨。对于其中技术细节不在此进行讨论,仅做科普探讨。学生-老师网络学生的知识不是直接通过数据,而是通过老师进行获得。我们都在进行通用人工智能(General Artificial Intelligence, GAI),我们希望人工智能最终不仅在生理和心理上,都和我们人类相类似。它具有听说读写,会思考,能行动的一个物种。那么...