简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

请帮我把下面这段句子用另一种方式重写,重写方式包括同义词替换,主动变成被动句等方式。

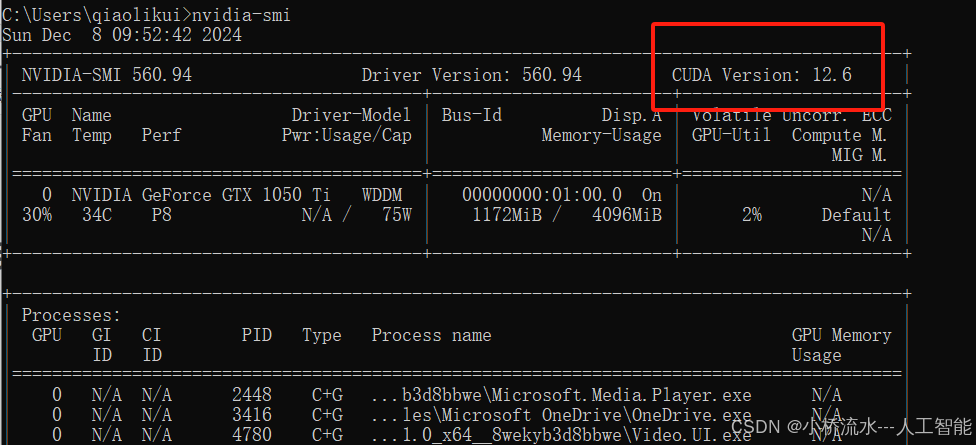

在命令窗口(cmd)中输出nvidia-smi。

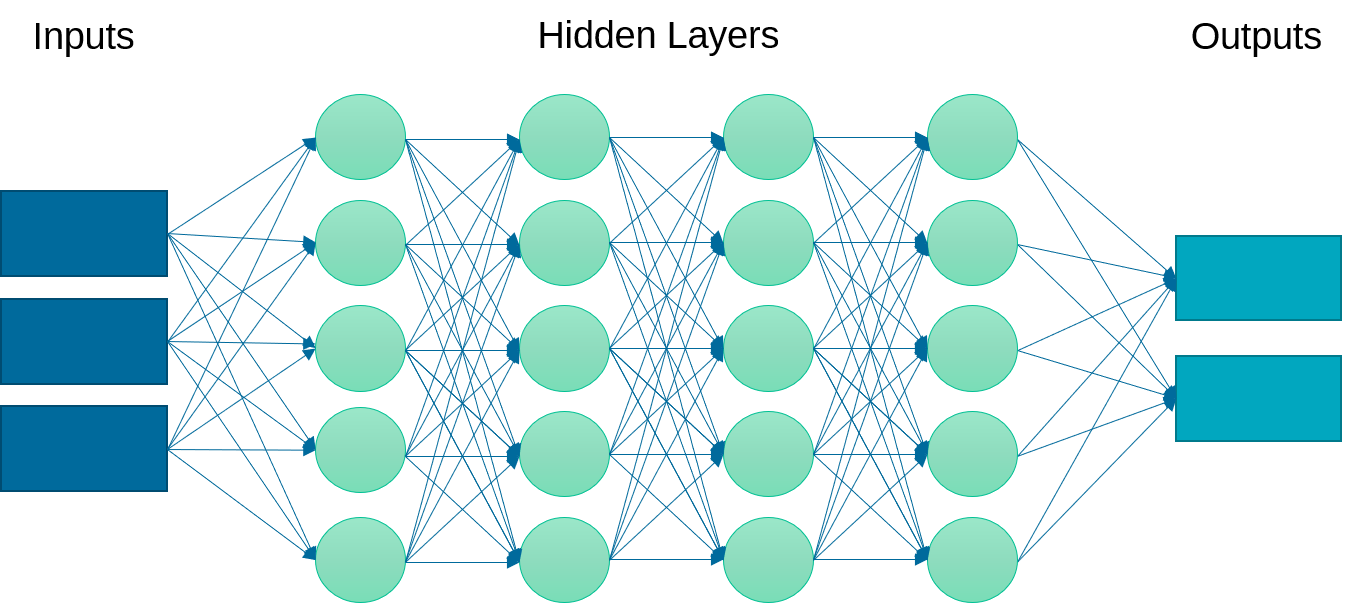

神经网络之所以强大,是因为它们能够通过复杂的层次结构自动学习数据中的隐藏模式和特征,尤其在处理高维、复杂和非线性数据时表现出色。

神经网络,作为人工智能和机器学习领域的核心技术之一,经历了多次起伏波动,每一次的高潮和低谷都深刻影响了该技术的发展轨迹和应用范围。本文将详细探讨神经网络的发展历程,包括其爆发期、低谷期,并对未来的发展方向进行展望。

解决ImportError: DLL load failed while importing _swigfaiss: 找不到指定的模块错误的关键是确保所有必要的依赖项正确安装,并且库与 Python 版本兼容。通过检查并更新系统依赖项,重新安装库,创建虚拟环境,以及配置环境变量,可以有效地解决这一问题。以下是一个示例,展示如何重新安装faiss。

在深度学习中,超参数(Hyperparameters)是指在训练模型时需要预先设置的参数,它们不会在训练过程中自动更新,而是通过手动调整来优化模型的性能。超参数的设置对模型的训练效果有着至关重要的影响。

尽管这些术语可能令人困惑,但了解它们的具体定义和差异是理解深度学习多样化工具箱的关键。

以上就是在 VSCode 中利用快捷键选择一样单词的步骤。注意,这个操作可能因不同的操作系统和版本有所差异,如果在你的环境中无法正常使用,你可能需要查看你的 VSCode 版本或者系统设置。

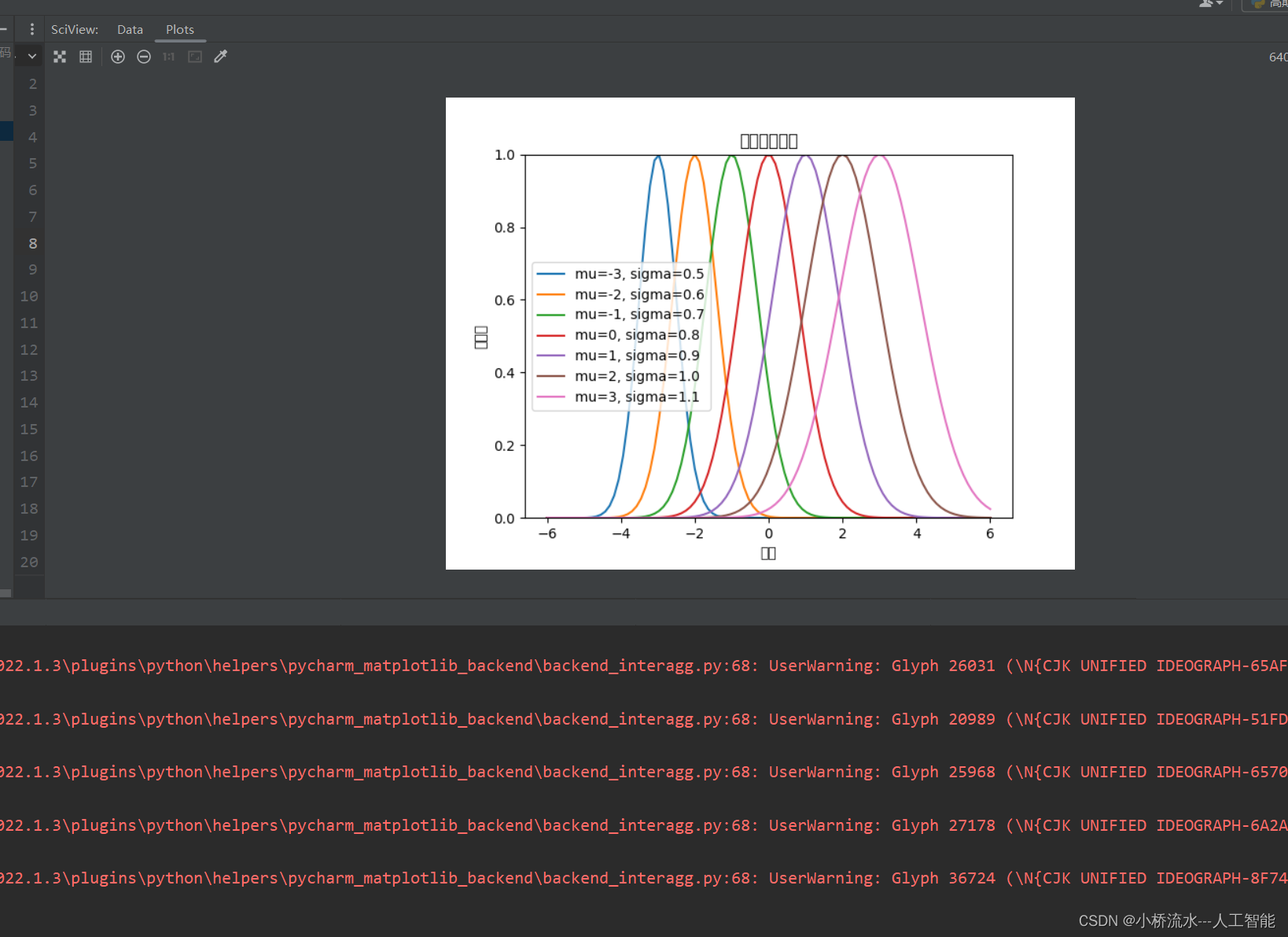

可以发现对中文,以及负号不显示。

把图中所有的字体(包括坐标轴、图例、注释)统一设置为。