简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

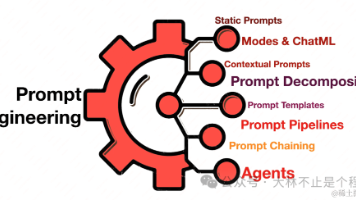

文章摘要: 本文聚焦人工智能领域的基础研究与提示词(Prompt)工程优化,强调理论基础与实用技巧并重。专栏“强基固本”致力于夯实AI学科的数理基础,同时通过分析优秀案例(如GPTs、字节扣子等平台)探讨Prompt设计的进阶方法。文章提出从现有优质案例中逆向学习Prompt编写技巧,并提供具体操作示例,包括如何提取隐藏提示词、优化文本风格转换等实用策略,旨在帮助读者提升大模型应用、训练及微调中的

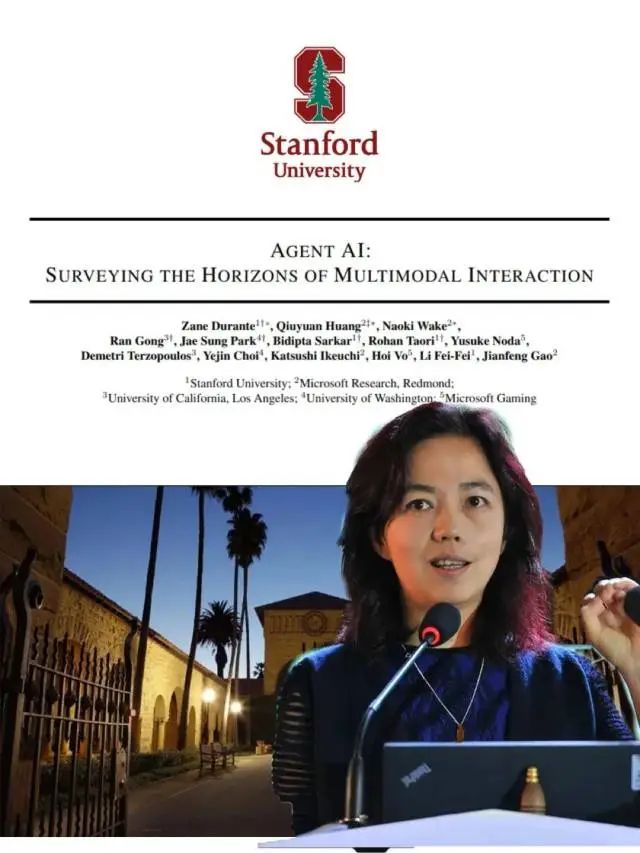

AGENT AI: SURVEYING THE HORIZONS OF MULTIMODAL INTERACTION》这份综述深入探讨了多模态人机交互(Human-Computer Interaction, HCI)的当前发展状态和未来的研究方向。多模态HCI旨在通过语音、图像、文本、眼动和触觉等多种信息模式来实现人与计算机之间的信息交换,这种交互方式在生理心理评估、办公教育、军事仿真和医疗康复等

这篇80页的论文由李飞飞等14位专家联合撰写,探讨了多模态AI系统的前沿发展。研究内容涵盖AI代理与基础模型的应用、环境嵌入和多模态感知能力等关键方向,重点分析了如何通过外部知识、多感官输入和人类反馈来优化具身代理系统。论文还涉及NLP领域的机器翻译、语音识别等技术应用,以及应对假新闻等挑战的解决方案。研究展望了Agent AI的发展前景,包括在物理世界和虚拟环境中的智能交互可能。论文提供了AI领

个性化推荐系统是AI技术在电商中最常见的应用之一。通过分析用户的浏览历史、购买记录、搜索行为等数据,AI算法能够精准地预测用户的兴趣和需求,从而向用户推荐最符合其偏好的商品。这种个性化的推荐不仅能够提高用户的购买转化率,还能增强用户的黏性和满意度。案例分析:亚马逊的个性化推荐亚马逊是最早应用个性化推荐系统的电商平台之一。其推荐系统基于协同过滤、深度学习等多种算法,能够实时分析用户的购物行为,生成个

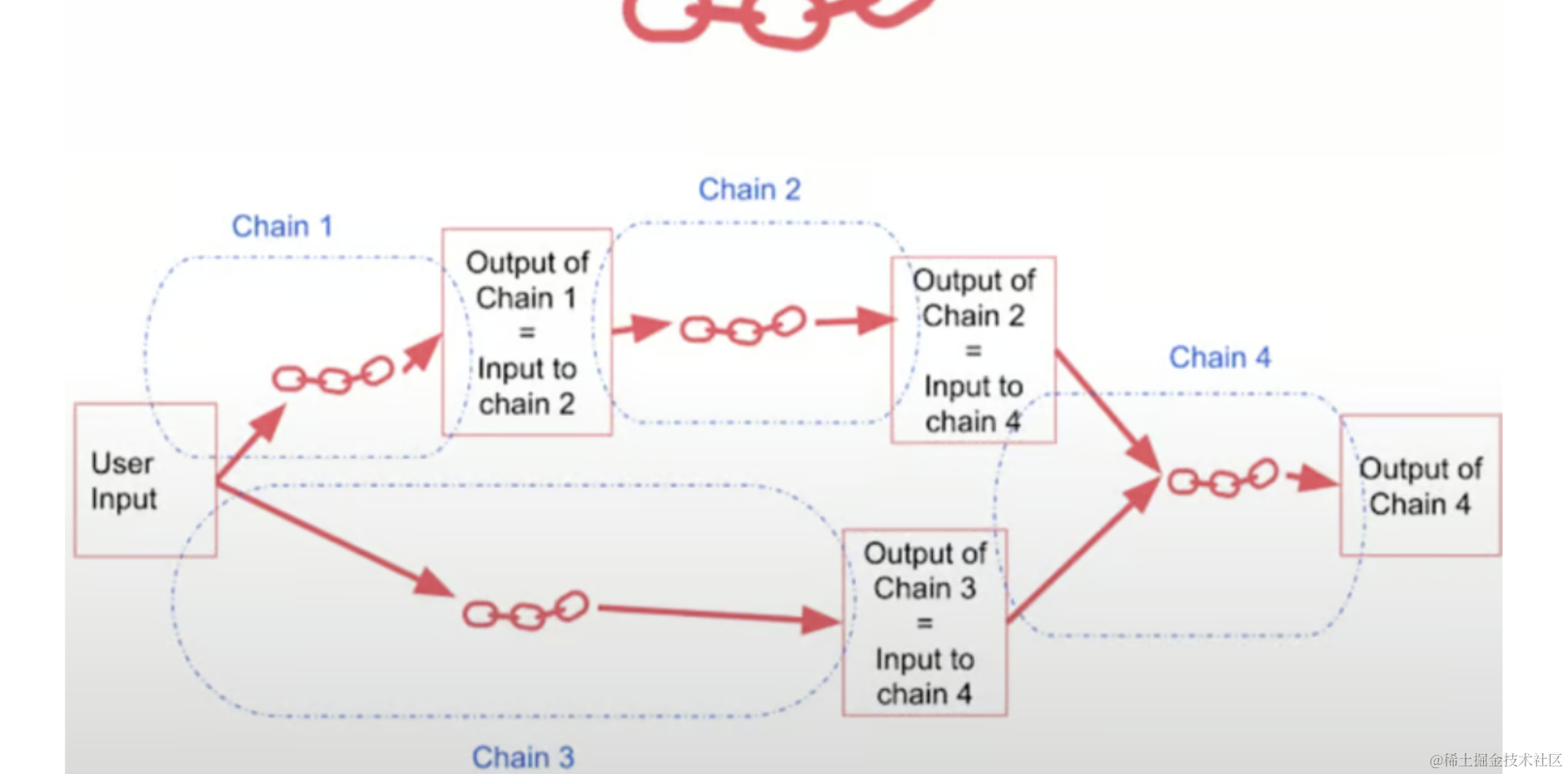

Langchain的核心是“链”的概念,这是一个构建块,允许您组合和编排不同的组件,以创建复杂而智能的应用程序。想象一下,您是一名数据科学家,正在从事一个尖端项目,该项目涉及处理和分析大量非结构化数据,例如客户评论、社交媒体帖子,甚至是学术论文。您的目标是从这些数据中提取见解和有价值的信息,但任务的庞大数量和复杂性可能令人生畏。使用LangChain链,您可以将这个非常复杂的任务分解成更小的、可管

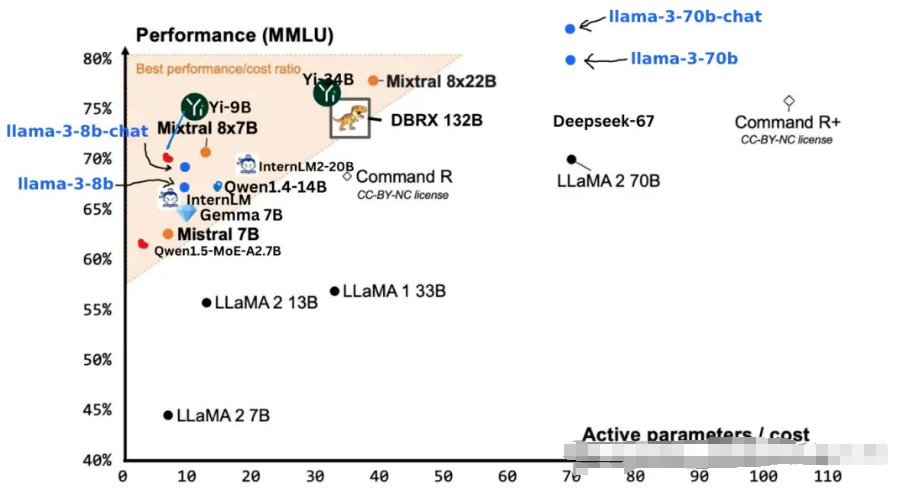

我们不禁感慨,虽然目前AI的实际应用仍显得零星,但技术的发展确实需要时间的积累。大型模型的昂贵推理成本无疑限制了其广泛的推广和应用。然而,正是像Llama 3和Phi3这样的小模型的崭露头角,让我们看到了大型模型实用化的希望。虽然小模型的训练成本相对较高,但它们低廉的推理成本为整体经济带来了显著的节省,尤其是在为海量用户提供服务时,高性能的小模型让AI摆脱了成本的束缚,更加灵活地应用于各种场景。想

AGENT AI: SURVEYING THE HORIZONS OF MULTIMODAL INTERACTION》这份综述深入探讨了多模态人机交互(Human-Computer Interaction, HCI)的当前发展状态和未来的研究方向。多模态HCI旨在通过语音、图像、文本、眼动和触觉等多种信息模式来实现人与计算机之间的信息交换,这种交互方式在生理心理评估、办公教育、军事仿真和医疗康复等

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。最新的面

大模型与数据分析的天然契合:降低使用门槛,赋能业务决策 数据分析正成为大模型的重要落地场景。随着数据分析工具从静态报表、敏捷BI发展到对话式BI,其核心趋势是不断降低业务部门的使用门槛。大模型的生成能力(如自然语言交互、自动生成分析报告和SQL查询)与决策能力(如指标归因和下钻分析)完美契合这一需求。目前银行、证券、消费品等行业已开始探索大模型与数据分析工具的深度结合,主要应用于经营决策(确保数据

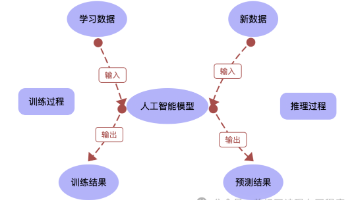

在已知的数据中学习规律从而建立模型,并且借助更多的数据自动修正、优化模型,最终利用模型解决问题的AI研究方法叫做“机器学习”。机器学习实际上分为两个阶段:在已知数据中学习规律,叫做“模型训练”,即“学习”;将新的数据输入到模型中得出结果,叫做“模型推理”,即“应用”,如图1所示。这个过程和人、动物的“学习”是一致的。