简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

前几篇,分享的都是如何白嫖国内外各大厂商的免费大模型服务~有小伙伴问,如果我想在本地搞个大模型玩玩,有什么解决方案?Ollama,它来了,专为在本地机器便捷部署和运行大模型而设计。也许是目前最便捷的大模型部署和运行工具,配合Open WebUI,人人都可以拥有大模型自由。今天,就带着大家实操一番,从 0 到 1 玩转 Ollama。

你猜一猜我现在参加什么样的活动呢?“你参加的是WAIC,就是那个人工智能的大Party,超多科技高手都在这……”“你帮我介绍一下这本书吧。“这书叫《反脆弱,从不确定性中获益》,讲的是怎么在混乱里找机会,作者塔勒布,来自土耳其,还写了《黑天鹅》,里面提了不少新词,像反脆弱者,书里挺有给我启发的东西……”以上两段对话来自7月5日,2024世界人工智能大会暨人工智能全球治理高级别会议(WAIC 2024

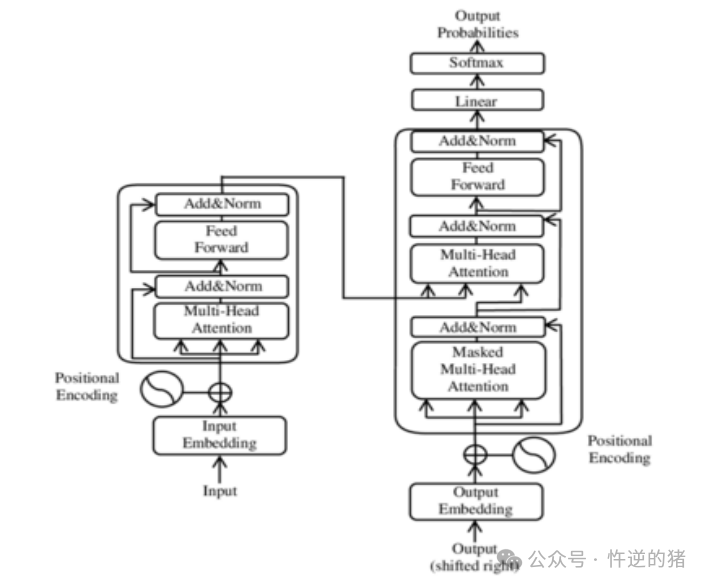

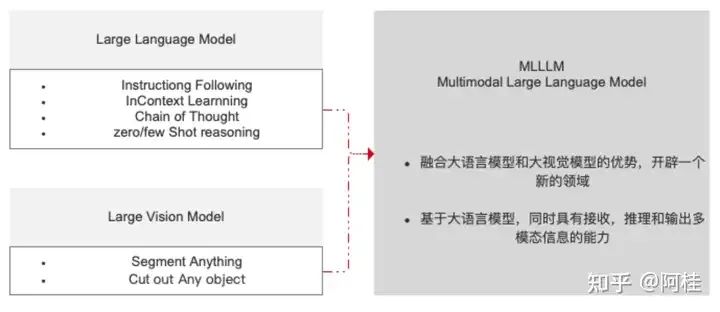

大语言模型(LLM:Large language model,下文称“LLM”)是基于深度学习技术来理解、处理并生成人类自然语言的的人工智能系统。是当今人工智能领域的一大重大突破性技术,基于大量的密集的文本数据的训练,通过自我监督和半监督学习的方式,从文本文档中训练学习相关的统计关系以达到对人类自然语言的理解与生成。技术原理上,大语言模型主要基于Transformer架构,该架构是2017年由谷歌

如果上传了一张图片,并向大模型提问。“图片中绿色框框中的人是谁?大模型回答:“那是波多野吉衣老师”请问,大模型是怎么做到的?我们用常规的思路来想一下,难道是:第一步:先对图片进行目标检测,先把绿色框的内容剪切出来;第二步:在剪切后的图片中,把人脸标记出来,并读取其landmark转为向量;第三步:在人脸向量库中进行比对,以便于确定其身份。整套流程下来,需要用到目标检测,人脸识别,向量存储与比对。最

本文讨论了如何使用 Hugging Face 推理终端搭建模块化的 “ASR + 说话人分割 + 投机解码”工作流。该方案使用了模块化的设计,使用户可以根据需要轻松配置并调整流水线,并轻松地将其部署至推理终端!

啥也不说了,直接上教程\1. 快速信息检索:能够迅速找到所需信息,提高工作效率。\2. 新员工便捷学习平台:新员工可以通过知识库快速获取公司文化、流程和专业知识,加速融入团队。\3. 制作客服机器人:利用知识库中的信息,企业可以制作智能客服机器人,为客户提供高效、准确的服务。在开始搭建知识库之前,我们需要做好充分的准备工作。以下是详细的步骤:\1. 使用的工具:Coze平台。

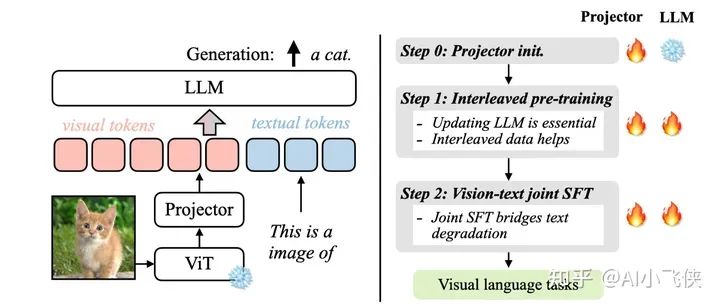

ChatDev——大语言模型驱动的多智能体协作与演化视频号目前主流的多模态大模型的训练基本都是分为来进行的。预训练阶段是为了让大语言模型(LLM),也可以认为是。微调阶段就是使用特定领域的数据,通过全量参数或者 LoRA这种参数高效的方法微调,让。VILA 这篇文章的研究重点就是从三个角度出发,找到一个最优的预训练方法。

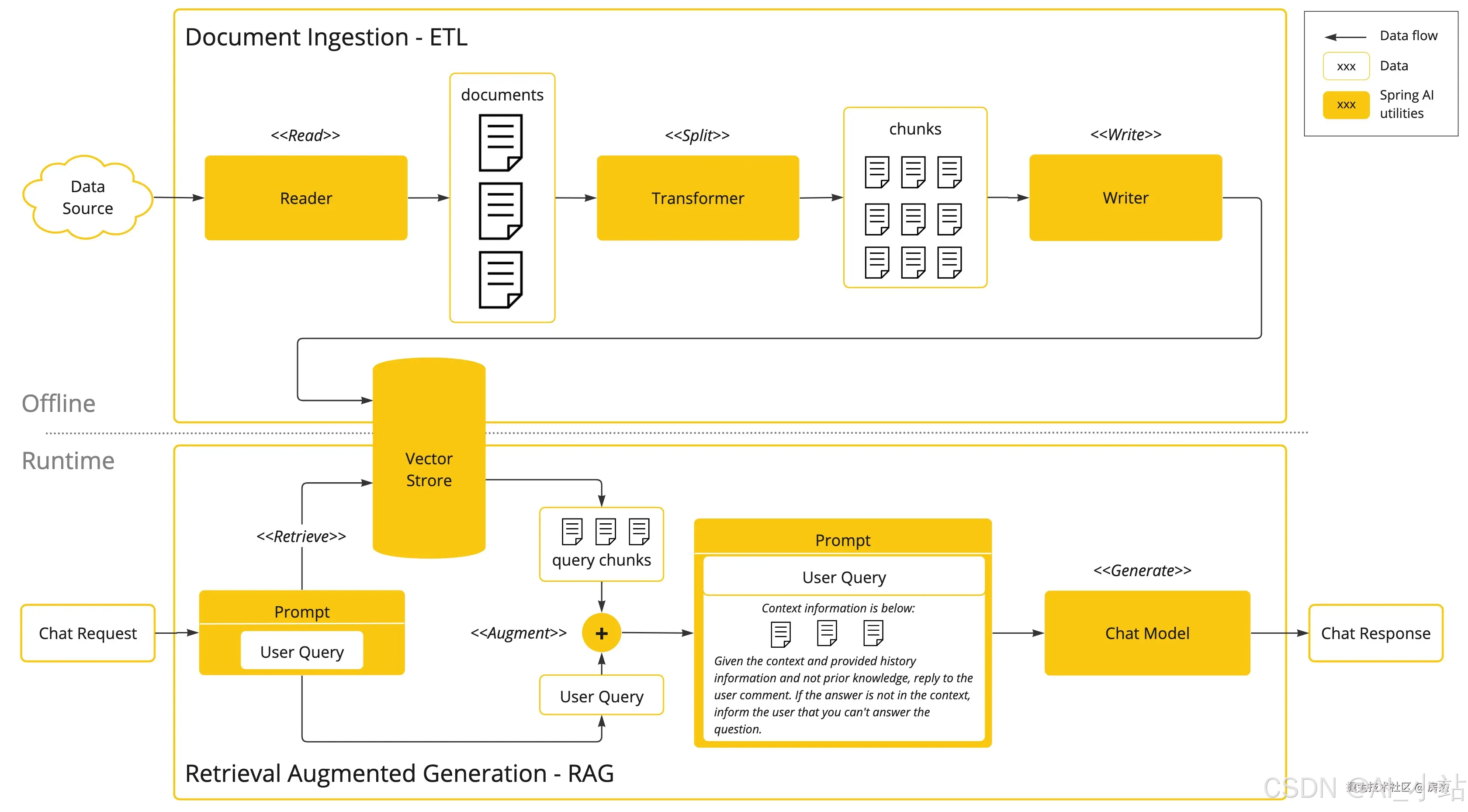

了解完嵌入模型、向量数据库相关知识后,在此基础上可以实现一个RAG本地问答系统。

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。在现在世面有众多的大模型,如果能训练

先讲讲实操过程会涉及到的知识点,之后我们会在实操当中实际用起来。