简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍了如何配置OpenClaw使用Ollama服务的Qwen3-VL 2B模型。首先需确保Ollama服务运行且模型已下载,然后编辑配置文件指定模型提供商和默认模型。配置包含设置API地址、模型参数(如contextWindow和maxTokens)等细节。修改完成后需重启网关服务,最后可通过TUI界面测试对话功能。注意事项包括确保服务地址匹配、模型ID正确等。配置文件示例展示了完整的参数设置

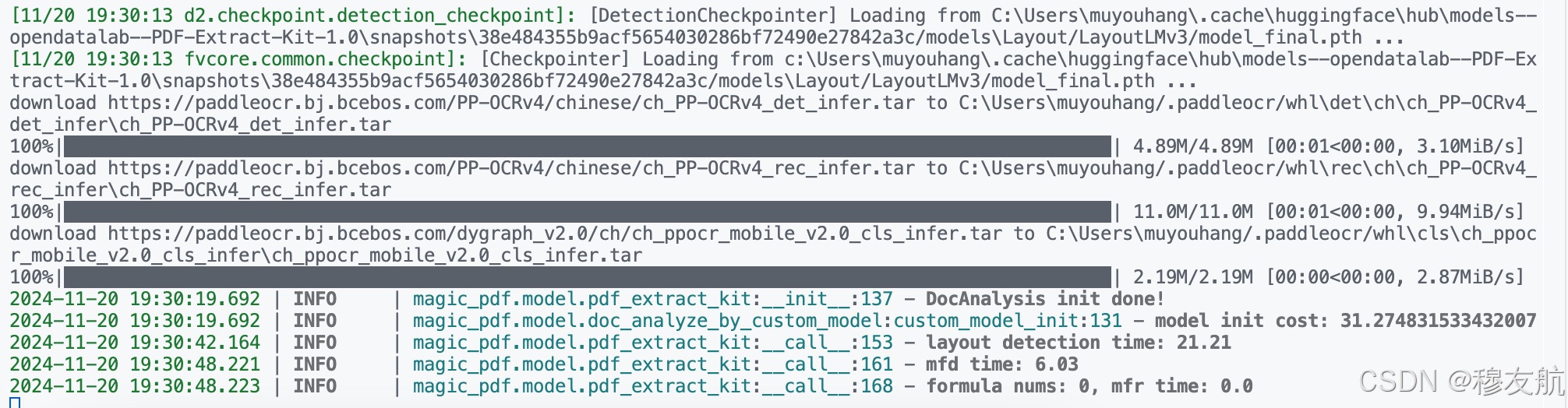

【代码】【开源代码】MinerU-PDF解析工具部署-CPU/GPU加速推理-可转Markdown格式。

【代码】使用opencv和PIL矫正带有EXIF信息的图像。

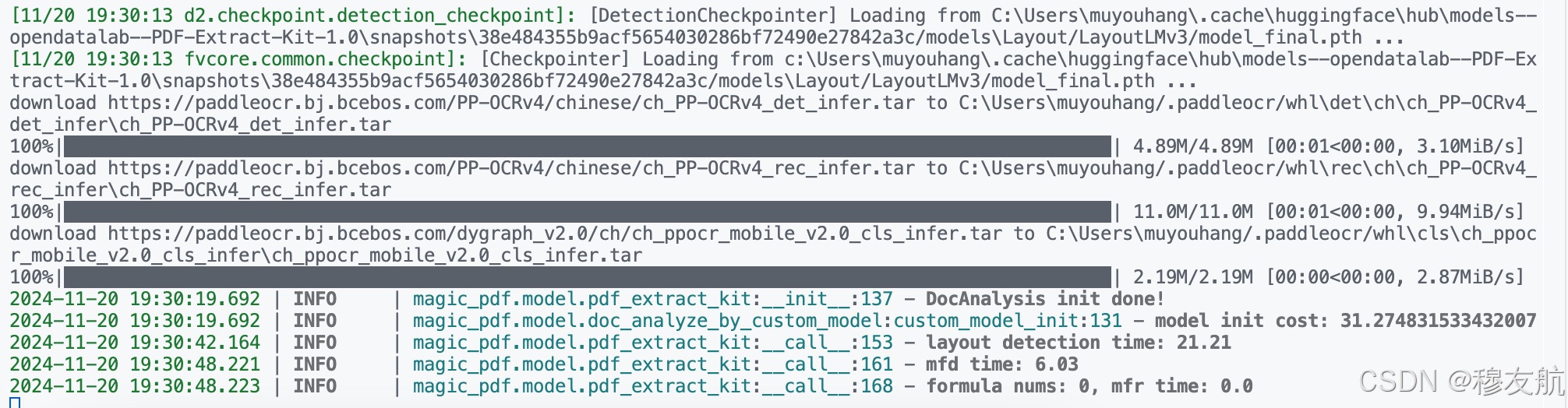

全球最小视觉语言模型SmolVLM-256M(2.56亿参数)及其高性能兄弟版SmolVLM-500M(5亿参数),通过三大技术革新实现“小模型大能力”:视觉编码重构:采用93M参数SigLIP base编码器,支持更高分辨率(384x384),性能接近400M级编码器,体积缩减77%;数据混合优化:强化文档理解(41%)与图像描述(14%)数据配比,提升OCR、图表推理等任务表现;To

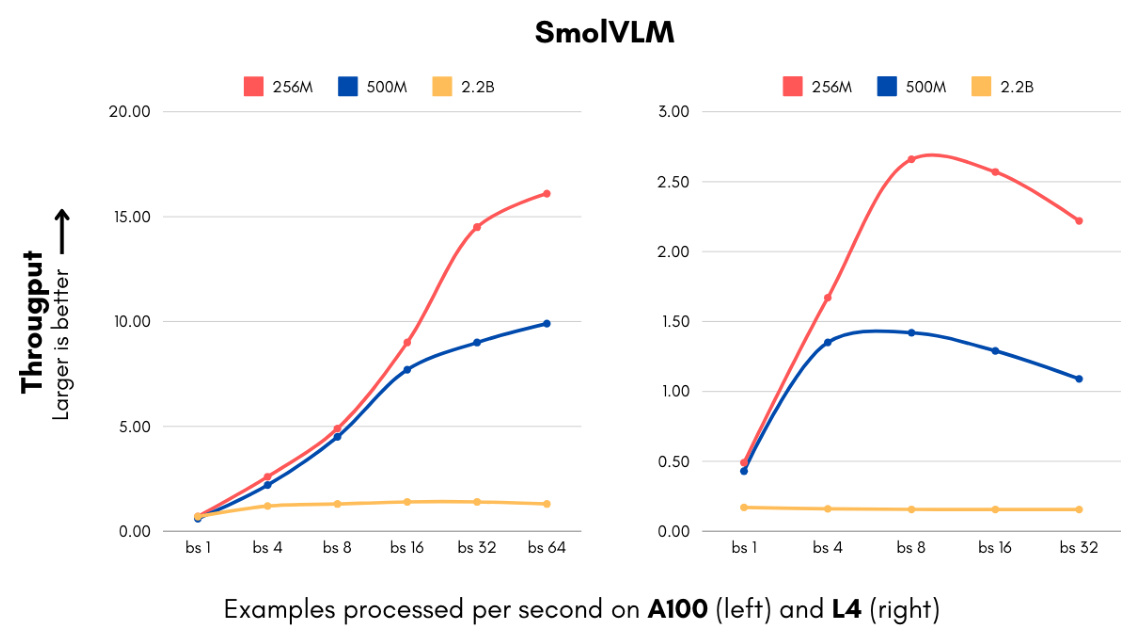

通过全新的TimmWrapper工具,您可以在熟悉的🤗 Transformers生态中为timm模型实现以下功能:⚡ 闪电般推理速度 | 🛠️ 5行代码完成量化 | 🚀 torch.compile加速支持 | 🎯 零门槛微调timm前置准备:安装最新版和完整代码示例与Notebook:🔗。

【代码】【开源代码】MinerU-PDF解析工具部署-CPU/GPU加速推理-可转Markdown格式。