简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

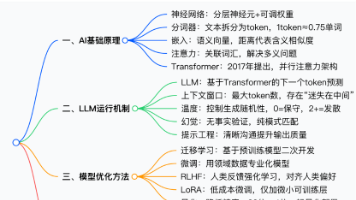

大模型技术及应用全景解析 摘要:本文系统梳理了大语言模型(LLM)的核心技术体系与应用实践。技术层面涵盖Transformer架构原理、预训练方法、微调技术(LoRA/QLoRA)、量化推理优化等关键知识;应用层面重点介绍RAG检索增强和Agent智能体开发两大热门方向。文章指出,掌握模型微调、RAG应用开发和Agent构建能力已成为AI工程师的核心竞争力,相关岗位需求激增且薪资可观。同时提供了完

以下是爬取京东商品详情的Python3代码,以excel存放链接的方式批量爬取。excel如下代码如下基本上除了过期的商品无法访问以外。对于京东的三种页面结构都做了处理。能访问到的商品页面。还做了模拟浏览器请求访问和下载。基本不会被反爬虫屏蔽下载。

数据分析项目|淘宝用户行为分析(Python+可视化)

本文系统阐述了大模型应用开发全流程,包括目标确定、功能设计、架构搭建、数据库构建、Prompt工程、验证迭代等关键环节。作者指出大模型开发更侧重工程实践而非模型原理研究,通过Prompt设计替代传统子模型训练,大幅降低开发门槛。文章还对比了传统AI开发与大模型开发的评估差异,强调通过持续收集Bad Case优化Prompt的重要性。最后提供了快速搭建Demo的工具推荐(Gradio/Streaml

AI技能链:提升AI应用稳定性的关键工具 摘要:本文深入分析了传统AI应用方式(如提示词)存在的效率低、结果不稳定等问题,提出AI技能链(Agent Skills)作为解决方案。技能链通过将专家知识和操作流程封装为可复用的结构化模块,使AI能够更稳定高效地执行任务。文章详细阐述了技能链的设计原理、调用机制和实现框架,并与传统方法进行了对比。技能链解决了巨型提示词灾难、执行能力与专业知识脱节、企业级

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

本文为程序员提供了一份AI大模型应用开发的11步转型路线图,涵盖基础技能(Python、提示词、Transformer)、核心技术(RAG、LangChain、Agent、多模态)和进阶实战(私有化部署、微调、量化、多Agent系统)。通过系统学习,程序员可快速掌握AI开发核心能力,抓住行业机遇。文章还提供了配套学习资料包,包含视频教程、技术文档、面试真题等资源,帮助开发者高效转型AI领域,应对人

为什么AI大模型成为越来越多程序员转行就业、升职加薪的首选很简单,这些岗位缺人且高薪智联招聘的最新数据给出了最直观的印证:2025年2月,AI领域求职人数同比增幅突破200% ,远超其他行业平均水平;整个人工智能行业的求职增速达到33.4%,位居各行业榜首,其中人工智能工程师岗位的求职热度更是飙升69.6%。AI产业的快速扩张,也让人才供需矛盾愈发突出。