简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

重新git clone就可以啦。

网址:https://github.com/RICHQAQ/PasteMD。

当数据量较少时,模型容易记住训练集特征。增强引入了噪声和变化,迫使模型学习更鲁棒的特征。模拟真实场景中可能出现的光照、角度、遮挡等变化,让模型在未见过的测试数据上表现更好。

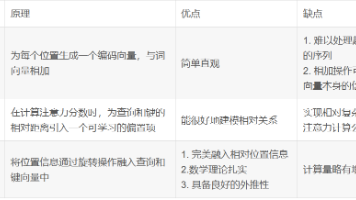

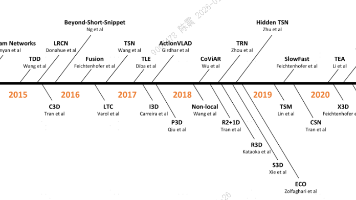

稀疏局部全局注意力机制(L+G):先利用所有帧中,相令的H/2和W/2的图像块计算局部的注意力,然后在空间上,使用2个图像块的步长,在整个序列中计算自注意力机制,这个可以看做全局的时空注意力更快的近似。轴向的注意力机制(T+W+H):先在时间维度上进行自注意力机制,然后在纵坐标相同的图像块上进行自注意力机制,最后在横坐标相同的图像块上进行自注意力机制。缺点:参数量大难训练,所以一般3D网络的深度都

objectInfo150.txt对应150类的类别标号,名称和各自所占的比例。3.上面的是语义分割数据集,下面的是实例分割数据集。2.进入官网后点这个。

文件,环境中装的是Python 3.8、PyTorch 2.2.2 和 CUDA 11.8。安装适用于 CUDA 11.8 的 PyTorch 2.2.2 版本。1.用conda创建一个Python 3.8 虚拟环境。3.安装 GPU 版本的 PyTorch。,选择与你的环境兼容的。

网址:https://github.com/RICHQAQ/PasteMD。

旋转位置编码是一种非常巧妙的、用于Transformer架构中的位置编码方法。它由苏剑林等人提出,并因其卓越的性能(尤其是在长序列建模中)而被广泛应用于如LLaMA、ChatGLM等大型语言模型。首先,我们需要理解为什么需要位置编码。原始的Transformer模型的核心——自注意力机制——本身是的。这意味着它处理序列“[A, B, C]”和“[B, A, C]”时,如果不提供额外信息,它无法区分