简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

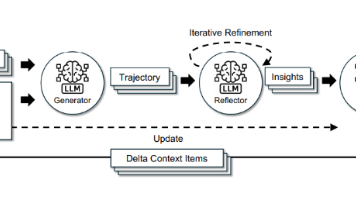

斯坦福大学等机构的研究团队提出Agentic Context Engineering(ACE)框架,通过动态优化上下文而非微调模型参数来提升大语言模型性能。ACE采用"生成器-反思器-整理器"三角色循环机制,以结构化增量方式更新上下文,有效解决传统方法中的信息丢失问题。相比微调,ACE具有成本低、效率高(延迟降低86.9%)、可解释性强等优势。研究者认为ACE与微调是互补关系:

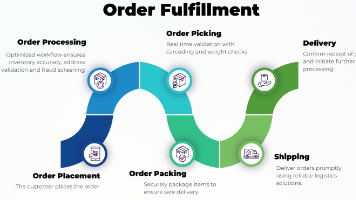

电商履约测试是对订单处理全流程的系统性验证,涵盖正向履约(下单-发货-签收)和逆向履约(退换货)全链路。核心测试点包括订单状态流转、库存管理、物流对接、支付联动及异常处理等,需验证多仓分发、预售等复杂场景。测试方法推荐接口测试、端到端流程模拟、压力测试及数据一致性校验,重点关注系统集成、状态同步和异常容错能力,确保电商订单高效准确履约。

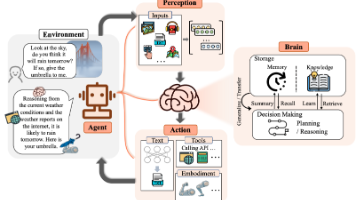

本文介绍了一个基于LangGraph框架的智能测试用例生成器,该智能体具备感知、规划、生成、反思和学习五大核心能力。系统通过感知节点检索历史用例,规划节点制定测试策略,生成节点创建测试用例,反思节点评估质量,学习节点存储经验形成闭环。智能体采用ChatTongyi作为LLM引擎,搭配Chroma向量数据库实现记忆功能,支持将结果保存至SQLite和CSV。相比传统工具,该智能体具有自主规划、持续学

随着Manus智能体的爆火,不禁想了解一下到底什么是agent?想上手agent开发需要掌握哪些内容?如果大家也有同样的问题,那这篇文章将给大家答案!

本文提供了一份医疗AI偏见测试报告的标准模板(版本1.2),适用于诊断辅助、分诊系统等医疗AI应用。模板包含基础信息、测试目标、敏感属性定义、公平性指标阈值等核心模块,重点评估不同患者群体在诊断准确率、分诊优先级等方面的公平性表现。测试结果显示心脏病诊断存在4.1%的性别差异(女性准确率偏低),农村患者获得紧急分诊的比例低于城区6.4个百分点。报告提出了数据增强、模型优化等改进措施,并强调需符合《

AI偏见是指人工智能系统在决策过程中对特定群体(如性别、种族、年龄等)产生系统性不公平对待的现象。测试工程师需重点关注四大偏见类型:数据偏见、算法偏见、部署偏见和交互偏见。测试方法包括群体公平性测试、对抗样本测试和影子测试,核心指标需监控统计均等性、机会均等性等差异是否超过5%阈值。企业应建立完整的AI偏见测试流程,从需求分析到持续监控。测试工程师凭借用户视角和系统思维优势,在AI伦理测试领域具有

摘要:本文系统介绍了Prompt Engineering的核心技术,重点解析了Few-shot Prompting和Chain-of-Thought(CoT)两大方法。Few-shot通过提供示例样本指导模型输出特定格式或风格,而CoT则通过分步推理解决复杂逻辑问题。文章提出四层级的Prompt设计框架:基础指令、上下文增强、思维工程和外部工具调用,并建议测试人员采用边界值测试、等价类划分等软件测

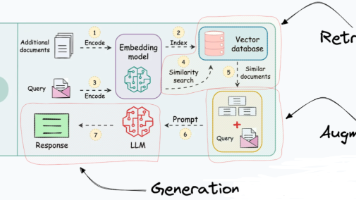

本文通过图书馆系统的比喻,清晰区分了LlamaIndex和ChromaDB在RAG系统中的不同角色:ChromaDB如同"书架和目录卡",专注于向量存储与检索;LlamaIndex则像"图书管理员",负责数据预处理、索引管理和查询优化等高层逻辑。两者并非重复,而是互补关系——LlamaIndex依赖ChromaDB实现持久化存储和高效检索,同时提供更复杂的数

摘要:OpenAI发布的PromptEngineering指南归纳了六大核心原则:1.写清楚指令,包括任务具体化、提供细节和设定角色;2.提供参考文本以解决模型"幻觉"问题;3.将复杂任务拆分为简单子任务;4.给模型思考时间,采用思维链等方法;5.利用外部工具弥补模型不足;6.迭代式开发优化Prompt。这些原则构成了大模型应用开发的通用标准,建议通过"角色-目标-背

RAG(检索增强生成)技术栈解析:本文系统介绍了构建高效RAG系统的关键工具链及其分工。核心组件包括:LlamaIndex(专注高效数据索引与检索)、LangChain(灵活编排复杂工作流)、RAGAS/TruLens(评估系统质量)、Unstructured(专业文档解析)。文章对比了各工具的核心优势,建议根据应用场景选择技术组合——简单问答优先LlamaIndex,复杂智能体选用LangCha