简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

SGLang、TensorRT-LLM和vLLM是三种主流的大模型推理框架,各具特色。SGLang专注于结构化输出和高效缓存,适合多轮对话场景;TensorRT-LLM依托NVIDIA硬件加速,优化推理速度和GPU利用率;vLLM则通过分页注意力机制提升显存效率,适用于高并发场景。三者分别在编程灵活性、硬件适配性和资源管理方面具有突出优势,为不同应用需求提供了多样化的解决方案。

本文介绍了一个基于PyTorch的三层全连接神经网络实现。模型结构包含128→96→64→32的线性层,每层后接ReLU激活和20%的Dropout。代码演示了完整的训练流程(使用随机数据),包括模型定义、数据加载、训练循环(20个epoch),以及模型保存与加载预测。关键点包括:训练后保存权重为.pth文件、加载时需重建模型结构、预测时切换eval()模式禁用Dropout、使用no_grad(

Rerank模型是RAG流程中的关键组件,用于对Embedding初筛结果进行精细排序。它通过「查询+文档」的全序列交互计算相关性分数,解决Embedding粗筛的语义模糊问题,平衡检索效率与效果。与独立编码的Embedding不同,Rerank能捕捉细粒度匹配,优先排列真正相关的文档。选型需考虑性能指标(MRR/NDCG)、推理效率、语言领域适配及生态支持。最佳实践是Embedding召回Top

Qwen3模型文件夹文件主要分为四类:1)模型架构与配置文件(config.json等),定义模型结构和运行方式;2)分词器文件(tokenizer.json等),负责文本与数字token的转换;3)模型权重文件(model.safetensors等),存储训练好的参数;4)辅助文件(README.md等),提供说明文档。核心流程:先读取config搭建模型框架,加载权重参数,通过分词器处理输入输

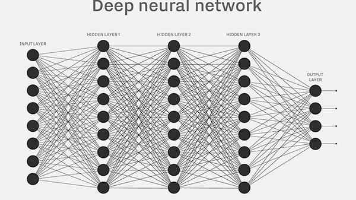

神经网络是深度学习的核心架构,由多个基础组件构成:人工神经元作为基本计算单元,通过权重、偏置和激活函数进行非线性转换;单层神经网络实现简单映射,而多层神经网络通过隐藏层提取高阶特征;常见的激活函数包括Sigmoid、Tanh和ReLU,用于引入非线性能力;权重和偏置通过反向传播优化;输出层根据任务类型选用不同激活函数。这些组件协同工作,使神经网络能够学习复杂模式,解决分类、回归等多样化问题。理解这

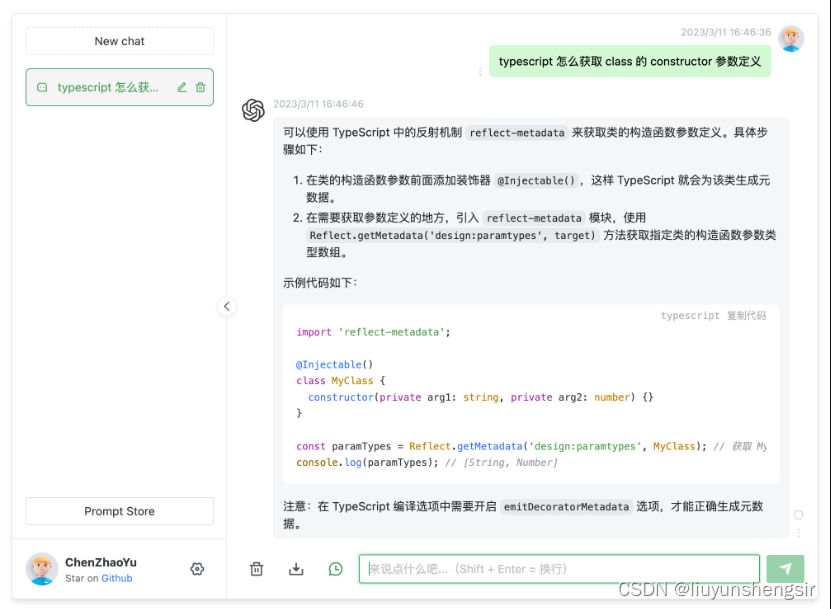

ChatGPT 可以作为虚拟助手,帮助用户执行各种任务,如设置提醒、发送电子邮件、查找信息、预订餐厅等。:ChatGPT 可以用于提供即时的客户服务和支持,回答常见问题、解决问题和提供指导。它可以与作家、编辑和内容创作者合作,提供灵感、建议和修改意见。它可以理解用户的查询,并提供相关的答案、解释和建议。这些只是 ChatGPT 的一些应用场景示例,它的用途非常广泛,可以适应许多不同的领域和任务。:

LMCache是一种创新的KV Cache管理系统,专为大规模模型推理和多机部署设计。该系统采用六层架构,包括应用层、集成层、核心层、存储层、传输层和部署架构,实现统一、分布式的KV Cache管理。核心特性包括分块管理与多层存储、智能请求路由、异步传输与并发控制、高效编解码与压缩,以及跨节点共享能力。LMCache通过GPU/CPU/NVMe/远程存储的统一管理,显著提升推理性能,降低显存压力,

本文介绍了程序性能分析(Profile)的概念和应用。Profile用于测量程序运行时的性能指标,如执行时间、资源占用等,帮助开发者发现瓶颈并进行优化。文章详细讲解了CPU和GPU性能分析工具(如cProfile、nvprof、PyTorch Profiler等),以及关键性能指标(执行时间、内存占用、FLOPs等)。特别针对深度学习场景,提供了PyTorch Profiler的实践示例,展示如何

利用OpenAI Triton 进行算子优化附完整代码样例,Triton 是 OpenAI 开发的一种专门用于编写深度学习内核的编程语言和编译器。它让开发者能用 Python 语法编写高性能的 GPU 代码(类似 CUDA),但比 CUDA 更易用、更高效。

OpenClaw是一个强大的数据操作框架,结合Elasticsearch的搜索和分析能力,可以构建高效的数据处理管道。以下是实现这一集成的详细方案.