简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

跨域问题原因是前端代码放在A服务器上,其中的脚本需要访问B服务器的接口,此时在浏览器上因为安全问题限制访问因此需要在B服务器的配置白名单中加上A。服务器需要向发出的 http 响应中添加一些 Access-Control 标头,以指示哪些网页有权从 Web 浏览器读取该信息如果只是调试用,可以在A服务器上配置代理到B服务器,如nginx配置如下:proxy_passB服务器地址;然后将代码中访问B

LiveTalking开源项目提供数字人嘴型驱动技术,支持离线与实时音频处理。离线系统处理完整音频文件,而实时系统采用流式数据处理策略,通过前后缓存参数(stride_left_size/right_size)平衡延迟与准确性。系统初始化时会预填充音频队列,采用16帧批次处理,保留部分帧作为上下文缓存。音频特征通过滑动窗口与视频帧匹配,不同模型(mel/whisper/hubert)有特定参数配置

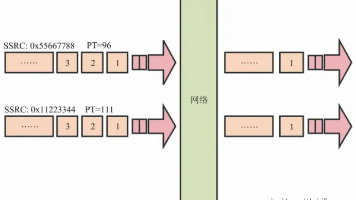

本文介绍了如何使用TURN转发服务解决GPU服务器UDP端口受限的问题。主要内容包括:1)在云服务器安装coturn服务并配置认证信息、UDP端口范围;2)服务端开放TCP 8010端口运行livetalking应用;3)修改客户端配置使用TURN服务地址。通过这种方式,可在不开放UDP端口的服务器上实现视频转发,每路视频需要2个UDP端口。提供了详细的配置步骤和测试方法。

摘要:文章探讨了实时数字人LiveTalking在多并发场景下的模型推理优化方案,比较了多进程与多线程的优劣。多线程可减少显存占用(共享模型),但可能影响实时帧率;多进程则存在显存线性增长问题。测试数据显示:wav2lip(1.3G显存/750fps)支持30路并发,musetalk(12G显存/60fps)支持2路,ernerf(2G显存/45fps)建议用多进程。针对不同模型特性提供了线程/进

Livetalking是一款实时数字人驱动系统,支持WebRTC协议视频流输出。主要功能包括:1)文字实时播报,内置多种TTS服务;2)智能问答,默认集成阿里云Qwen大模型,支持替换为其他模型;3)语音输入播报,可直接上传音频文件或通过WebSocket传输实时音频流。系统提供灵活接口,支持JSON和Form-data数据格式,适用于各类数字人交互场景,用户可根据需求选择内置服务或对接外部AI模

在深度学习中经常要用到nvidia显卡,本文介绍linux平台下nvidia显卡驱动和深度学习配套库的安装及常见问题解决

Livetalking是一款实时数字人驱动系统,支持WebRTC协议视频流输出。主要功能包括:1)文字实时播报,内置多种TTS服务;2)智能问答,默认集成阿里云Qwen大模型,支持替换为其他模型;3)语音输入播报,可直接上传音频文件或通过WebSocket传输实时音频流。系统提供灵活接口,支持JSON和Form-data数据格式,适用于各类数字人交互场景,用户可根据需求选择内置服务或对接外部AI模

在tensorflow的分布式训练中,默认将参数以变量名的维度分布式存储在不同ps上。如将item_embedding存储在ps0上,item_bias存储在ps1上。默认不会将同一个变量存储在不同的ps上。在实际情况中,有的变量行数很多,如item_embedding的行数一般有几百万量级,如果存储在同一个ps上,会导致该ps成为性能瓶颈。为了解决以上问题,在tensorflow中可以通过定义p

介绍bimserver的安装及安装中遇到的问题解决,讲解怎么导入工程文件到bimserver中并能在线浏览3d模型