简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

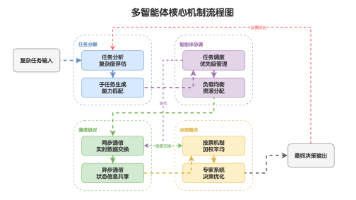

文章摘要:从零构建AI Agent的入门指南 本文系统介绍了如何从零开始构建AI Agent的核心原理和实践方法。首先解析了Agent的核心工作循环:用户输入→LLM思考→决策→工具调用→反馈循环。文章重点阐述了五种主流Agent工作模式(提示词链、路由、并行化、编排者-工作者、评估者-优化者),并提供了新手友好的构建公式:Agent=角色+目标+工具+规则+输出格式。作者特别强调工具设计要精简实

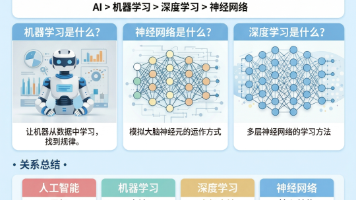

本文梳理了人工智能相关概念的关系:人工智能(AI)是总目标,机器学习是实现AI的重要方法,深度学习是机器学习的升级版,神经网络则是深度学习的核心结构。人工智能涵盖语音识别、自动驾驶等应用;机器学习让机器从数据中自主发现规律;深度学习通过多层神经网络处理复杂数据;神经网络模仿人脑结构进行信息处理。四者形成包含关系:AI>机器学习>深度学习>神经网络,其中深度学习通过深度神经网络自动

例如,当婴幼儿看到一只狗的时候,父母会告诉他/她–这是狗,此时婴幼儿接收到的输入数据就是少量的有标签数据,这样反复多次之后,婴幼儿再看到其他品种的狗–大量的无标签数据,他/她也可以依据之前的经验,非常准确地判断其面前的是不是一只狗,这个过程就是半监督学习。例如,如果给模型看100张不同狗狗的照片,模型会学习出狗狗具备的共同特征,从而将它们分为一类,当模型再看到新的狗狗的照片时,依然可以将其归类到和

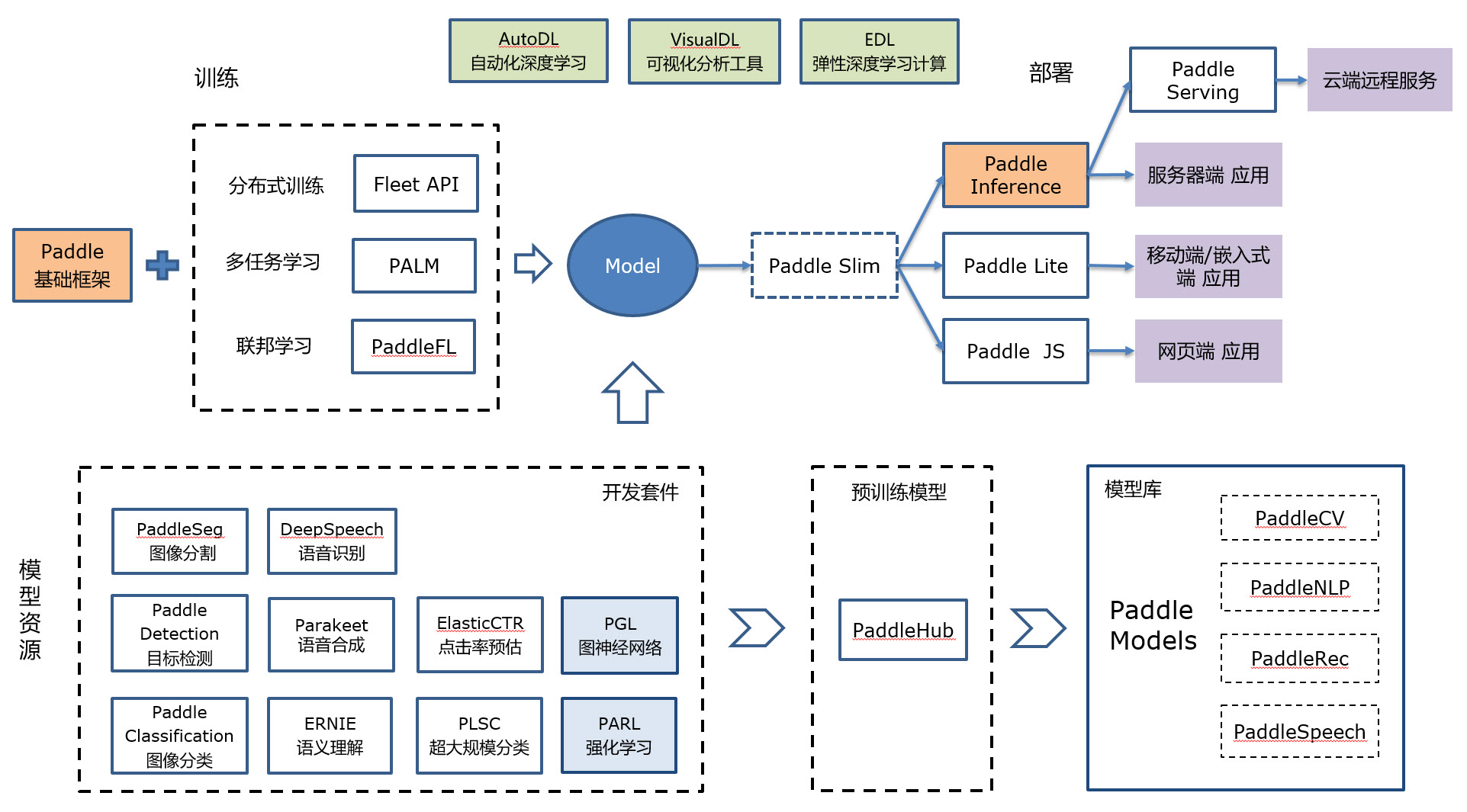

本文系统梳理了大模型技术的发展脉络和知识体系。首先回顾了人工智能从符号主义到深度学习的演进历程,重点分析了Transformer架构的革命性意义及其核心机制。随后详细阐述了大模型训练的三个关键阶段(预训练、微调、对齐)以及不同应用形态的分类。文章还介绍了Prompt Engineering和RAG等实用技术,最后探讨了智能体(Agent)技术的定义与发展方向。通过可视化图解方式,帮助读者构建从AI

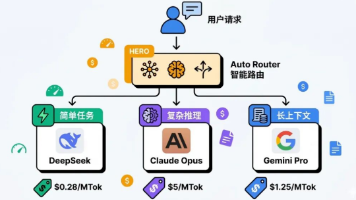

大模型对话本质是单向请求-响应机制,Token作为文本处理的基本单位直接影响使用成本和效率。本文解析了对话机制、上下文窗口限制和Token计费规则,指出中文比英文消耗更多Token,并对比了主流模型的优劣势。关键发现包括:上下文窗口决定模型"记忆"能力,输出Token价格是输入的3-5倍,Claude 4.6取消了长上下文额外收费。文章提供了Prompt缓存、批量接口等实用省钱

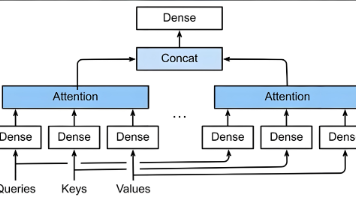

本文介绍了自注意力机制这一神经网络创新架构。首先阐述了其与传统模型的不同之处在于能够捕捉输入序列内部的动态关联。其次详细讲解了两种注意力评分函数(加性注意力和缩放点积注意力)的计算原理及适用场景。最后深入解析了多头注意力机制,说明了其通过多个注意力头并行计算来提取更丰富特征的方法,并提供了完整的PyTorch实现代码。文章还指出AI大模型发展迅速,相关人才缺口巨大,建议读者把握机遇学习这一前沿技术

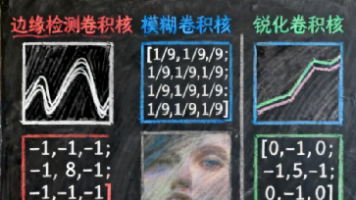

CNN通过局部连接和权重共享优化FNN,实现高效图像处理。其核心机制包括卷积(通过滑动窗口加权求和提取特征)和池化(降维与特征提取)。输入输出通道的3D思维是关键,1×1卷积可实现通道压缩与扩展。代码示例展示了PyTorch中CNN层的实现,包括卷积、ReLU激活和池化操作。CNN通过分层特征提取,逐步整合局部到全局信息,成为计算机视觉领域的基石架构。

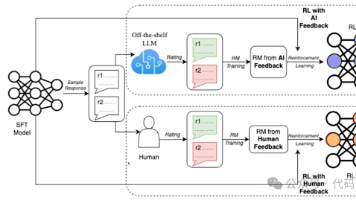

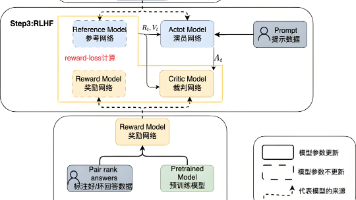

RLHF(基于人类反馈的强化学习)奖励模型训练(Reward Model Training):训练一个语言模型,用于判断回答的“好”与“坏”(例如“点赞”或“点踩”)。RLHF 微调(RLHF Fine-Tuning):使用由人类专家标注的**(提示,好回答,坏回答)** 数据,结合奖励模型对 LLM 进行对齐训练,使其生成更符合人类偏好的回答。1、训练奖励模型 - 学习人类的偏好训练一个能够代替

摘要: 本文通过小学考试奖励机制的类比,生动解释了强化学习(RL)中的关键优化技术。从仅依赖绝对分数(Reward)的弊端出发,逐步引入Critic(价值函数)提供动态基线,降低方差;通过Clip操作限制策略更新幅度,防止极端波动;借助Reference Model约束行为合规性。最终介绍GRPO创新方法,用同组输出的平均Reward替代Critic,兼顾效率与稳定性。全文以“考试-零花钱”为线索

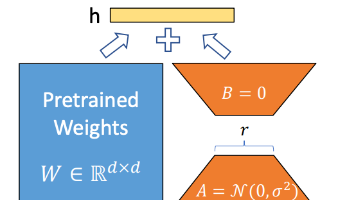

LoRA(低秩适应)是一种参数高效微调技术,通过低秩矩阵分解大幅减少微调参数。文章解析了低秩矩阵相乘的数学特性(秩不超过原矩阵最小值),说明其能有效近似满秩矩阵的核心信息。重点介绍了LoRA微调策略设计:仅调整模型部分参数(如自注意力层),通过低秩矩阵A、B实现参数更新。实验表明合理选择秩r(通常较小)可保持模型性能,且微调矩阵ΔW与原权重W存在放大关系。该技术显著降低了大模型微调资源需求,成为当