简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

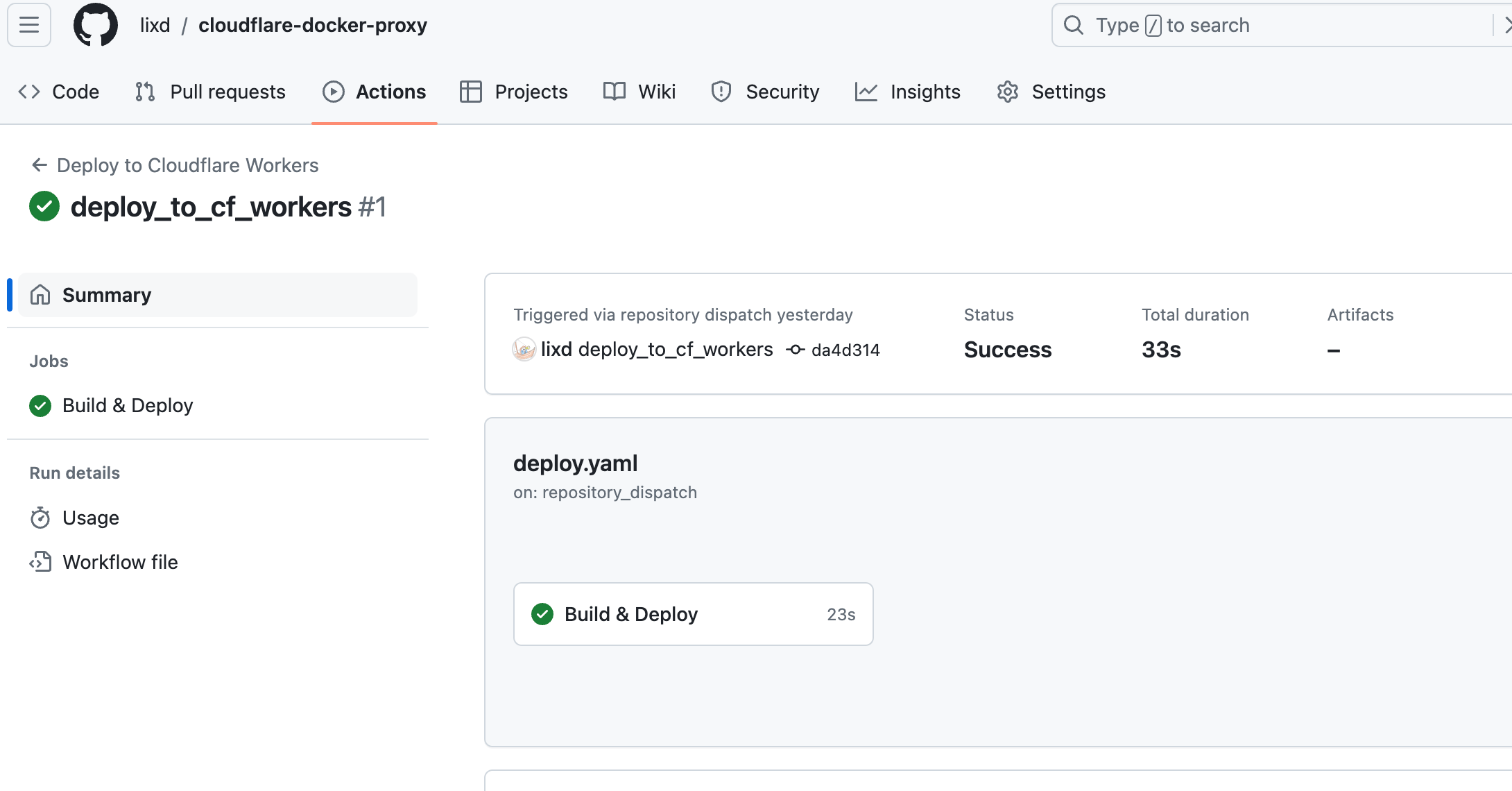

本文主要介绍了如何基于 Cloudflare Workers 和 cloudflare-docker-proxy 搭建 dockerhub、gcr、quay 等镜像加速服务。

DevOps 另一选择?云原生 CICD: ArgoWorkflow 初体验。

本文主要记录了如何通过docker-compose来搭建etcd,包括单节点和集群模式及其web监控。1. 单节点1. 目录结构/usr/local/docker/etcd--/data--docker-compose.yml2. docker-compose.ymlversion: '3'network

运行记录使用 Workflow CR 对象存储运行日志则存放在 Pod 中,通过 kubectl logs 方式查看因此需要保证 Pod 不被删除,否则就无法查看了但是也正因为所有数据都存放在集群中,当数据量大之后etcd存储压力会很大,最终影响到集群稳定性。为了解决该问题 ArgoWorkflow 提供了归档功能,将历史数据归档到外部存储,以降低 etcd 的存储压力。1)将 Workflow

手动触发:手动提交一个 Workflow,就会触发一次构建,那么我们创建的流水线,理论上是 WorkflowTemplate 对象。,类似于 k8s 中的 job 和 cronjob,CronWorkflow 会定时创建 Workflow 来实现定时触发。Event 事件触发:比如通过git commit 触发,借助可以实现此功能。

上一篇我们部署了 ArgoWorkflow,并创建了一个简单的流水线做了个 Demo。本篇主要分析 ArgoWorkflow 中流水线相关的概念,了解概念后才能更好使用 ArgoWorkflow。

大模型推理有多种方式比如最基础的 HuggingFace TransformersTGIvLLM其中,热度最高的应该就是 vLLM,性能好的同时使用也非常简单,本文就分享一下如何使用 vLLM 来启动大模型推理服务。根据 vLLM 官方博客所说:进行了 NVIDIA A10 GPU 上推理 LLaMA-7 B 和 在 NVIDIA A100 GPU(40 GB)上推理 LLaMA-13 B 两个实

大模型微调,通常指有监督微调(Supervised Fine-Tuning, SFT),是在预训练模型(一般称为“基座模型”)的基础上进行的训练过程。预训练模型通常已经掌握了广泛的语言知识和语义表示,但为了让模型在特定任务或领域上表现得更好,我们会在特定任务的数据集上对其进行微调。1)Language Model,LM:一个预训练语言模型 LM,对基础模型微调得到一个微调后的模型使用人工标注的数据

本文主要分享如何使用 LLaMAFactory 实现大模型微调,基于 Qwen1.5-1.8B-Chat 模型进行 LoRA 微调,修改模型自我认知。more本文的一个目的:基于模型进行微调,修改模型自我认证。修改前对于模型,用户问你是谁?时模型一般会回答我们希望在微调之后,对于同样的问题,模型能回答。

本文介绍了一种开源的GPU虚拟化方案HAMi(Heterogeneous AI Computing Virtualization Middleware)。相比于传统的TimeSlicing方案,HAMi不仅支持GPU共享,还能对GPU核心和显存进行细粒度隔离与限制(1%级别),确保各Pod获得相应资源。HAMi采用vCUDA方案,通过拦截CUDA/NVML API实现资源控制,当Pod使用超过申请