简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在Android开发领域,如果你想在职场上更进一步,实现升职加薪的梦想,那么掌握Android Framework层面的知识就显得尤为重要。不仅如此,随着华为鸿蒙操作系统(HarmonyOS)的崛起,对Framework的深入理解更是成为了开发者技能必不可少的一项!!Android Framework是Android操作系统的核心组成部分,它提供了一系列的API和服务,使得开发者能够构建功能丰富的

金三银四马上就要来了,大家别死磕Android和iOS了,看看鸿蒙吧!!!鸿蒙,作为华为推出的全新操作系统,自诞生以来便备受瞩目。它不仅具备跨平台的能力,而且注重安全性和用户体验,是未来智能设备互联互通的重要桥梁。随着鸿蒙生态的日益完善,掌握这门技术的人才需求也日益旺盛。然而,现状却是许多职场人士对鸿蒙的了解还停留在表面,甚至有人持观望态度,认为它不过是一个新兴的操作系统,不值得投入时间去学习。这

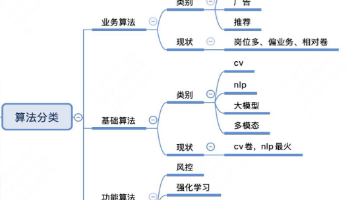

本文系统解析了AI领域三大类岗位(基础算法、应用算法、工程与业务)及其具体要求,包括大模型算法专家、AIGC工程师等热门职位。文章为有志于AI行业的大学生提供了入行指南:夯实编程、数学和深度学习基础,积累项目经验,把握校招时间线,掌握投递与面试策略,并强调AI行业重视真才实学,需要理论与实践结合。

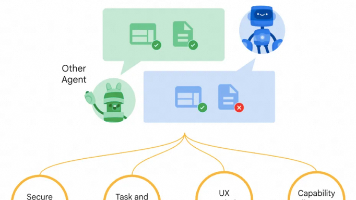

Google发布的Agent2Agent Protocol(A2A)是一个促进不同类型智能体间高效沟通与协作的开放协议,提供安全协作、任务状态管理、用户体验协商和功能发现四大特性。该协议通过AgentCard、Task、Artifact等核心概念,采用C/S模式和HTTP通信,实现Agent间的互操作。作为MCP的补充,A2A强调Agent间的对等交互,将有力推动Agent生态系统的完善与发展,是

文章详细介绍了在个人服务器上部署开源版Coze平台并搭建智能体的完整流程,包括硬件要求、Docker安装、服务配置、Nginx代理设置、模型配置及工作流创建。通过部署到自有服务器,开发者可灵活使用Coze构建不受平台限制的智能体,适合希望将大模型技术应用到实际业务中的程序员。

文章介绍了Embedding的三种传统统计表示方法:One-Hot编码、词袋模型和TF-IDF。从简单直观的One-Hot到考虑词频的词袋模型,再到引入权重概念的TF-IDF,每一步都使文字数字化表示更"聪明"。这些方法虽有局限,但为后续基于神经网络的词向量表示奠定了基础,是理解现代大模型中Embedding技术的重要起点。

Agent是能自主感知环境、决策并执行动作以完成特定目标的智能系统。文章系统介绍了Agent从规则驱动系统、强化学习到大语言模型时代的发展历程,重点详解了LLM Agent的两种典型架构:ReAct(推理-行动交替)和Plan-and-Execute(先规划后执行)。通过代码实战展示了零框架实现ReAct和使用LangChain实现Plan-and-Execute的方法,帮助读者构建能自主完成复杂

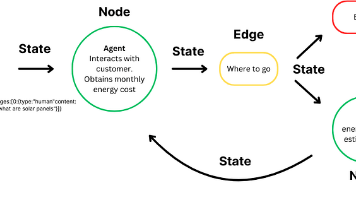

本文介绍如何使用 LangGraph 构建高级 AI 智能体,通过太阳能板节能计算示例展示完整实现。LangGraph 支持循环计算、状态管理和多步任务执行,核心包括状态、节点和边三大概念。文章详细展示了从环境配置到工作流定义的全过程,帮助开发者创建智能、可适应的 AI 系统。

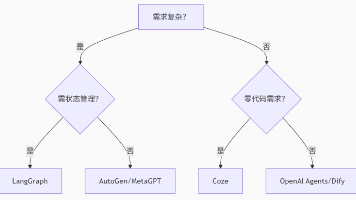

本文对LangGraph、AutoGen、Dify等10款AI Agent开发框架进行全方位对比分析,从核心定位、技术特性、典型场景、成本模型和社区支持等维度评估各框架特点。针对复杂流程管理、多智能体协作、快速原型开发等不同场景,提供了详细的选型建议,帮助开发者根据技术储备、业务需求与预算选择合适的框架,必要时可采用混合架构满足复合需求。

文章介绍了AI Agent的核心概念和优势,详细对比了三大热门框架:LangGraph(提供循环和状态管理,适合复杂流程)、AutoGen(微软出品,支持多智能体协作)和CrewAI(角色扮演型框架,适合商业自动化)。文章通过表格形式分析了各框架的核心范式、控制力、上手难度和最佳场景,帮助开发者根据自身需求选择合适的框架,实现高效AI应用开发。