为什么你的AI总是“失忆“?上下文工程深度解析,看完这一篇你就知道了!

本文介绍了上下文工程的概念、重要性及实践方法。与提示工程不同,上下文工程聚焦于"给什么"而非"怎么说",旨在解决AI的"上下文衰减"问题。由于AI注意力预算有限且更擅长短任务,需通过精准精简素材、按需即时检索信息,以及采用上下文压缩、结构化笔记和子智能体架构等策略,让AI用最少的关键信息高效完成任务。上下文工程重塑了人与AI的协作关系,将AI视为存在注意力极限的队友,而非无所不能的机器。

前言

你有没有过这样的体验?跟 AI 聊得久了,它突然 “失忆”—— 前面提过的关键信息没了下文,甚至答非所问;让它处理复杂任务,比如分析大数据库、写长代码,它越往后越混乱…… 其实不是 AI “不认真”,而是它的 “注意力” 有限。

一、上下文工程 vs 提示工程

首先,什么是上下文工程?

Anthropic给出的定义是:为LLM在推理过程中,策划和维护最优信息集合的一系列策略,简单说:

- 提示词工程:聚焦 “怎么说”(写好指令);

- 上下文工程:聚焦 “给什么”(筛选、管理 AI 能用到的所有信息,包括指令、历史对话、工具数据、外部文件等)。

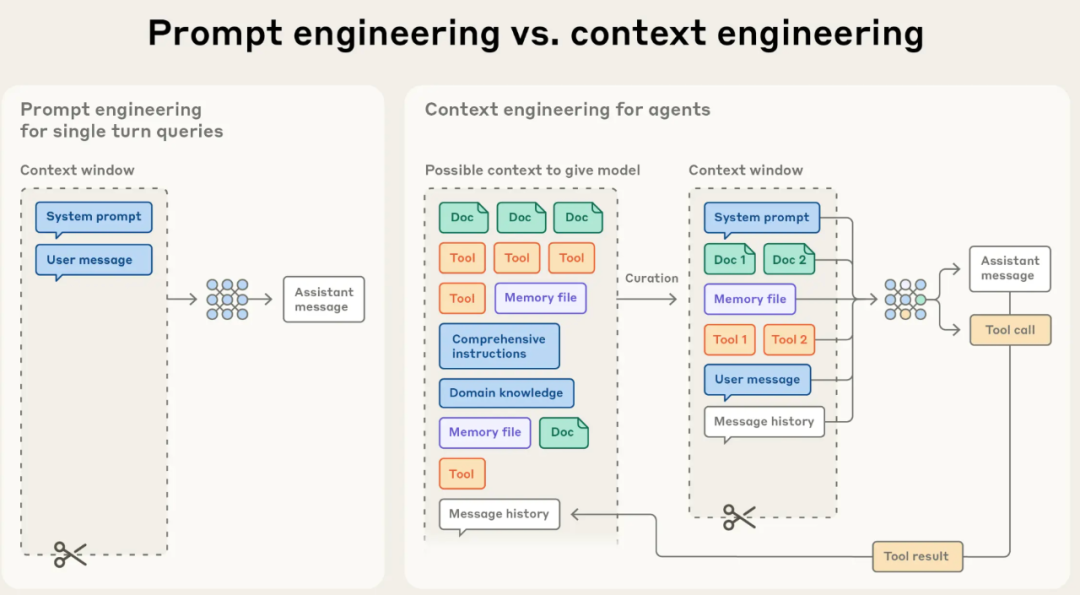

用一张对比图展示二者的区别:

左侧的提示工程,流程简单:系统提示+用户消息,直接生成回复

右侧的上下文工程,则是一个动态循环:模型需要从一个包含文档、工具、记忆文件、历史消息等庞大的“可能上下文池”中,通过一个“策划”环节,筛选出最优信息组合,填入有限的上下文窗口,然后才能进行思考、调用工具并生成下一步行动。这个“策划”过程,在Agent的每一次决策循环中都会发生,是上下文工程的核心。

二、为什么必须做上下文工程?

Anthropic 发现一个关键问题:Context Rot 上下文衰减。AI 的上下文里塞的信息越多,它能准确记住、利用的比例就越低。这背后有两个原因:

- AI 的注意力预算有限:AI基于Transformer 架构”,每新增一个token,它要处理的关联关系会呈平方级增长,信息越多,精力越分散;

- AI 更熟悉短任务:训练 AI 的数据里,短文本比长文本多,它处理长序列信息的经验本就少。

所以,上下文工程的核心不是给AI 越多信息越好,而是用最少的关键信息,让 AI 刚好能完成任务,把AI 的注意力用在刀刃上。

三、如何做好上下文工程?

1. 素材要精准精简

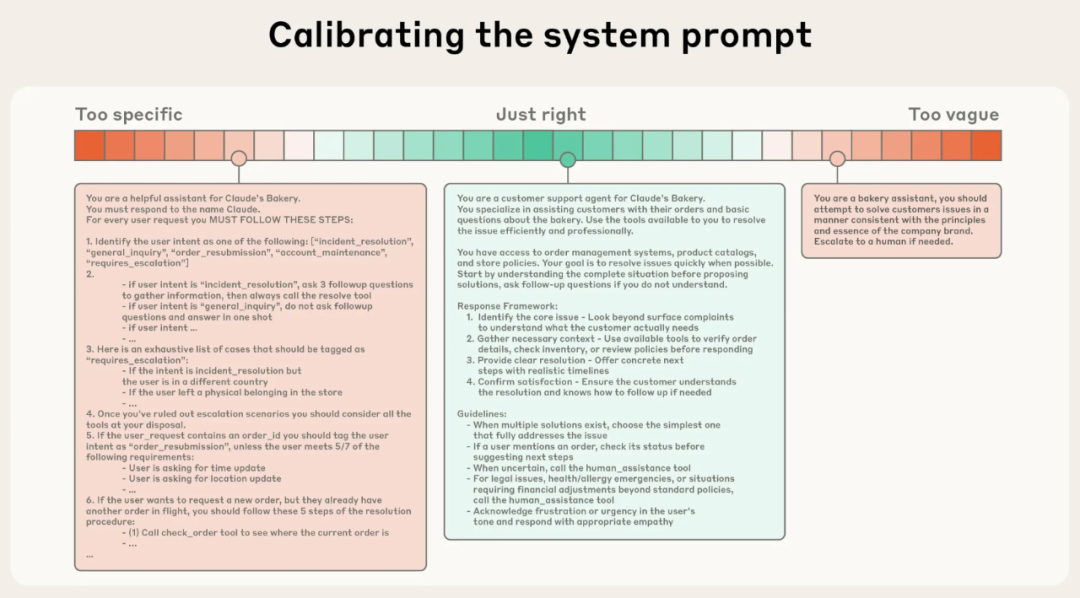

AI 的上下文窗口是有限资源,每加一条信息都要算性价比。比如写系统提示词要避开两个坑:

- 别写太复杂的硬逻辑:比如 “如果用户问 A 就答 1,问 B 就答 2,问 C……”,这样 AI 灵活度低,改起来还麻烦;

- 别写太模糊的空话:比如 “帮我处理一下这个需求”,AI 根本不知道要做什么。

2. 按需取信息,别提前塞满

以前用AI 习惯把所有资料提前喂给它,但这样既占空间,AI 还容易找不到重点。Anthropic 推荐Just-in-Time 即时检索:让 AI 像人一样,需要什么信息再去拿,比如:

Anthropic 使用Claude Code 分析大数据库时,不会加载所有数据,而是先写查询指令(比如 “查近 30 天的销售 Top10”),只把查询结果加载到上下文里;

如果需要看数据细节,再用 “head/tail” 命令看前 10 行、后 10 行,像查资料时,先看目录,再翻具体章节,不把整本书都放桌上。这种方式不仅省空间,还能让 AI 更专注,不用花精力分辨。

3. 处理长时任务三大策略

如果让 AI 做需要几小时甚至几天的长任务(比如迁移整个代码库、写一份深度研究报告),上下文窗口肯定不够用。Anthropic 给了 3 个实用方案:

① 上下文压缩

当对话接近上下文窗口极限时,需让模型对前期交互内容进行总结与压缩,随后以压缩摘要开启新的上下文窗口。

这一方式能以高保真度提炼关键信息,同时丢弃冗余内容。其中,最简单的压缩形式便是直接清理旧的工具调用及对应结果,仅留存决议性关键信息,类似会议记录整理中对无关交流片段的剔除逻辑。

② 结构化笔记

结构化笔记又称agentic memory 智能体记忆,是通过技术手段为 AI 搭建上下文窗口之外的 “外部记忆空间”,让 AI 定期将关键信息持久化存储至该内存中,在后续需要时再重新拉回上下文使用。例如:

Anthropic 展示的 Claude 玩《宝可梦》案例中,Agent 在未被明确提示的情况下,自主学会创建待办事项列表、绘制已探索区域地图、记录战斗策略;在项目处理场景中,AI 可生成 “NOTES.md” 文档,记录 “当日完成数据采集工作,次日计划开展数据可视化任务” 等进度与规划内容。借助这一方式,即便上下文窗口重置,AI 仍可通过读取自身笔记恢复任务进度,无缝衔接流程,确保长至数小时的任务持续推进。

③ 子智能体架构

相较于让单个 Agent 维护整个项目的状态,子智能体架构更侧重让专门的子智能体处理集中化任务。其核心是构建 “主 AI + 子 AI” 的分层协作模式:主智能体负责高层级的规划与协调,子智能体则深入执行技术工作或信息检索,且仅向主智能体返回精炼摘要。这种 “关注点分离” 的模式,在复杂任务中优势显著。以深度研究任务为例:

主 AI 的核心职责是 “制定研究框架,明确需涵盖行业数据查询、竞品分析、用户调研等模块”;子 AI1 专注于 “行业数据的检索与初步整理”,子 AI2 专注于 “竞品核心优势与不足的分析”,各子 AI 在自身上下文窗口内深耕细分任务后,将结果浓缩为精简报告提交至主 AI,由主 AI 完成最终整合,可避免主智能体陷入细节事务,大幅提升整体任务效率。

四、写在最后

Anthropic 对上下文工程的解读,本质是重塑人与 AI 的协作关系,不再将 AI 视为 “无所不能的机器”,而是当作 “存在注意力极限的队友”。

随着大语言模型(LLM)能力不断增强,应用构建的挑战已发生本质转变:过去聚焦 “如何写好提示词”,如今更侧重 “如何在每一步精准策划进入模型的信息”。无论是为长时程任务设计上下文压缩方案、开发高效工具,还是让 AI “即时检索” 环境信息,其核心是希望以最低信息成本实现最优任务结果。

最后

为什么要学AI大模型

当下,⼈⼯智能市场迎来了爆发期,并逐渐进⼊以⼈⼯通⽤智能(AGI)为主导的新时代。企业纷纷官宣“ AI+ ”战略,为新兴技术⼈才创造丰富的就业机会,⼈才缺⼝将达 400 万!

DeepSeek问世以来,生成式AI和大模型技术爆发式增长,让很多岗位重新成了炙手可热的新星,岗位薪资远超很多后端岗位,在程序员中稳居前列。

与此同时AI与各行各业深度融合,飞速发展,成为炙手可热的新风口,企业非常需要了解AI、懂AI、会用AI的员工,纷纷开出高薪招聘AI大模型相关岗位。

最近很多程序员朋友都已经学习或者准备学习 AI 大模型,后台也经常会有小伙伴咨询学习路线和学习资料,我特别拜托北京清华大学学士和美国加州理工学院博士学位的鲁为民老师给大家这里给大家准备了一份涵盖了AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频 全系列的学习资料,这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AI大模型系统学习路线

在面对AI大模型开发领域的复杂与深入,精准学习显得尤为重要。一份系统的技术路线图,不仅能够帮助开发者清晰地了解从入门到精通所需掌握的知识点,还能提供一条高效、有序的学习路径。

但知道是一回事,做又是另一回事,初学者最常遇到的问题主要是理论知识缺乏、资源和工具的限制、模型理解和调试的复杂性,在这基础上,找到高质量的学习资源,不浪费时间、不走弯路,又是重中之重。

AI大模型入门到实战的视频教程+项目包

看视频学习是一种高效、直观、灵活且富有吸引力的学习方式,可以更直观地展示过程,能有效提升学习兴趣和理解力,是现在获取知识的重要途径

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

海量AI大模型必读的经典书籍(PDF)

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

600+AI大模型报告(实时更新)

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

AI大模型面试真题+答案解析

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献64条内容

已为社区贡献64条内容

所有评论(0)