简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

8.1k 的 fork 说明这个项目不仅受欢迎,还能真正落地解决问题,比如开源框架、通用工具、核心组件这类 “能直接用、能改” 的项目才会有这么高的 fork。GitHub 上的项目量级没有官方分级,但行业内有通用的参考维度,你的这个项目属于S 级(顶级),

随着技术的发展,现代的时序数据库不仅继承了早期时序数据库的优点,还引入了更高级的数据处理能力、高效的压缩算法和符合时序特征的存储引擎。这里,“temperature”是度量值的名称,`1633036800`是Unix时间戳(代表特定的日期和时间),`22.5`是温度值,`location=living_room`和`device_id=A123`是标签,提供了设备的额外信息。现代时序数据库的发展和

Docker:docker国内镜像加速创建或修改 /etc/docker/daemon.json 文件,修改为如下形式{"registry-mirrors": ["https://registry.docker-cn.com","http://hub-mirror.c.163.com","https://docker.mirrors.ustc.edu.cn"]}方法一:Docker中国区官方镜像h

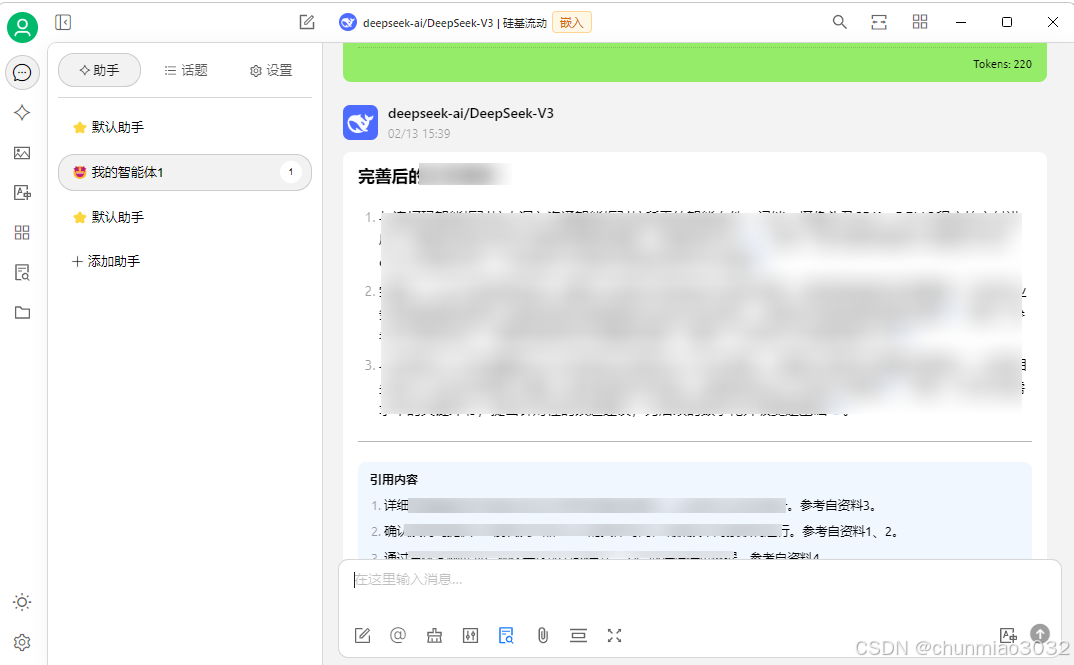

如果你需要一个功能丰富、支持多种模型和AI助手的工具,Cherry Studio 是一个不错的选择。而如果你更关注文档知识库管理和多用户协作,AnythingLLM 可能更适合你的需求。如果你需要一个功能丰富、回答全面且支持多种模型和文档处理的工具,是一个更好的选择。如果你更关注知识库的管理和文档检索功能,且需要支持多用户和权限管理,可能更适合你的需求。

需要部署大模型和嵌入模型(太要求电脑配置了,配置差的最好不要尝试,我i5,16G内存,固态硬盘,集成显卡,deepseek根本跑不起来,llama3勉强能跑起来,但是超级慢,嵌入模型nomic-embed-text:latest跑起来后,向量化个几k的文本文件用了几分钟)安装ollama启动ollama启动后,Ollama会在默认端口11434上运行。你可以通过浏览器访问拉取llama3模型运行模

然后,人们将种子种在土壤里,并定期给它浇水、施肥(这就是模型训练的过程,计算机会根据我们给定的指令自动进行)。最后,人们要观察树的生长情况,看看它是否健康,是否有病虫害,是否需要修剪(这就是模型的评估和调优过程,人们需要根据模型的表现来决定是否需要调整模型的参数或结构)。如果模型的预测结果不好,就像小孩子答错了问题,那么我们就需要调整模型的参数(改变学习策略),让它在下一次预测时能够做得更好。人们

执行了tool_call后,将获取内容放到message中,再将message提交给大模型进行第二次交互,role是assistant,content是回答的内容,tool_calls是空的了。可以看出,第一次和大模型交互时,大模型返回的role是assistant,content是空的,tool_calls是有内容的。assistant[content]: 拥有最多曲目的专辑名字是《Greate

如果你需要一个功能丰富、支持多种模型和AI助手的工具,Cherry Studio 是一个不错的选择。而如果你更关注文档知识库管理和多用户协作,AnythingLLM 可能更适合你的需求。如果你需要一个功能丰富、回答全面且支持多种模型和文档处理的工具,是一个更好的选择。如果你更关注知识库的管理和文档检索功能,且需要支持多用户和权限管理,可能更适合你的需求。

本文用程序员熟悉的类比方式,通俗解释了Agent开发中的核心概念:Agent相当于具备自主决策能力的业务类,而Skill则是其中的原子方法。Skill具有即插即用、单一职责、参数明确三大特点,可以像搭积木一样组合使用。文章还厘清了Agent、Skill和工作流的关系:工作流负责组织Skill的执行顺序,就像业务逻辑方法调用子方法一样。最后指出常见误区,强调Skill不可再拆分,且Agent能自动触

分布式ID生成方案详解分库分表场景下,传统自增ID会导致不同库/表的ID重复,需要分布式ID生成方案解决以下核心需求:•全局唯一性:跨数据库/表的ID不重复•有序性:利于索引优化和范围查询•高性能:满足高并发场景需求•高可用:避免单点故障•可扩展性:支持业务扩容。