简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

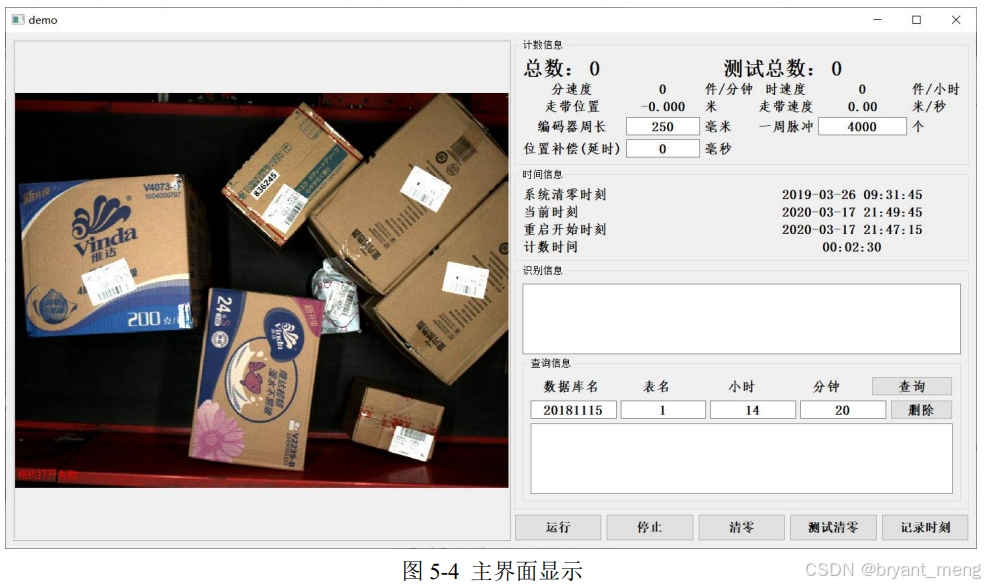

1]罗建坤.基于深度学习的包裹检测追踪计数系统的研究设计[D].华南理工大学,2020.DOI:10.27151/d.cnki.ghnlu.2020.001129.

汇总整理摘抄自相机标定:从世界坐标系到图像像素坐标系转换过程解析四大坐标系与内外参世界坐标系、相机坐标系、图像坐标系之间的关系世界坐标系,相机坐标系,图像坐标系,像素坐标系相机模型 + 世界坐标系+相机坐标系+图像坐标系相机模型中的世界坐标系究竟指什么?老司机帮忙解释下摄像头的世界坐标系?像素坐标系到世界坐标系的转换【相机标定02】从世界坐标系到像素坐标系文章目录1 坐标系简介2 图像物理坐标系与

北京时间周四晚19:58,这位“北极星黎明”任务的指挥官、41岁的亿万富翁打开舱口,率先走出太空舱,通过“天行者”梯子,以及一根约3.7米长的系绳,在舱外呆了10多分钟。具体来说,平台不仅提供99%的业界SOTA开源大语言模型、开源多模态模型,并且均已针对昇腾算子、显存优化,预置最优超参配置,做到“模型全、免配置、免调优、性能优”。针对更深入的模型定制需求,平台也提供了包括模型调优、模型压缩、模型

第一行是自己虚拟环境的 lib,eg 虚拟环境是 name 是。是存在的,而在自己的 anaconda 虚拟环境中不存在。解决思路,在自己的虚拟环境中 ln 软连接相关库。版本来建立软连接,比如你的版本是。最后一行根据你虚拟环境中存在的。,那么最后一行的指令应该是。

源码:https://github.com/soimort/you-get用户庞大呀。

更多有趣的代码示例,可参考。

图片来自于 midjourney。

变量类型、变量名称、变量值和变量地址[存储类型] type variable_name [= initial_value];存储类型即为autoregiesterstaticextern之一,缺省时,编译器将根据对该变量的作用域,为该变量指定相应的存储类型type:这是变量的数据类型,它决定了变量可以存储什么类型的数据。例如,int 表示整数,float 表示浮点数,char 表示字符,等等。va

fseek👉 跳位置:灵活定位文件指针,支持随机访问(如跳过模型元数据)。fread👉 读数据:高效读取二进制数据,需注意返回值和缓冲区管理。ftell👉 查位置:获取当前指针位置,便于调试或分块处理。优化建议大文件优先使用mmap或fseekoftello。嵌入式场景中,结合fseek和块读取减少I/O次数。始终检查函数返回值以确保鲁棒性。在很多推理框架(比如 TensorRT / TFL

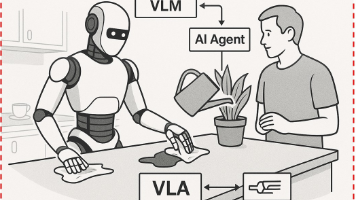

世界模型是智能体(Agent)内部对环境动态(dynamics)的可学习、可推理的内部表征或模拟器。它能预测“如果我执行某个动作,环境会如何变化”。VLA 模型是一种端到端的策略网络,直接将视觉观测 + 自然语言指令 映射为机器人动作。。概念角色类比世界模型智能体的“想象力”和“物理直觉”大脑中的模拟器VLA智能体的“语言理解+反射动作”听到指令立刻伸手RL智能体的“实践经验”通过摔跤学会平衡未来