简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

root@kfk12 ~]# ssh-copy-id 192.168.6.12 #把公钥写到本机/root/ .ssh/authorized_keys文件中。[root@kfk12 ~]# scp /root/.ssh/id_rsa 192.168.6.13:`pwd` #将私钥放主空端主机root目录。[root@kfk12 ~]# cat /root/.ssh/id_rsa #查看私钥。[ro

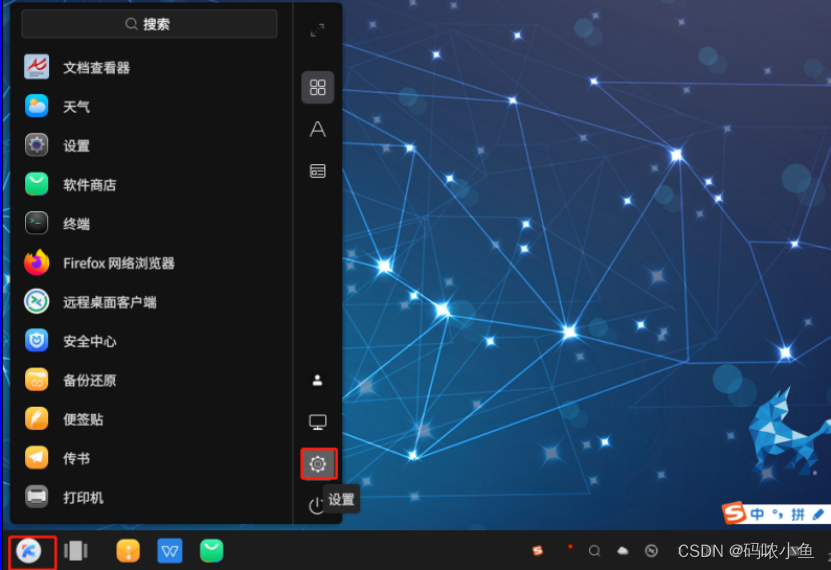

1、 银河麒麟桌面开启自带远程桌面11.1开始—设置11.2进入系统设置11.3开启”远程桌面”,设置连接密码21.4 确认服务端口22、 远程连接银河麒麟桌面22.1 Windows使用tightvnc工具连接22.1.1打开VNC工具,输入IP:端口号32.1.2输入VNC密码,点ok32.2银河麒麟远程连接32.2.1开始—远程桌面客户端(也可连接windows)42.2.2新建连接—选择V

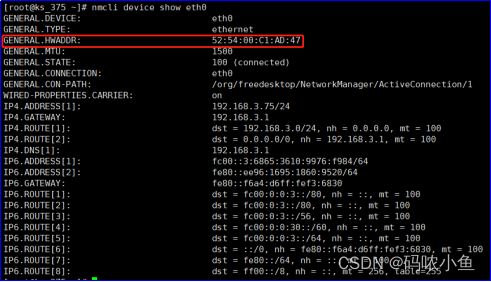

目录1、 ifconfig命令查看网卡MAC地址11.1 通过HWaddr或ether字段过滤mac地址11.2 提取指定网卡mac地址12、 通/sys/class/net/xxx/address查看13、 ip命令查看网卡MAC地址14、 nmcli命令查看网卡MAC地址2

1、 搜索镜像12、 下载ubuntu系统镜像(容器架构与宿主机相同)13、 查看镜像支持的架构14、 启动ubuntu容器1

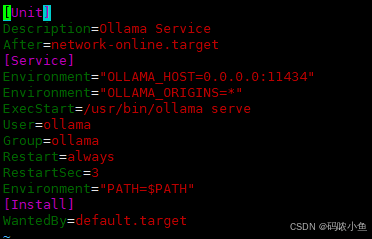

登录ollama下载网站https://ollama.com/download/linux,linux下有下载脚本。# ollama run deepseek-r1:1.5b需要联网情况,下载完成后,就可以对话了。其他的模型下载也是一样的,可以在这里找到,点进去后直接这里选择你要下载的模型,然后复制即可。如果需要Web或者客户端支持,可以查看GitHub里的推荐。正常来说,在OS系统下直接执行脚本

解释:最大模型数,同时可以加载最多几个模型(我三张显卡的情况 llama3 70B,和一个27B并行建议1-2)解释:模型加载后保留的时间,超过1小时,就卸载了,就要从新加载模型。解释:指定运行服务的用户,服务将以 ollama 用户的身份运行。解释:指定运行服务的用户组,服务将属于 ollama 用户组。解释:调用分散模式多显卡的情况处理多并发的情况下可以减少时间。解释:在多张显卡的情况下只用显

KVM性能优化之内存优化(宿主机)

举例:强制修改网卡速率为100M,autoneg off 需要同步设置,如果是on的话就是自适应配置,自动根据机器等进行配置。设置网口速率10/100/1000M、设置网口半/全双工、设置网口是否自协商。方法2、将ethtool设置写入/etc/rc.d/rc.local之中。如:将eth0设备设置为全双工自适应,速度为100Mbs。方法1、配置信息写入网卡中 ifcfg-eth0。ifcfg-e

sshpass -p {密码} scp -P {端口} {用户名}@{主机IP}:{远程主机目录} {本地主机目录}sshpass -p {密码} scp -r {本地主机目录} {用户名}@{主机IP}:{远程主机目录}sshpass -p {密码} scp {用户名}@{主机IP}:{远程主机目录} {本地主机目录}sshpass -p {密码} scp {本地主机文件} {用户名}@{主机I

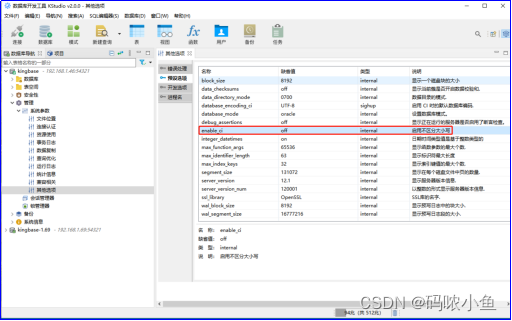

人大金仓数据库查看是否大小写敏感,on表示大小敏感,off表示大小写不敏感,使用某些项目的时候,需要设置数据库大小写不敏感,人金仓数据库在安装数据库如果在安装时设置大小写敏感,是无法直接通配置重新设置大小写不敏感的。