简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

如果是为了方便简洁,实际使用完全够了,之前也写过使用Obsidian写文章的教程. 这次主要介绍使用在本地vscode加上插件写论文.

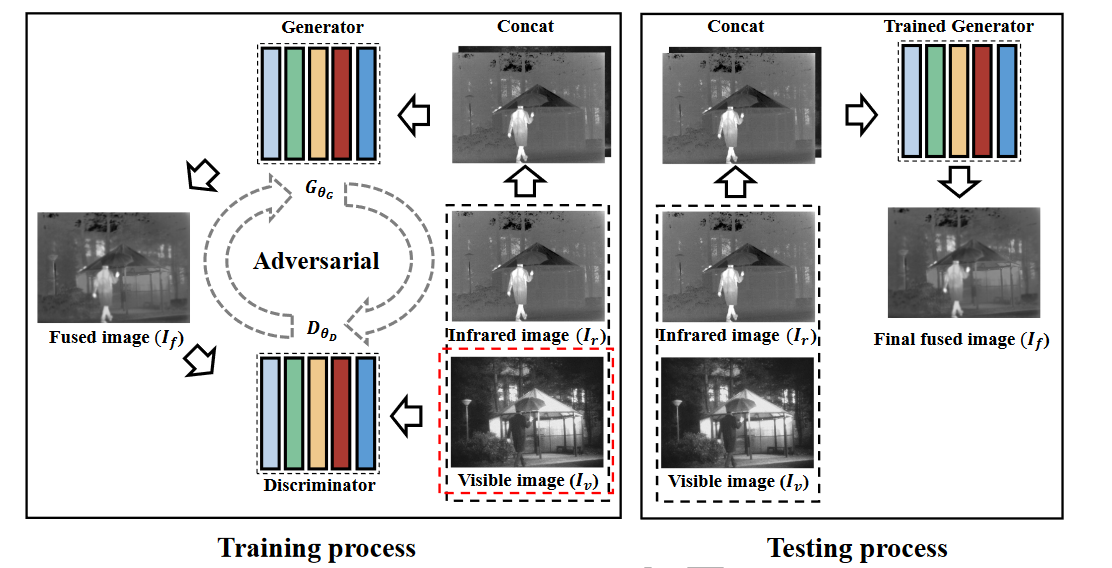

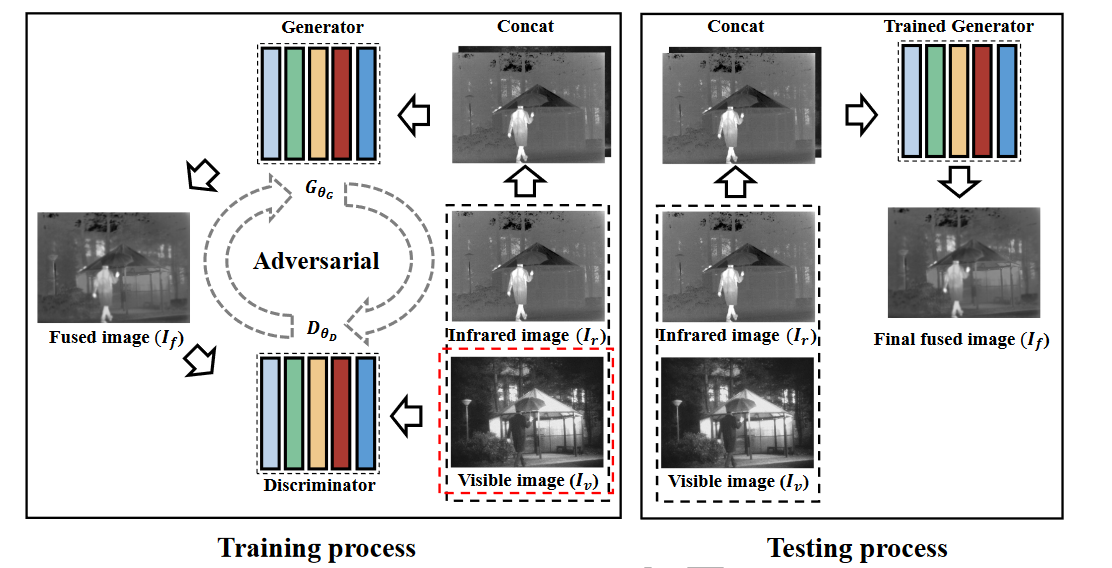

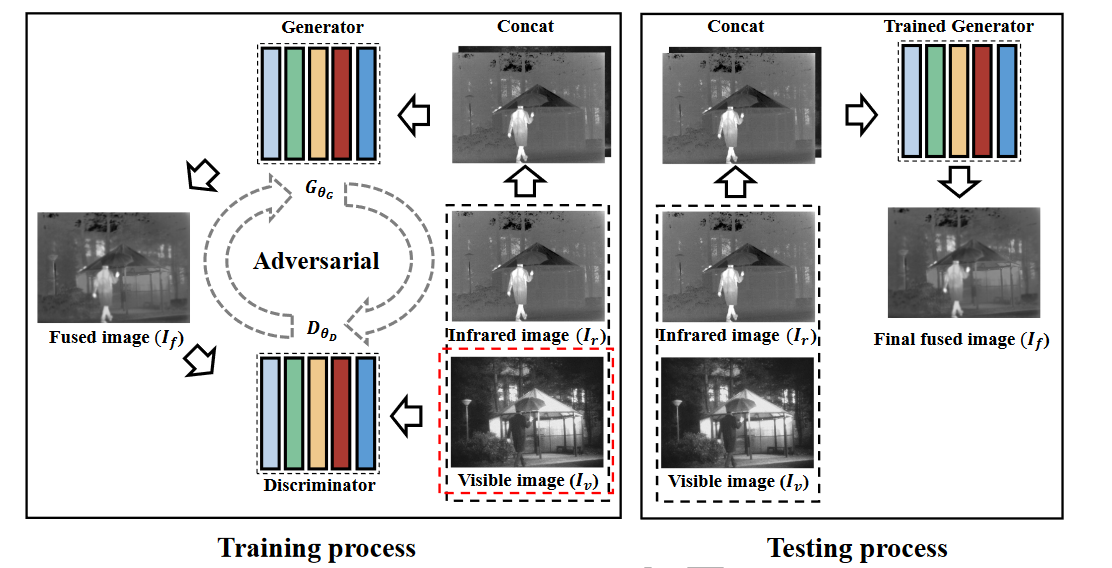

介绍图像融合概念,回顾sota模型,其中包括数字摄像图像融合,多模态图像融合,接着评估一些代表方法介绍一些常见应用,比如RGBT目标跟踪,医学图像检查,遥感监测。

不得不说,civitai已经成为这方面的github和huggingface了.

如果是为了方便简洁,实际使用完全够了,之前也写过使用Obsidian写文章的教程. 这次主要介绍使用在本地vscode加上插件写论文.

介绍图像融合概念,回顾sota模型,其中包括数字摄像图像融合,多模态图像融合,接着评估一些代表方法介绍一些常见应用,比如RGBT目标跟踪,医学图像检查,遥感监测。

现有的度量方式有很多,但我们主要关心的是尽量减少必须发送的信息量。这两个模型都将我们的问题简化为两个参数,牙齿数和概率(尽管我们实际上只需要均匀分布的齿数)。信息的最佳编码是一个非常有趣的话题,但对于理解KL分歧来说并不是必要的。将KL散度视为距离度量可能很诱人,但我们不能使用KL散度来测量两个分布之间的距离。这是因为KL散度不是对称的。熵的关键在于,只要知道我们需要的比特数的理论下限,我们就可以

最近在看LLM的流式输出如何反映到json输出上,现有的解决方案包括 WebSocket 或 Server-Sent Events (SSE) 实时通信技术.

之前讲了stable diffusion webui搭建,这里主要介绍使用方法以及模型,扩展等.使用NovelAI,lora模型

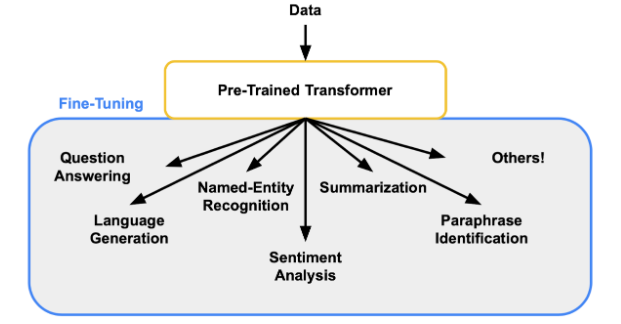

LLM是大型语言模型的缩写,是人工智能和机器学习领域的最新创新。2022年12月,随着ChatGPT的发布,这种强大的新型人工智能在网上疯传。对于那些足够开明的人来说,生活在人工智能的嗡嗡声和科技新闻周期之外,ChatGPT是一个在名为GPT-3的LLM上运行的聊天界面。最近的大模型就是Meta的llama2当然还有openai的GPT4,google的PaLM2.国内有清华的ChatGLM等等.

介绍图像融合概念,回顾sota模型,其中包括数字摄像图像融合,多模态图像融合,接着评估一些代表方法介绍一些常见应用,比如RGBT目标跟踪,医学图像检查,遥感监测。