简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文给出了AI知识库和Agent智能体在各个行业的应用场景,并详细演示了DeepSeek+RAGFlow的私有化部署过程、总体架构、知识库和Agent智能体搭建、核心模块代码等细节,以及如何完美实现知识图谱和低代码开发。

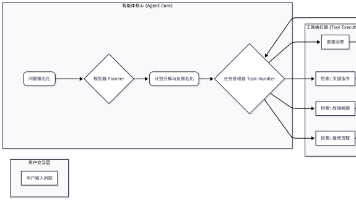

本文详细介绍了如何构建生产级智能体驱动RAG系统,以工业设备维修手册为例,展示了从数据预处理(多策略分块、清洗、摘要生成)到核心流程构建(智能体规划、检索与蒸馏、思维链推理)的全过程。系统通过LangGraph实现规划与反思能力,结合RAGAS进行量化评估,形成能处理复杂问题、抑制幻觉的高效知识问答系统,为开发者提供从原型到生产级系统的完整实践路径。

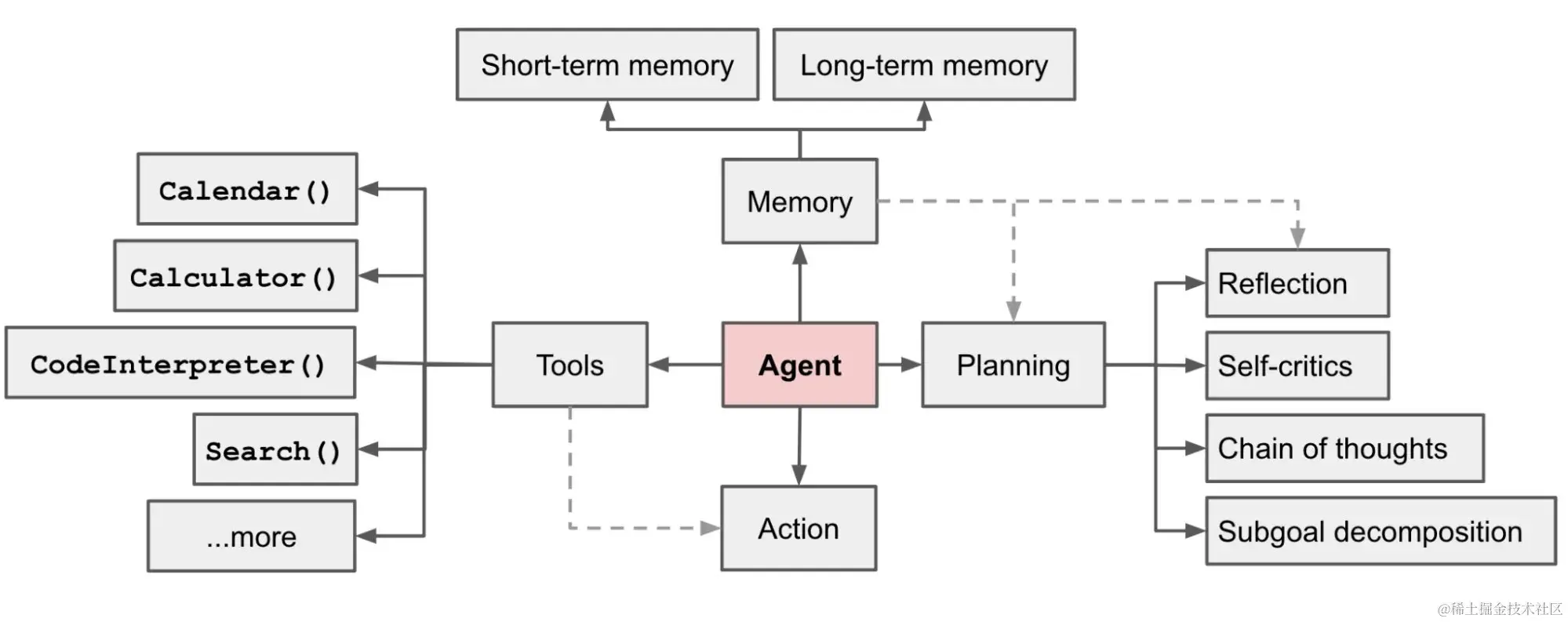

大模型应用开发理论简单但实践困难。RAG系统需平衡数据召回的广度与精准度,同时应对数据量增长带来的速度挑战。智能体系统的核心是模型推理与工具调用能力,可通过ReAct模式激发逻辑思维和纠错能力。大模型应用入门容易,但要做好需要深厚的技术、架构和工程化支持。

在智能体构建和工作流等模型应用编排平台中,dify,ragflow、n8n和目前开源的Coze这几个工具各有其优势。但是,在实际使用中,为了追求更符合个人或者单位要求的效果,通常会将这些工具或者平台的优势集成起来,以便充分发挥各自的优势,今天这篇文章,就是在主要使用Dify的基础上,集成RAGFlow的知识召回能力,从而实现更可靠的知识检索能力。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!😝有需要的小伙伴,可以保存图片到。

当我们谈论未来,我们谈论的是变革。在这个由数据编织的新时代,"人工智能+"不仅是一种技术融合的宣言,它更是一场无声的革命,悄然引领着全球产业的转型升级。从灯火通明的都市到遥远的田野,从精密运转的工厂到温馨的家庭,AI的触角正延伸至生活的每一个角落。本文将带您领略"人工智能+"在各行业中的创新应用场景,揭示它如何以创新的力量,点亮智慧的火花,推动社会向前发展,为我们描绘出一个更加智能、高效、绿色的未

在这个快速变化的技术时代,人工智能(AI)正逐渐成为科技发展的新引擎。对于许多Java程序员来说,转行AI不仅意味着职业发展的新机遇,更是对个人技能和认知的一次重大挑战。本文将探讨Java程序员转行AI的原因、面临的挑战、学习路径,并通过成功案例为这一跨界之旅提供启示。一、转行的原因技术发展的趋势随着大数据、云计算和物联网的兴起,AI技术的应用越来越广泛。从自动驾驶到智能医疗,从金融科技到智能制造

在这个科技飞速发展的时代,技术的更新换代犹如潮水般汹涌。作为一名有着5年Java开发经验的程序员,我意识到自己需要适应这种变化,寻找新的职业增长点。随着人工智能(AI)和机器学习领域的迅猛发展,以及AI大模型在各个行业应用的不断扩展,我看到了这个领域蕴藏的巨大潜力和机会。因此,在2024年的春天,我决定转行进入AI大模型领域,开启一段全新的旅程。

本文为初学者提供了大模型学习的详细路线图和推荐书籍,帮助从零基础快速入门。文章首先介绍了大模型在人工智能领域的重要性,随后列出了学习大模型的五个关键步骤,并推荐了五本相关书籍,包括《Python编程:从入门到实践》、《深度学习数学基础》、《机器学习实战》、《深度学习》和《大模型应用开发极简入门:基于GPT-4和ChatGPT》。此外,文章还提供了大模型实战案例、视频和PDF合集等资源,帮助学习者全

Agent,我们一般将其翻译为代理人代理商等。在人工智能领域,Agent 通常被定义为一种具有感知能力的实体,它能够通过对其所处环境的观察来做出相应的决策和反应。这种 Agent 既可以是软件形式的程序,例如对话机器人,也可以具备物理形态,比如扫地机器人在了解 AI Agent 之前,我们先考虑一个场景:我们要写一本 20 万字的关于人工智能最新技术的书在没有大模型之前,我们一般会按照如下流程第一