简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

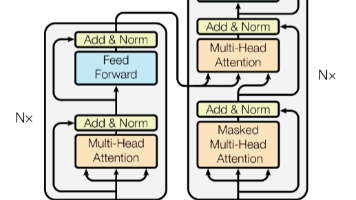

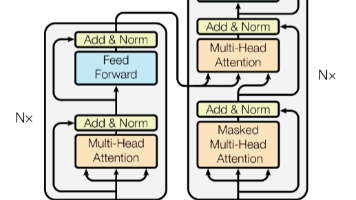

本文系统介绍了神经网络与Transformer的工作原理及其训练过程。首先解释了神经元的基本概念和人工神经网络的结构,通过买肉案例形象说明神经元计算过程。然后详细阐述了神经网络的训练机制、循环神经网络(RNN)的特点及其局限性。重点解析了Transformer的核心模块——多头自注意力机制,通过圆桌会议的比喻生动说明了其工作原理。文章还完整介绍了大语言模型训练的四个关键阶段:预训练、监督微调、奖励

本文系统介绍了神经网络与Transformer的工作原理及其训练过程。首先解释了神经元的基本概念和人工神经网络的结构,通过买肉案例形象说明神经元计算过程。然后详细阐述了神经网络的训练机制、循环神经网络(RNN)的特点及其局限性。重点解析了Transformer的核心模块——多头自注意力机制,通过圆桌会议的比喻生动说明了其工作原理。文章还完整介绍了大语言模型训练的四个关键阶段:预训练、监督微调、奖励

摘要:本文介绍了10个GitHub上热门的开源检索增强生成(RAG)框架,包括Haystack、RAGFlow、txtai等,分析了它们的特点和应用场景。RAG技术通过整合外部知识源增强大语言模型能力,能提供更准确及时的响应。文章对比了RAG与LangChain的区别,强调RAG在定制化、准确性方面的优势,并详细梳理了各框架的核心功能、适用场景和优缺点,为开发者选择合适框架提供参考。

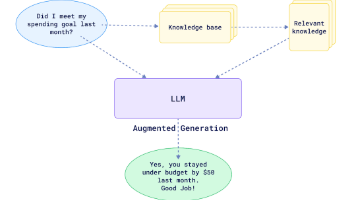

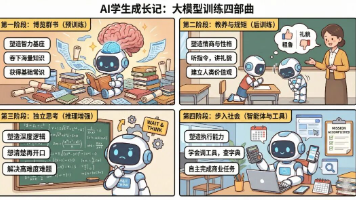

本文通过天才学生的比喻生动阐释了大模型训练的四个关键阶段:1)预训练阶段(博览群书)通过Transformer等架构让模型掌握基础知识和逻辑;2)后训练与对齐阶段(规矩养成)利用SFT、RLHF等技术培养模型的对话能力和价值观;3)推理增强阶段(思维深度)采用CoT、ToT等方法提升模型解决复杂问题的能力;4)智能体阶段(实习干活)通过工具调用、RAG等技术赋予模型执行实际任务的能力。这种分阶段训

摘要: Manus是一款开源行动型AI助手,能自主拆解任务、调用工具并执行完整流程,实现从顾问到数字员工的升级。与ChatGPT不同,Manus能主动完成多步骤任务(如市场调研、文档整理、网页操作等),并具备试错修正能力。其核心价值在于将AI角色从辅助思考转变为替代执行,释放用户精力专注于决策判断。实际应用中,Manus擅长处理重复性工作(资料整理、初稿生成等),但方向选择、价值判断仍需人类主导。

本文系统介绍了神经网络与Transformer的工作原理及其训练过程。首先解释了神经元的基本概念和人工神经网络的结构,通过买肉案例形象说明神经元计算过程。然后详细阐述了神经网络的训练机制、循环神经网络(RNN)的特点及其局限性。重点解析了Transformer的核心模块——多头自注意力机制,通过圆桌会议的比喻生动说明了其工作原理。文章还完整介绍了大语言模型训练的四个关键阶段:预训练、监督微调、奖励

高质量提示词是解锁AI潜力的关键。本文介绍了六大提示词优化框架:1. STAR法则(情景-任务-行动-结果)使问题结构化;2. 5W2H分析法确保全面提问;3. CO-STAR框架(上下文-目标-风格-语气-受众-回复)精准控制输出;4. CRISPE框架激发跨学科创意;5. BROKE框架(背景-角色-目标-关键结果-优化)实现量化目标;6. 借助AI自身优化提示词。每个框架均配有具体应用场景示

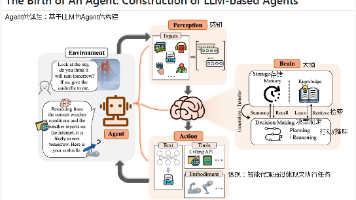

本文探讨了大语言模型(LLM)的演进及其两种主要应用形态:普通LLM智能体和具身智能(Agentic AI)。普通LLM智能体以被动响应方式运行,擅长语言处理和知识检索,如企业智能客服系统。而具身智能则具备主动规划、环境感知和自我学习能力,如小鹏汽车的智能驾驶系统。文章指出,具身智能的发展是迈向通用人工智能(AGI)的关键,它赋予了AI系统目标理解、自主决策和环境适应等更接近人类智能的特征。通过对

本文探讨了从通用AI模型向专业领域AI模型的发展趋势,特别聚焦设计领域。文章分析了隐性知识在设计中的重要性及其特征(隐含性、情境特定性等),提出了通过定性研究和AI交互记录法提取隐性知识的方法。重点阐述了如何将设计师行为转化为知识向量,并构建能够理解设计意图、生成连贯行动序列的智能体。文章还讨论了模型训练策略(LoRA、RLHF等)及当前面临的挑战,如知识提取完整性和智能体泛化能力。最后指出,通过

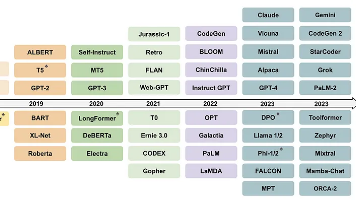

本文系统介绍了大语言模型(LLM)的关键技术。首先阐述了LLM的基本概念和Transformer架构原理,包括编码器-解码器结构和自注意力机制。接着详细讲解了语言建模的发展历程,从n-gram到神经语言模型的演进。在模型训练方面,重点分析了预训练的计算挑战、分布式训练方法(DDP和FSDP)以及微调技术,特别是参数高效微调(PEFT)方法如LoRA、QLoRA和适配器等。此外,还探讨了提示工程策略