简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

生图模型的竞争早已走过“听得懂、画得美”的感知阶段——画质、色彩、基础构图这些能力正快速趋同,成为行业标配。真正的模型能力分水岭,正在于T2I模型能否跨越到认知层面:理解人类创作任务背后的意图、调用自身领域知识,并进行逻辑推理,将抽象概念转化为具有专业价值的视觉表达。Qwen-Image-Bench揭示了一条清晰的进化路径:从模型“感知驱动”迈向“认知驱动”。顶尖模型需要理解人类创作需求,并调动自

更准确地说,是一整套围绕 Gemini 构建的 AI 系统:Gemini Flash、Gemini Omni、Gemini Audio、Nano Banana、Antigravity,以及 Gemini App、Gemini API、AI Studio、Android Studio、AI Mode、Gemini Enterprise 等入口。

更准确地说,是一整套围绕 Gemini 构建的 AI 系统:Gemini Flash、Gemini Omni、Gemini Audio、Nano Banana、Antigravity,以及 Gemini App、Gemini API、AI Studio、Android Studio、AI Mode、Gemini Enterprise 等入口。

更准确地说,是一整套围绕 Gemini 构建的 AI 系统:Gemini Flash、Gemini Omni、Gemini Audio、Nano Banana、Antigravity,以及 Gemini App、Gemini API、AI Studio、Android Studio、AI Mode、Gemini Enterprise 等入口。

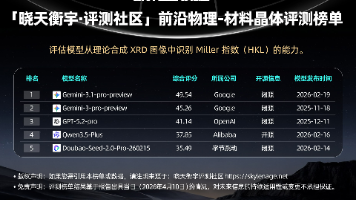

本榜单以CrystalXRD-Bench为核心评测基准,对7款全球顶尖大模型在前沿物理方面的相关能力进行探索。CrystalXRD-Bench 是面向材料科学领域的 XRD 衍射图谱理解评测基准,评估模型从理论合成 XRD 图像中识别 Miller 指数(HKL)的能力。【查看完整榜单】👉🏻。

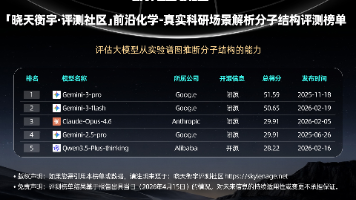

本榜单以MolQuest为核心评测基准,评估19款大模型从实验表征信息推断分子结构的能力。MolQuest是面向化学分子结构解析任务的动态推理能力评测基准,共包含 530 条分子结构解析评测任务,所有任务数据均提取自 2025 年以来发表的化学领域开源的高质量学术文献并经严格实验验证,采用模型抽取 + 专家双重校验的标准化流程完成构建。【查看完整榜单】👉🏻。

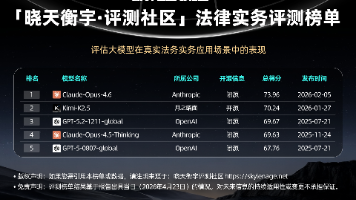

晓天衡宇CC-OCR V2该榜单以CC-OCR V2为评测基准,评估模型在多语言识别、文档解析、表格解析、公式识别、信息抽取等场景的综合OCR能力。法律实务:该榜单PLawBench为评测基准,对大模型在实际法律业务场景中的表现作出评测,主要覆盖用户理解、案例分析和文书生成三大方面,旨在评估大型语言模型(LLM)在法律实践中的表现。复杂指令遵循。

AI 狼人杀只是“辩论式评测”的破局起点,这套动态博弈的评测模式,可以无缝迁移到更多真实且复杂的商业与社会场景中,根据规划矩阵,过程透明化、能力多维化、错误可追溯。晓天衡宇AI狼人杀将会在未来尝试更多可能性:多样化游戏配置:支持不同人数、角色组合和规则变体(例如守卫、白痴、狼王),以观察大语言模型在不同信息不对称结构和游戏复杂度下的行为;人机混合对局:允许人类玩家与Agent共同参与,探索人类与大

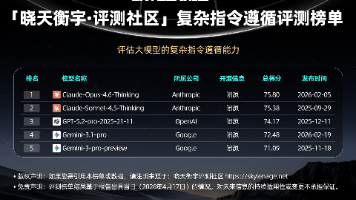

该榜单评测大模型复杂指令遵循能力,包含202道多约束指令题,覆盖文本处理、文本生成、角色扮演、语言理解、逻辑推理和问答六大任务类型。采用约束通过率和严格通过率ILA两种评测指标,并通过人机一致性验证确保评测可靠性。【查看完整榜单】👉🏻。

该榜单PLawBench为评测基准,对大模型在实际法律业务场景中的表现作出评测,主要覆盖用户理解、案例分析和文书生成三大方面。PLawBench旨在评估大型语言模型(LLM)在法律实践中的表现,包含三项法律任务:用户理解、案例分析和法律文书起草,涵盖了个人事务、婚姻与家庭法、知识产权以及刑事诉讼等广泛的现实法律领域。该基准旨在评估大语言模型处理实际法律任务的实践能力。【查看完整榜单】👉🏻。