简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在本周的学习中,对过拟合现象的出现以及解决方案进行了了解和理解,主要对L2正则化的实现方式及其效果进行了认识。同时,对于另一大类问题——分类问题的数学本质进行了推导和理解,回忆和联系了贝叶斯公式等知识, 对分类问题进行了初步了解,下周将进入逻辑回归章节的学习。

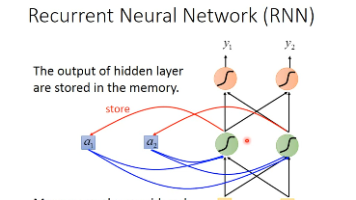

本周继续跟随李宏毅老师的课程进行学习,主要对循环神经网络和长短期记忆进行了解和学习,了解其底层逻辑以及具体数学实现。除此之外,还对其奏效的原因和底层逻辑进行了一定程度的认识。本周对循环神经网络和长短期记忆模块进行了一定的认识,学习了普通的循环神经网络如何让时间序列的前文影响后文,还了解了Elman Network、Jordan Network、双向RNN等几种变种。最后,还学习LSTM的数学表示和

本周的研究深入到了量子机器学习的前沿——辛量子神经网络。在 经典哈密顿神经网络如何通过辛结构保持能量守恒的基础上,本周探讨了如何将这一几何先验引入量子电路的设计中。SQNN 通过构建特殊的正交辛群量子门,确保了量子态演化过程中的辛形式不变性。这不仅解决了普通 QNN 在长时程预测中的发散问题,更为模拟复杂的量子多体系统提供了一种物理一致的架构。这种将物理对称性硬编码进网络结构的做法,被称为 Ind

本周对 LSTM模型利用PyTorch进行了复现,将其实现与数学形式进行了逐条对应,清晰、重点地理解门控机制与细胞状态与其在时序场景下的应用。在 2017 年 Transformer 架构(Attention 机制)横空出世之前,LSTM 曾是序列建模(NLP、语音、时序)的绝对王者。而在 2025 年的今天,它不再是唯一的 SOTA,但依然是非常棒的轻量级选择。本周阅读了一些时序预测领域的工作,

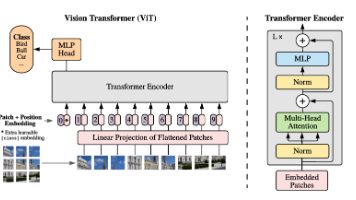

本周对经典的ViT论文进行了复现,对于其Patch Embedding的相关理念进行了较为深入的理解。通过利用上周编写的Transformer模块进行快速复现,提高复现效率并且深入理解了ViT对Transformer的应用以及异同。本周对ViT论文进行了快速复现,灵活运用了上周编写的Transformer代码,对Positional Encoding部分和EncoderLayer部分进行了复用,大

本周主要了解了多模态学习技术,通过对多模态数据融合的数学原理与其中注意力机制的应用,对多模态特征的处理方法有了基础的了解和认识。本周在比赛中初识了多模态类型的数据,利用这个机会较为初步的认识了多模态的数据的处理。在时序预测中,多模态数据的融合是一个潜力比较大且比较热门的领域,多模态数据的处理和融合策略极大的影响着模型对数据集的拟合能力。本周在了解了多模态底层原理的同时,较为简要的对其代码部分进行了

本周的研究重心从单体 Agent 的认知架构升级为多智能体系统 (Multi-Agent Systems, MAS) 的组织架构。结合最新的 OpenClaw 框架与学术界关于 MAS 设计模式的讨论,我们探索了如何通过角色分工与协作流程来自动化复杂的学术研究任务。单体 Agent 受限于上下文窗口和注意力分散,难以高质量完成“文献调研-论文撰写-同行评审”的全流程。

本周的研究重心从单体 Agent 的认知架构升级为多智能体系统 (Multi-Agent Systems, MAS) 的组织架构。结合最新的 OpenClaw 框架与学术界关于 MAS 设计模式的讨论,我们探索了如何通过角色分工与协作流程来自动化复杂的学术研究任务。单体 Agent 受限于上下文窗口和注意力分散,难以高质量完成“文献调研-论文撰写-同行评审”的全流程。

本周的研究深入到了量子机器学习的前沿——辛量子神经网络。在 经典哈密顿神经网络如何通过辛结构保持能量守恒的基础上,本周探讨了如何将这一几何先验引入量子电路的设计中。SQNN 通过构建特殊的正交辛群量子门,确保了量子态演化过程中的辛形式不变性。这不仅解决了普通 QNN 在长时程预测中的发散问题,更为模拟复杂的量子多体系统提供了一种物理一致的架构。这种将物理对称性硬编码进网络结构的做法,被称为 Ind

本周的继续研究物理驱动范式,PINN的核心机制,这是一种将物理定律直接编码进神经网络损失函数的技术,适用于数据稀缺但物理机理明确的环境流体或热力学场景。在此基础上,探讨了利用量子电路强大的表达能力来求解高维 PDE 的可能性。PINN 作为一种优雅的范式,体现了 AI 从归纳到遵循物理公式演绎的变化。Q-PINN 则展示了量子计算作为一种新型“函数拟合器”的潜力。虽然目前还未在工程上超越经典 PI