简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

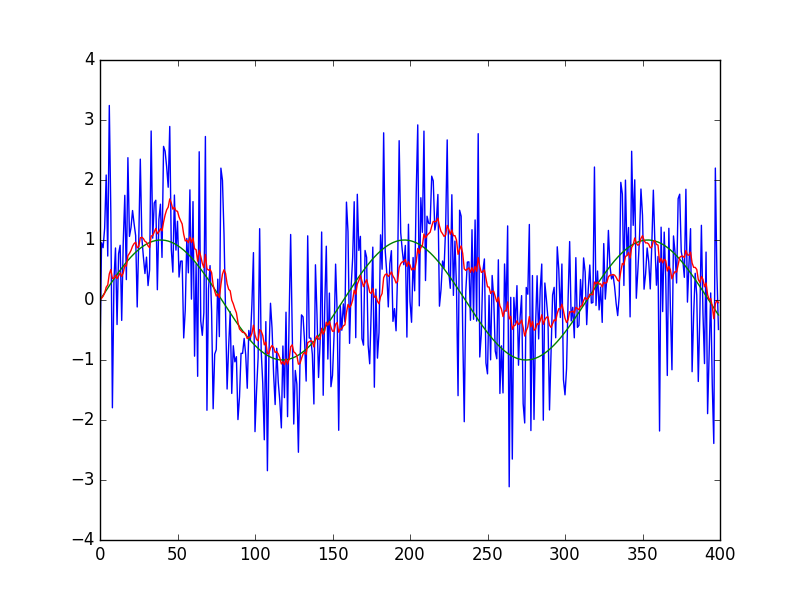

卡尔曼滤波与 DeepSORT 的结合,实现了动态目标跟踪中 “运动预测” 与 “外观识别” 的优势互补。卡尔曼滤波通过数学建模解决目标的动态估计问题,而 DeepSORT 通过深度学习增强外观特征的区分能力,两者共同推动了目标跟踪技术在复杂场景下的实用化。未来,随着边缘计算技术和轻量化模型的发展,这一组合将在更多实时跟踪场景中发挥关键作用。有以下论文写作问题的可以扫下方名片详聊前沿顶会、期刊论文

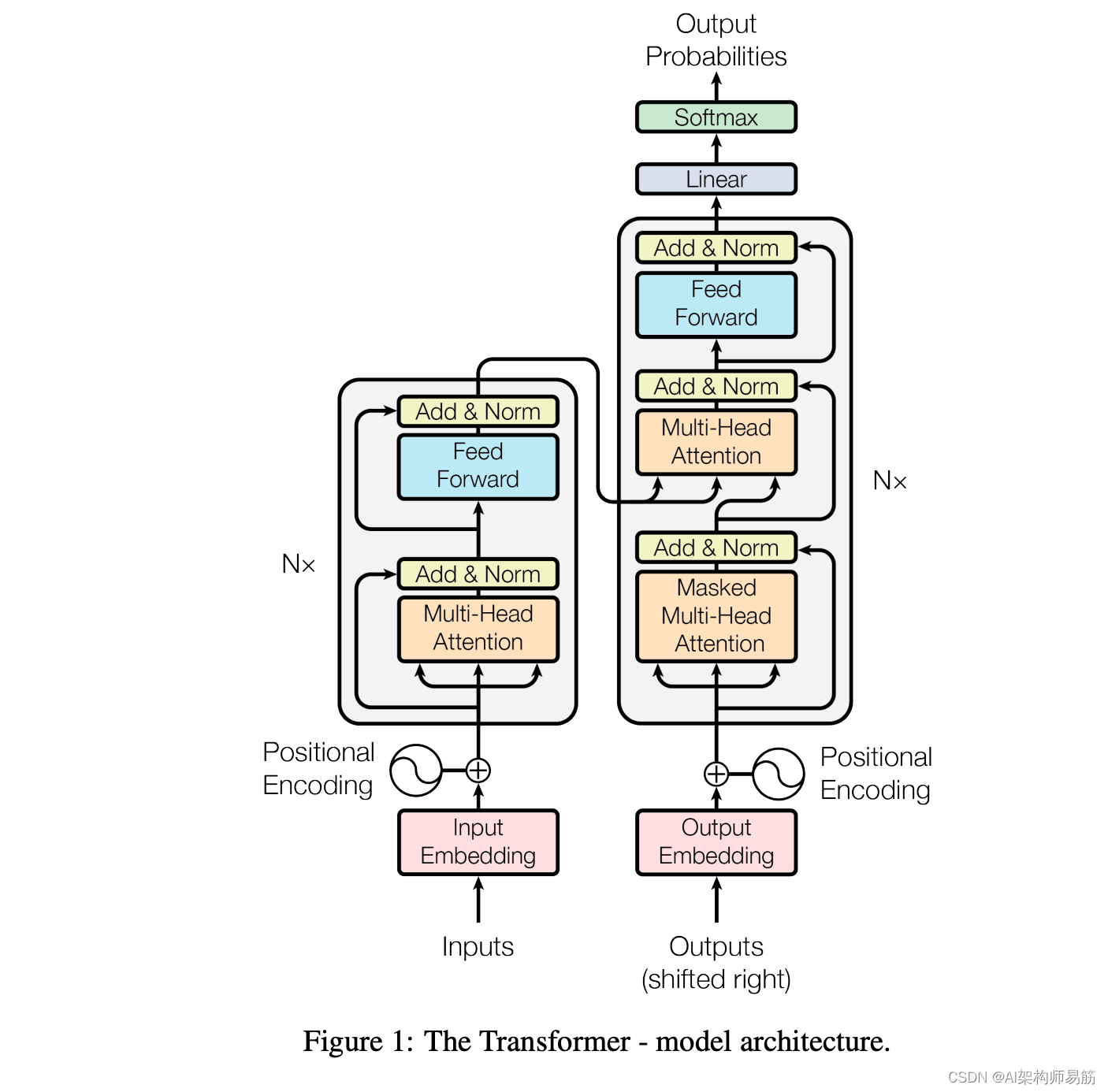

将编码器输出的全局语义信息与解码器当前生成的局部信息动态结合,实现了 “根据输入内容指导目标序列生成” 的核心逻辑。与解码器自注意力的输出结合(通过残差连接和层归一化),输入到前馈神经网络(FFN),生成下一个位置的隐藏状态。Q、K、V 均来自解码器当前层输入 ,作用是建模目标序列内部的依赖关系(如已生成词的顺序)Q 来自解码器自注意力,K、V 来自编码器输出,作用是建立目标序列与输入序列的跨模态

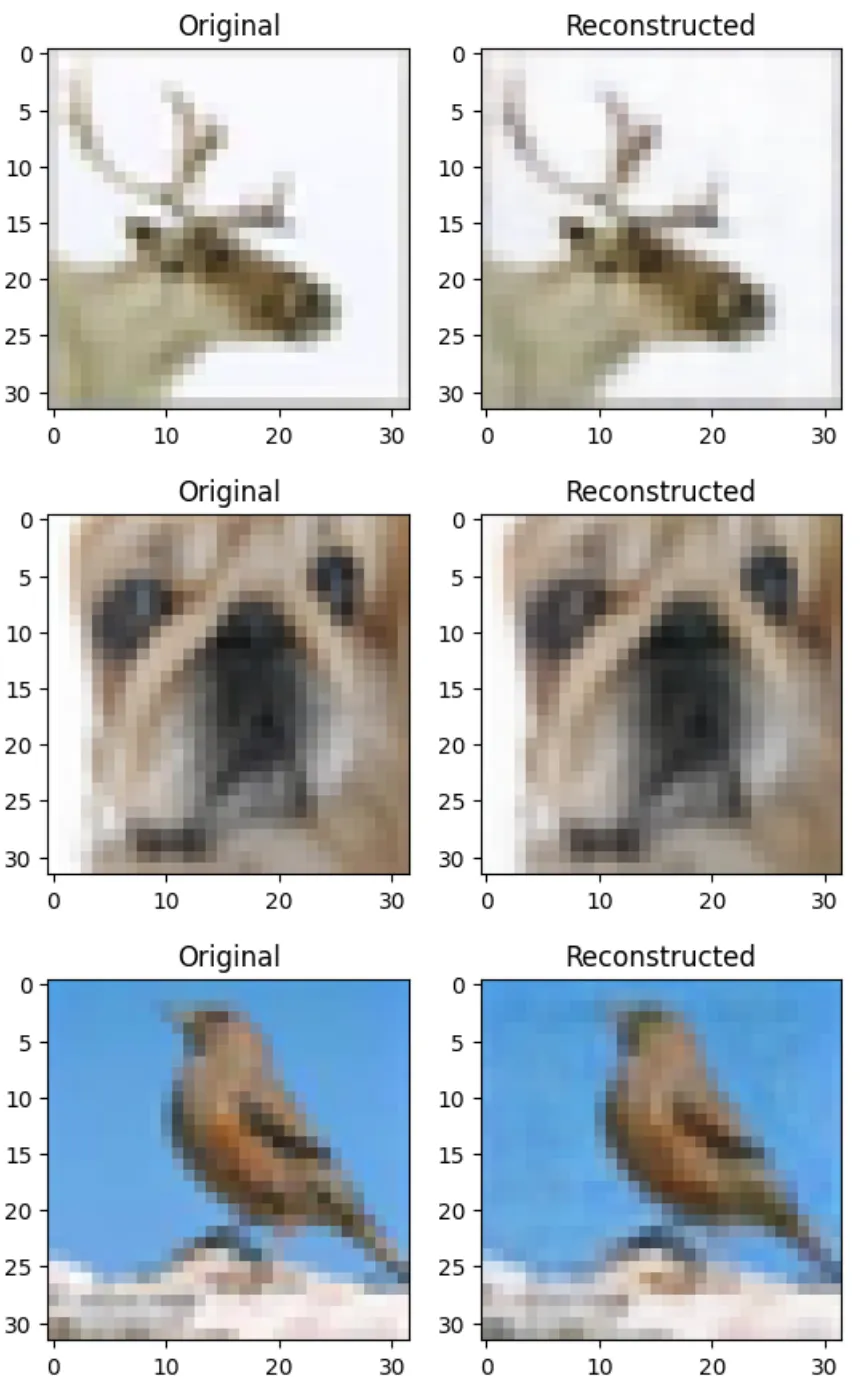

自动编码器是一类无监督神经网络,可以在低维空间(也称为潜在空间)中表示数据,以学习有效的表示。应用包括压缩、降噪、特征提取和生成模型。自动编码器的训练方式是:首先将数据编码到潜在空间中,然后将它们解码回原始表示形式,也称为重建,同时最大限度地减少原始输入和重建数据之间的差异。在扩展中,变分自动编码器(VAE) 学习潜在空间上的概率分布,这使它们能够生成全新的数据,同时牺牲了完美重建现有数据的能力。

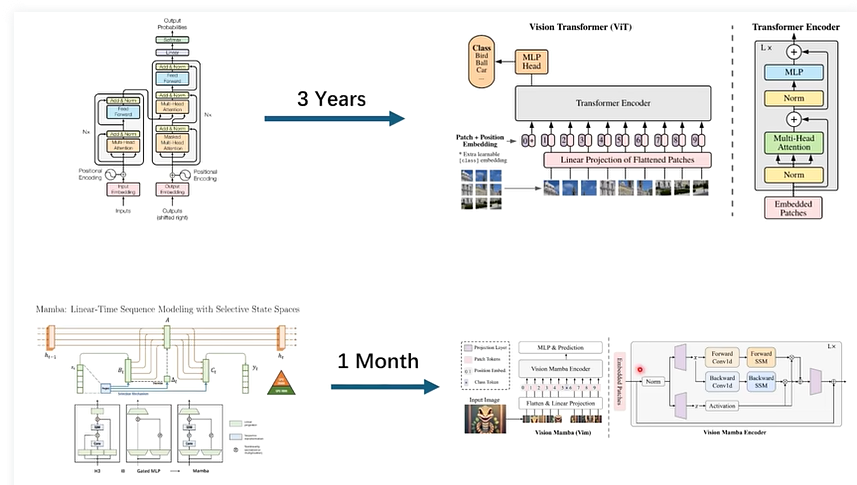

在深度学习的广阔宇宙中,Transformer 架构无疑是一颗耀眼的明星。它凭借其强大的并行计算能力和出色的序列建模能力,在自然语言处理、计算机视觉等众多领域取得了卓越的成就。今天,我们将一起探索如何使用 PyTorch 来实现 Transformer 架构,为你的深度学习之旅增添新的动力!2025年Transformer必学:从零详解VIT、DETR、Loftr、BEVFormer、Deform

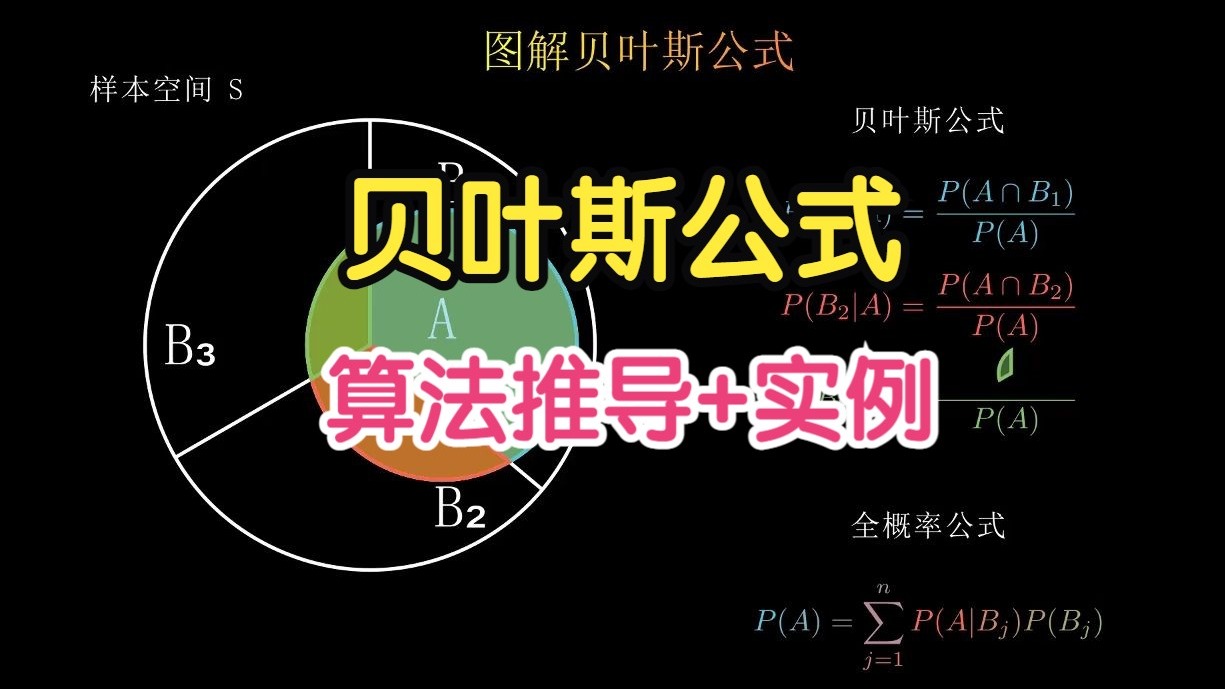

贝叶斯分析是一种基于概率论与统计学结合的推断方法,其核心是通过贝叶斯定理将先验知识与新证据结合,动态更新对事件概率的认知。以下从基本原理、应用领域及优缺点三个维度展开深度解析:【图解贝叶斯公式】1小时吃透大学四年没整明白的贝叶斯分析推导及垃圾邮件过滤实例(朴素贝叶斯/机器学习算法/MCMC算法/人工智能高数)

PyTorch是当前最受欢迎的深度学习框架之一,其动态计算图、直观的API设计和强大的GPU加速能力使其成为科研与工程领域的首选工具。以下从核心概念到实践应用的全方位解析将帮助你快速掌握PyTorch的核心技术。【转行分享】35+职场人破局AI领域,真的可行!详细图可关助我的V.X【服务号】AI技术星球 发送:211C 自取学习路线+200G资料包PyTorch的基础数据结构是多维数组张量,支持C

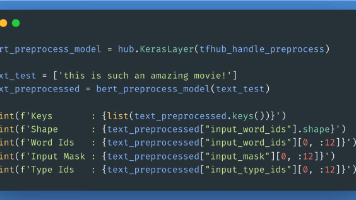

什么是自然语言处理 (NLP)?了解什么是自然语言处理 (NLP) 并发现其实际应用,使用 Google BERT 处理文本数据集。自然语言处理 (NLP) 通过使用机器学习来指示文本的结构和含义,从而改善了人类和计算机相互交流的方式。借助自然语言处理应用程序,组织可以通过分析文本和提取更有意义的信息来改善客户体验,从而提高工作效率并降低成本。读研期间如何快速入门NLP?博士花17小时精讲Tran

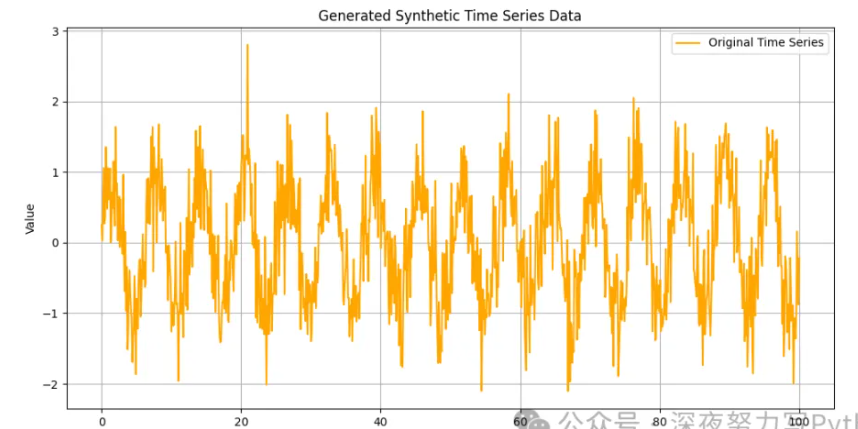

咱们今天和大家聊聊在机器学习和深度学习领域,(Random Forest)和(LSTM)各自在处理数据时具有独特的优势。那么,将两者结合可以发挥它们各自的优点,从而提升模型的性能~:随机森林能够通过集成多个决策树来提高泛化能力,减少过拟合。而LSTM擅长处理时间序列数据,通过在时间维度上捕捉长期依赖关系。将两者结合,可以利用随机森林的集成优势和LSTM的序列建模能力。:LSTM在时序数据中的表现非

本教程详细介绍了如何通过知识蒸馏技术将GPT-2模型压缩为更小的DistilGPT2模型。主要内容包括:1)建立训练环境并加载教师(GPT2)和学生(DistilGPT2)模型;2)实现数据预处理、标签平滑和自定义蒸馏损失函数;3)平衡教师知识(软标签)和真实标签(硬标签)的监督学习。教程提供了完整的Python实现代码,涵盖模型配置、训练循环、评估比较等关键步骤,最终生成可保存的轻量化模型。该方

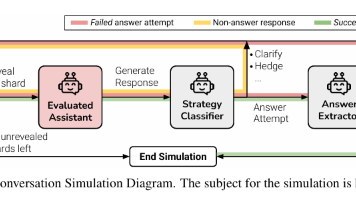

《多轮对话中大模型性能下降机制研究》摘要 本研究首次系统验证主流大模型在多轮欠指定对话中平均性能下降39%的现象。通过创新设计的分片模拟框架,将单轮完整指令拆解为多轮逐步披露的信息分片,在6类任务上对15个主流模型进行20万次实验。研究发现性能下降可分解为能力小幅降低(10%)和不可靠性大幅上升(29%)两部分,揭示模型一旦出错便难以修正的核心机制。研究提出标准化评估流程,通过可控实验证明多轮交互