简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

NVIDIA H200/H20 141GB 环境部署 DeepSeek-V4-Pro 的实践教程、压测性能表现,以及针对压测表现提供的稳定性配置建议。

在昇腾 910B 环境部署 DeepSeek-V4 的实践教程。

在昇腾 910B 环境部署 DeepSeek-V4 的实践教程。

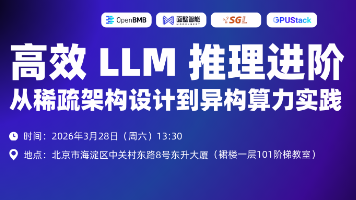

摘要:GPUStack、OpenBMB和SGLang社区联合举办线下Meetup,聚焦大模型部署中的异构GPU管理与推理效率优化等核心挑战。活动将分享下一代稀疏注意力系统设计、SGLang最新路线图、NVFP4混合精度量化等前沿实践,探讨构建企业级统一模型服务平台。会议旨在推动大模型落地与性能优化,欢迎AI基础设施领域的从业者参与交流。社区持续分享AI Infra相关部署经验与案例

通过 GPUStack 提供高效的模型部署与管理能力,并将模型接入 MaxKB,即可轻松构建具备知识库检索 + 智能问答能力的 AI 助手。

本次线下Meetup聚焦大模型部署关键挑战,重点探讨异构GPU管理与推理效率优化,分享构建统一模型服务平台的前沿实践。会议内容包括稀疏注意力系统设计、SGLang路线图及NVFP4混合精度量化等创新技术,旨在推动大模型落地与性能优化。活动由GPUStack、OpenBMB和SGLang社区联合举办,欢迎关注AI基础设施的从业者参与交流,共同促进AI Infra领域发展。

vLLM 和 SGLang 对 Qwen3.6-27B 的完整部署测试教程与性能测试表现

多节点 Data Parallel 部署可基于各节点负载动态分发请求,减少长请求阻塞带来的性能抖动,在高并发场景下提升整体吞吐稳定性。

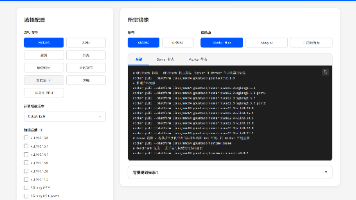

GPUStack 支持接入官方及自定义推理镜像,以满足不同版本的 vLLM 和 SGLang 后端部署需求。以下示例展示如何在沐曦 GPU 上接入官方镜像并部署自定义版本模型。在 GPUStack 控制台中进入推理后端 → vLLM,编辑后端并添加新版本,使用沐曦官方 vLLM 镜像:参数示例版本0.15.0镜像框架MACA镜像入口命令执行命令⚠️ 注意:使用相应镜像前,需要先在沐曦开发者社区获取

通过选择 GPU 类型、计算框架版本、推理后端、服务器架构等条件,动态生成对应的 GPUStack 容器镜像列表,并提供镜像准备与离线部署参考命令。