简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

(深度学习/计算机视觉/目标检测),毕设&课题|毫米波雷达信号处理(目标检测、时频分析、分类与识别),mmyolo从环境部署到训练自己的数据集,手把手带你玩转YOLO系列开源工具箱—MMyolo!

转换注意:由于tensorrt依赖于硬件,也就是不同电脑可能无法使用同一个tensorrt模型,因此需要在自己电脑本地首先转换pytorch模型为tensorrt模型,而不是直接拿别人转换好的tensorrt模型,否则可能会出现检测不到目标或者无法加载模型情况。使用Python将YOLOv10模型从PyTorch格式(.pt)转换为TensorRT格式,并通过封装成类来实现目标检测加速任务,是一个

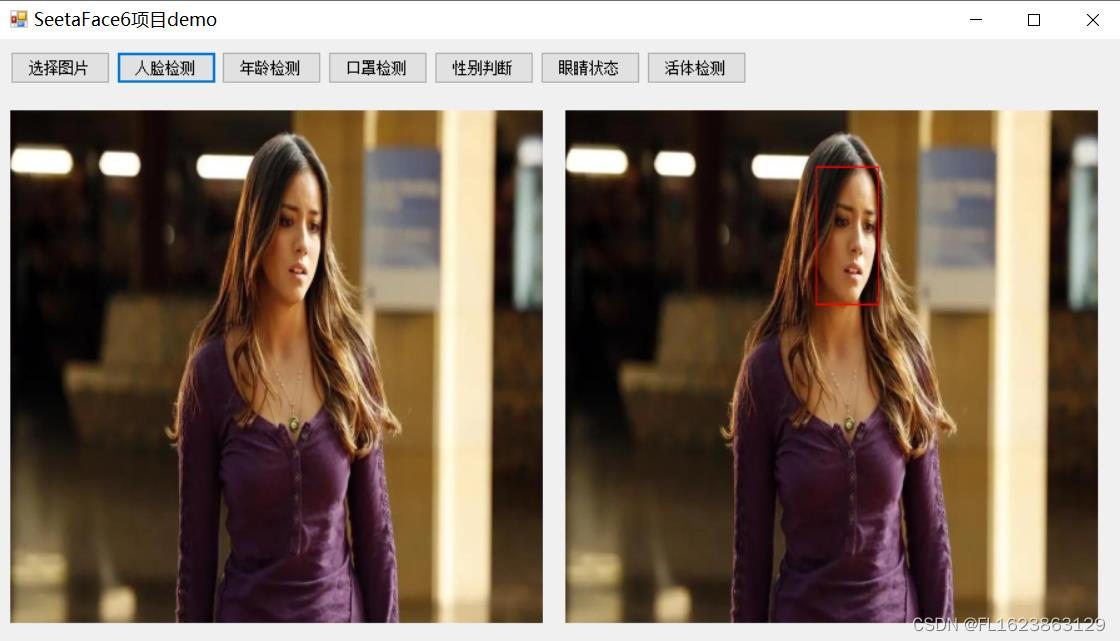

在门禁系统方面,它可以用于企业的安全防范、学校的校园安全、小区的住宅管理等场景,通过人脸识别技术来控制人员的进出和访问权限。在过去的几年中,随着深度学习技术的不断发展,人脸识别技术也取得了长足的进步。SeetaFace6是由中国科技公司自主研发的一款人脸识别技术,它基于深度学习算法,能够快速、准确地识别出人脸,并且支持多种应用场景,如门禁系统、移动支付、安全监控等。未来,随着人工智能技术的不断发展

ollama安装时候不能选择安装路径,只能默认安装C盘大概需要5GB空间,面对C盘没有多少的用户就很难装上去。windows默认安装在C盘,不支持修改程序安装目录,可以在Windows终端中输入以下命令来自定义安装路径。在用户环境变量中添加一个OLLAM_MODELS环境变量来定义模型的储存位置。

【代码】基于funasr+pyaudio实现电脑本地麦克风实时语音识别项目语音转文本python实现。

登录界面主界面基于 YOLO26的目标检测系统,支持图片、视频和实时摄像头检测,集成 DeepSeek AI 分析功能。windows10anaconda3+python3.10torch2.3.1ultralytics8.4.7Django==5.2.11APEBPENEVPE数据集格式:YOLO格式(不包含分割路径的txt文件,仅仅包含jpg图片以及对应的yolo格式txt文件)图片数量(jp

基于 YOLOv8 的目标检测系统,支持图片、视频和实时摄像头检测,集成 DeepSeek AI 分析功能。访问 http://127.0.0.1:8000。训练精度(Precision)=96.0%训练召回率(Recall)=96.8%houhuang(厚黄)fenhong(粉红)训练map=98.9%houbai(厚白)huihei(灰黑)训练集图片数=720。

ollama安装时候不能选择安装路径,只能默认安装C盘大概需要5GB空间,面对C盘没有多少的用户就很难装上去。windows默认安装在C盘,不支持修改程序安装目录,可以在Windows终端中输入以下命令来自定义安装路径。在用户环境变量中添加一个OLLAM_MODELS环境变量来定义模型的储存位置。

large-v2模型:https://huggingface.co/guillaumekln/faster-whisper-large-v2/tree/main。large-v2模型:https://huggingface.co/guillaumekln/faster-whisper-large-v1/tree/main。large-v3模型:https://huggingface.co/Syst

模型下载地址:https://huggingface.co/sandrohanea/whisper.net/tree/main/classic。使用ggml-tiny.bin模型文件CPU推理速度客观,最重要是官方都是需要vs2022才行,我这边直接在vs2019就可以直接跑。github地址:https://github.com/sandrohanea/whisper.net。