简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

通过上述对比可以看出,虽然Java与ArkTS在方法重载和数值类型的处理上有所不同,但都可以通过合理的编程实践达到类似的效果。而对于数值类型,尽管Java提供了BigInteger来处理非常大的数字,而ArkTS则使用BigInt类型来保证大整数的精度。此外,对于字节数组的处理,Java使用byte[],而ArkTS使用Uint8Array和Int8Array来区分有符号和无符号的数据。本篇技术文

孙晨阳的鸿蒙开发之路,生动诠释了“热爱驱动创新”的力量。“参加这种竞赛可以给我一个很好的deadline去学习和扩展自己的知识,”孙晨阳表示,“2025年HarmonyOS创新赛的意义远超奖项本身,整个备赛周期,我深入研究了鸿蒙最新技术框架、端侧AI能力与多端协同场景,这种“以赛促学”的模式,推动我快速从一个技术爱好者成长为能够独立完成复杂项目的开发者。“我现在有小朋友了,希望他能继承我的意志,等

近日,深度学习奠基者、图灵奖得主 Yoshua Bengio,近日在接受澳大利亚 ABC 新闻《7.30》主持人 Sarah Ferguson 的专访时,又一次地对人工智能的未来发出了严肃警告。“AI并不是按传统方式编程出来的,它更像像是被人类训练出来的一头小老虎!现在看起来很可爱,但会越来越强大。“种种前沿的公司内部研究显示,大模型推理系统会利用推理能力欺骗人类。“最危险的情况,是他们会贿赂人类

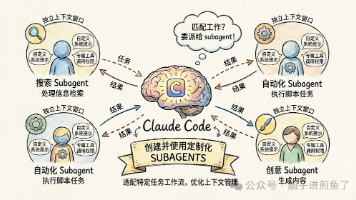

官方还给出了好几个 agents 例子,能给于大家学习和解读。我从其中抽取两个较为常用的,大家一起学习。Claude Code 所出的 subagents 功能,主要是通过/agents唤起并完成创建配置。核心特性是可以由主任务委托给子代理 agent 去执行某些定制化的工作项,其上下文是独立的。各 subagent 间并不能通信,主要是父子代理的关联关系。如果有相对独立写作的委派型诉求,使用 s

英伟达与达索系统正深化合作,将AI基础设施、模型与虚拟孪生和3D宇宙结合,打造“经过科学验证的工业世界模型”。这一合作标志着工业AI从生成式、数据驱动模式,转向以工程、物理和科学定律为基础的现实世界AI。英伟达正将其AI基础设施、模型和库与3D设计软件供应商达索系统的虚拟孪生技术相结合,构建一种双方称之为“经过科学验证的工业世界模型”的共享架构。两家公司表示,这深化了它们现有的合作,双方“对工业A

六分之一的人口已将生成式AI融入日常,但在这个繁荣表象之下,全球北方与南方的数字鸿沟正以令人担忧的速度加剧。微软Al经济研究所发布了一份全球AI采用重磅报告。在这份深度报告中,我们看到2025年下半年全球人工智能的普及率创下历史新高。六分之一的人口已将生成式AI融入日常,但在这个繁荣表象之下,全球北方与南方的数字鸿沟正以令人担忧的速度加剧。

2026年,不管是计算机科学界的泰斗,还是医学、法学、经济学领域的专家,他们都在强调同一个主题,那就是从“AI能做什么”转向“AI做得有多好、成本如何以及为了谁而做”。2026年将是人工智能从喧嚣的布道期正式迈入冷静评估期的关键分水岭。斯坦福大学以人为本人工智能研究院(HAI)的顶级学者们在最新的年度预测中达成了一个惊人的共识。那个依靠单纯讲故事和宏大叙事就能获得数十亿美元融资的时代已经结束,接下

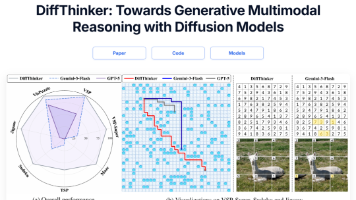

DiffThinker 的出现,标志着生成式多模态推理(Generative Multimodal Reasoning)时代的开启。它证明了扩散模型不仅能画画,还能进行严密的逻辑推理。对于长程、视觉中心的复杂任务,将推理过程从「文本流」转变为「视觉流」,或许正是通往下一代通用人工智能的关键一步。如果你想更深入地学习大模型,以下是一些非常有价值的学习资源,这些资源将帮助你从不同角度学习大模型,提升你

本文的撰写目的,并非对人工智能与人类之间的“智力之争”进行评判。它仅仅是为了论证一个核心观点——人类级别的推理能力,已不再是人工智能技术发展的上限。这份榜单直观展现出,大型语言模型仅用了极短的时间,便跨越了那些曾经被视为“卓越智力”专属领域的界限——至少从标准化测试的测量维度来看,这一结论成立。与此同时,这些测试分数也让我们对“智力”的定义有了全新的认知:智力绝非仅凭标准化测试分数就能被完整定义。

2025刚刚过去,这一年像是对人工智能的一次全面体检,而2026年将是这项技术展现其实用价值的关键年份。2026年将是人工智能脱下华丽外衣并穿上工装的一年,技术从喧嚣的概念验证正式迈向产生真实价值的产业深处。2025刚刚过去,这一年像是对人工智能的一次全面体检,而2026年将是这项技术展现其实用价值的关键年份。整个行业的焦点正在发生实质性转移,不再单纯执着于构建参数规模越来越庞大的语言模型,转而投