简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

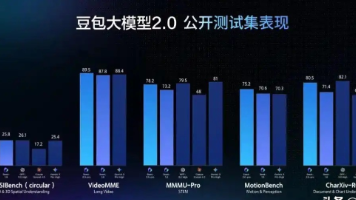

豆包2.0推出原生Agent架构,实现从被动问答到主动执行的跨越式发展。该架构具备自主任务拆解、多角色协同和端到端闭环交付能力,支持200万Token上下文窗口和99.2%零样本工具调用准确率。通过3行代码即可完成全链路开发,实测2分17秒自动生成1200+行代码、32个单元测试及相关文档。企业还可自定义安全审计等Agent角色,满足合规需求。这一创新不仅大幅提升开发效率,更将程序员角色转变为&q

在深度学习模型部署中,算子融合(Operator Fusion)是提升执行效率、降低内存占用的关键优化手段。CANN(Compute Architecture for Neural Networks)开源项目中的仓库()提供了一套轻量级、解耦式的自动融合框架,其核心在于一套基于规则与成本模型的融合决策算法。该算法不仅支持传统 element-wise 融合,还能处理复杂的控制流、动态 shape

随着大模型推理对计算效率和内存占用提出更高要求,模型压缩技术已成为 AI 工程落地的关键环节。CANN(Compute Architecture for Neural Networks)生态中的(Ascend Model Compression Toolkit)作为一款专为 AI 处理器亲和设计的模型压缩工具包,不仅支持低比特量化、张量分解等先进压缩算法,还提供了完整的端到端部署验证流程与容错回退

在深度学习模型部署中,算子融合(Operator Fusion)是提升执行效率、降低内存占用的关键优化手段。CANN(Compute Architecture for Neural Networks)开源项目中的仓库()提供了一套轻量级、解耦式的自动融合框架,其核心在于一套基于规则与成本模型的融合决策算法。该算法不仅支持传统 element-wise 融合,还能处理复杂的控制流、动态 shape

在多进程、多设备协同计算场景中,高效的进程间同步是确保数据一致性和执行正确性的关键。CANN(Compute Architecture for Neural Networks)开源项目中的shmem(Shared Memory Communication Library)仓库()基于 OpenSHMEM 标准,提供了一套面向高性能计算的共享内存通信模型。其核心不仅在于远程内存访问(RMA),更在于

在大规模 Transformer 模型的推理与训练中,多头注意力机制(Multi-Head Attention, MHA)是计算密集度最高的核心组件之一。其内在的“多头”结构天然具备并行性,但如何高效地调度这些并行计算单元,并有效隐藏其与全局内存之间的数据搬运开销,是实现极致性能的关键挑战。CANN 生态中的基于瓦片化流水线的多头并行调度与双缓冲通信隐藏机制。本文将深入剖析 ops-transfo

在国产 NPU 软件生态的竞争中,单纯的硬件性能已不足以构建长期壁垒。真正决定成败的,是能否提供高性能、高兼容、高易用的底层算子基础设施。CANN 通过 ops-nn 仓库,在这三个维度上交出了高质量答卷:以 aclnn 两阶段调用释放调度潜力,以深度优化算子保障执行效率,以开放协作机制激发社区创新。对于正在选型国产加速框架的企业与开发者而言,ops-nn 所代表的技术路线,无疑提供了一条兼顾当下

ops-math 的跨平台设计,体现了现代 AI 基础软件的核心哲学:在抽象与性能之间寻找最优平衡。通过硬件抽象层、多版本 Kernel、动态调度等机制,它既满足了高性能计算的严苛要求,又为生态扩展提供了开放接口。这种“分层解耦、按需优化”的思路,不仅适用于数学算子库,也为整个 CANN 生态的可持续发展奠定了坚实基础。在未来异构计算日益普及的背景下,可移植性不再是性能的对立面,而是高效创新的前提

在 CANN(Compute Architecture for Neural Networks)生态中,SHMEM(Shared Memory)库作为面向多机多卡场景的高性能内存通信库,其核心价值在于为分布式 AI 应用提供了一种高效、低延迟的跨设备内存访问范式。然而,当多个计算单元(如不同设备上的 AI Core)并发地访问同一块远程共享内存时,如何保证操作的原子性(Atomicity)和内存一

现代模型广泛使用 GELU、SiLU 等非线性激活。ops-math// 快速 GELU 近似(误差 < 1e-4)// 使用多项式近似 tanh,避免调用慢速数学库该实现完全避免了标准数学库调用,在保持精度的同时显著提升性能。开发者可通过asc-devkit:设备端计算逻辑;:Host 调度与参数校验;:精度与性能测试脚本。该流程大幅降低高性能算子开发门槛。ops-math作为 CANN 架构中